La modalidad de salida está cambiando: de texto que lees a imágenes que experimentas.

*Figuras y diseño coinciden con el ensayo original en Medium.*

El momento en que supe que todo había cambiado

Vi a una IA generar un video cinematográfico con diálogo sincronizado. Entonces me di cuenta: la IA basada en texto ya era cosa de ayer.

Esta semana, ByteDance lanzó Seedance 2.0: video cinematográfico en 1080p, audio sincronizado de forma nativa con sincronización de labios multilingüe, narración en múltiples tomas con coherencia de personajes entre escenas, hasta nueve entradas de imagen y tres entradas de video y tres de audio a la vez, y clips de 15 segundos que pueden verse de calidad profesional.

La semana pasada, Claude Opus 4.6 se lanzó con una ventana de contexto de un millón de tokens y una fuerte capacidad de codificación agente. No solo escribir código: enviar interfaces de usuario listas para producción desde un breve aviso. GitHub Copilot lo integró rápidamente. Los desarrolladores comenzaron a enviar aplicaciones completas en minutos.

Mientras tanto, en tareas puramente de texto, GPT-5 versus Claude 4 Sonnet pueden sentirse intercambiables para muchos usuarios.

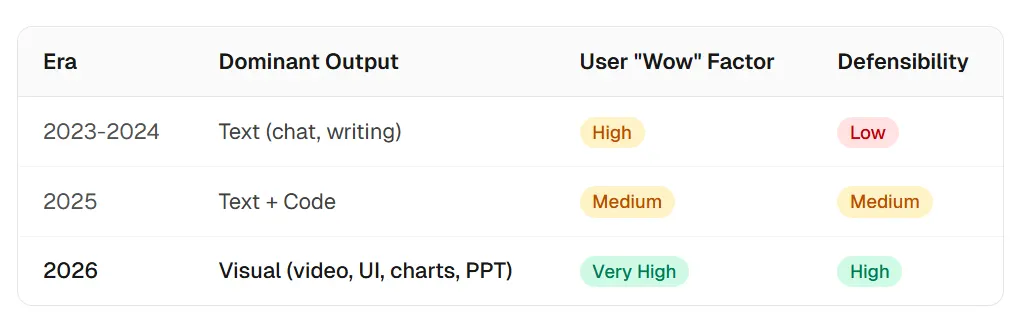

2026 no es el año en que la IA mejora marginalmente al escribir texto. Es el año en que la IA mejora drásticamente en mostrarte cosas: video, interfaz de usuario, gráficos, paneles, presentaciones. La modalidad de salida está pasando de texto a imágenes, y eso cambia qué productos ganan.

La meseta del texto: por qué "mejor texto" ya no mueve la aguja

GPT-5 versus Claude 4: las diferencias son reales. La brecha de percepción cotidiana? A menudo cercana a cero.

Los modelos de frontera en 2026 son objetivamente más fuertes que sus predecesores de 2025. GPT-5 introdujo razonamiento adaptativo: cambiando entre modos rápido y profundo. Claude Opus 4.6 envió una ventana de contexto de 1M de tokens y sólidos resultados de referencia. Razonamiento, precisión fáctica y velocidad, todo avanzó.

Pero en la salida de texto, la brecha de percepción del usuario converge hacia cero.

DataStudios (2026) lo dijo claramente: ambos son potencias; la filosofía difiere, pero discernir salidas importa menos. Las personas reportan "fatiga de chatbot de IA" — los asistentes principales pueden sonar igual.

La investigación sobre el escalado de LLM refuerza el techo. Un PDF de OpenReview señala que para tareas intensivas en conocimiento, más tiempo de cómputo no mejora de manera confiable la precisión, y puede aumentar las alucinaciones. Los rendimientos en el pulido del texto son decrecientes.

El "asombro" se movió. Pocas personas se quedan sin aliento por un correo electrónico pulido. Un clip cinematográfico de 15 segundos a partir de un aviso, una interfaz de usuario de producción en medio minuto, o un panel de datos de diez diapositivas a partir de una carga de Excel todavía detiene la sala.

La próxima ola de empresas de IA destacadas no se definirá solo por quién escribe los mejores párrafos. Se definirán por quién genera las mejores imágenes.

La explosión visual: cuatro categorías que redefinen la salida de IA

Texto a video. Texto a interfaz de usuario. Texto a gráfico. Texto a presentación. La capa de experiencia se está reconstruyendo.

Categoría 1: Generación de video con IA

Seedance 2.0 no es un pequeño paso. Reencuadra la categoría: 1080p, audio generado en paralelo con video, narrativa en múltiples tomas con personajes consistentes, sincronización de labios multilingüe y entradas multimodales pesadas — más cerca de un pipeline que de un juguete. Véase también esta comparación de WaveSpeed.ai de Seedance 2.0 versus Kling 3.0, Sora 2 y Veo 3.1.

El campo está lleno: Sora 2 (centrado en física, ~12s), Veo 3.1 (cinematográfico, ~8s), Kling 3.0 (fuerte en China). La arquitectura de entrada multimodal de Seedance 2.0 establece un nuevo estándar. Cobertura de la reacción del mercado: Silicon Republic sobre acciones tecnológicas chinas.

Contexto de tamaño de mercado: MarketsandMarkets sobre el mercado de generación de imágenes y video con IA (proyección hasta 2030, CAGR en los altos treinta).

Categoría 2: Generación de interfaz de usuario con IA

v0 de Vercel convierte el lenguaje en React y Tailwind de grado de producción. Bolt, Lovable y Forge impulsan aplicaciones completas a partir de avisos. a16z sobre la era de "aviso a producto" captura por qué el ciclo de idea a envío colapsó.

Claude Opus 4.6 amplifica esto: un contexto de 1M de tokens permite que un asistente mantenga bases de código completas mientras genera interfaz de usuario con conciencia arquitectónica. La velocidad de desarrollo cambia cuando el modelo ve todo el proyecto.

Categoría 3: Visualización de datos con IA

Las pilas de BI tradicionales exigen configuración manual, lenguajes de consulta y habilidad de diseño. Las herramientas de visualización nativas de IA comprimen el camino: sube datos, describe la vista, obtén gráficos y paneles rápidamente.

El diferenciador difícil es la trazabilidad. Las alucinaciones de texto se ocultan fácilmente; un gráfico incorrecto es obvio. Eso fuerza barreras de ingeniería más altas y un foso de calidad natural. La velocidad no es suficiente — los números deben ser correctos.

Categoría 4: Generación de presentaciones con IA

El mercado de presentaciones con IA fue aproximadamente $1.5B en 2025, con proyecciones hacia ~$4.0B para 2033 a una CAGR de ~14%. Gamma escaló usuarios rápidamente; Tome salió de la categoría. El mercado se está dividiendo entre herramientas centradas en velocidad y herramientas centradas en profundidad.

La frontera son pipelines multiagente que investigan, analizan, diseñan y verifican — no una sola pasada de LLM que decora viñetas. Las presentaciones son el formato comercial universal; hacerlas nativas de IA es un gran avance.

En las cuatro categorías, la salida pasa de "texto que lees" a "imágenes que experimentas". La industria pasó 2023–2025 afinando el canal de texto. En 2026, está construyendo el canal visual, donde a menudo reside la capacidad de defensa.

Por qué la IA visual es más difícil (y más defendible) que la IA de texto

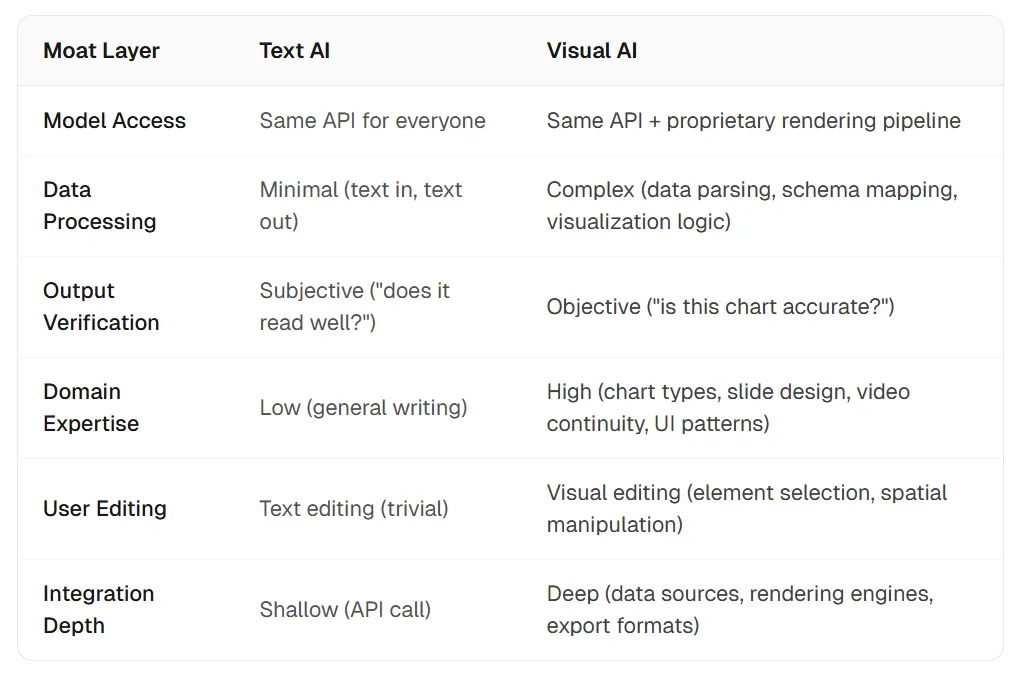

Cualquiera puede envolver un LLM. Pocos equipos pueden enviar un motor visual real.

Los productos de texto se mercantilizaron rápidamente: llama a GPT o Claude, formatea cadenas, envía. Miles de asistentes de escritura se difuminaron. Fosos delgados — mismos modelos, mismas API, calidad similar.

La IA visual resiste ese patrón:

- Infraestructura de renderizado — decodificadores de video, motores de gráficos, sistemas de interfaz de usuario, motores de diseño de diapositivas.

- Conocimiento del dominio — qué gráfico se adapta a qué forma de datos, cómo fluyen las narrativas a través de las diapositivas, cómo se componen los componentes.

- Pipelines de múltiples pasos — planificación, recuperación, análisis, renderizado y verificación; raramente una sola llamada API.

Para finales de 2026, las startups de IA más valiosas se inclinan hacia la salida visual primero. La era del envoltorio API se adelgaza; la era del motor visual se acelera.

La pila de IA visual: lo que está surgiendo

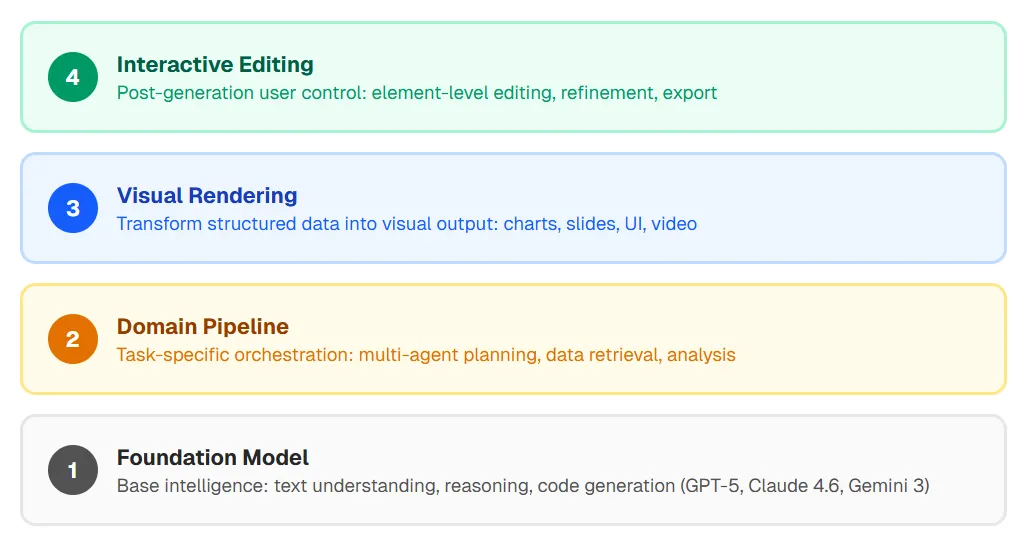

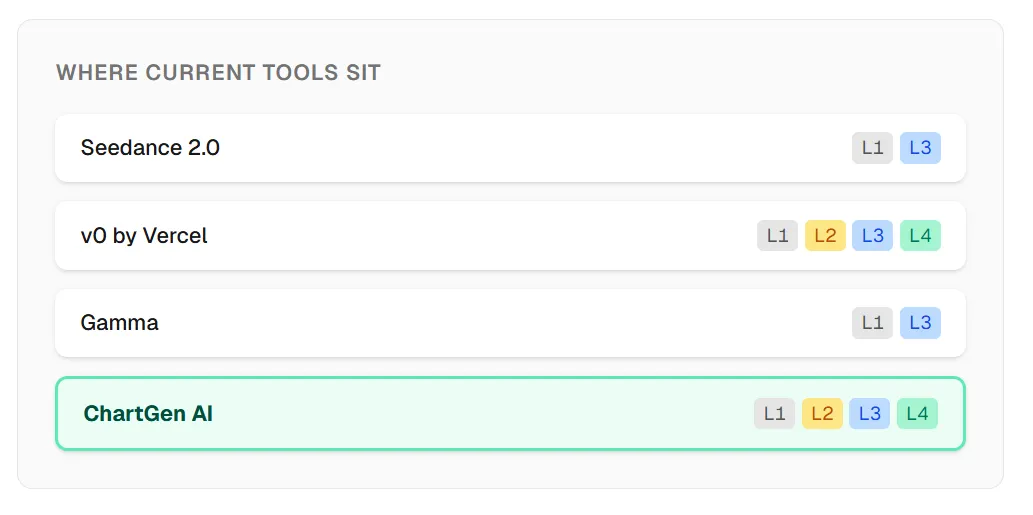

Un patrón de cuatro capas aparece en todas las categorías:

- Modelo fundacional

- Pipeline de dominio (planificación, herramientas, recuperación)

- Renderizado visual

- Edición interactiva

La capa 1 sola es un envoltorio de mercancía. Las capas 1–2 son poderosas pero a menudo invisibles. Las capas 1–3 se sienten como un producto real. Las capas 1–4 permiten a los usuarios generar e iterar en un mismo entorno — la forma duradera.

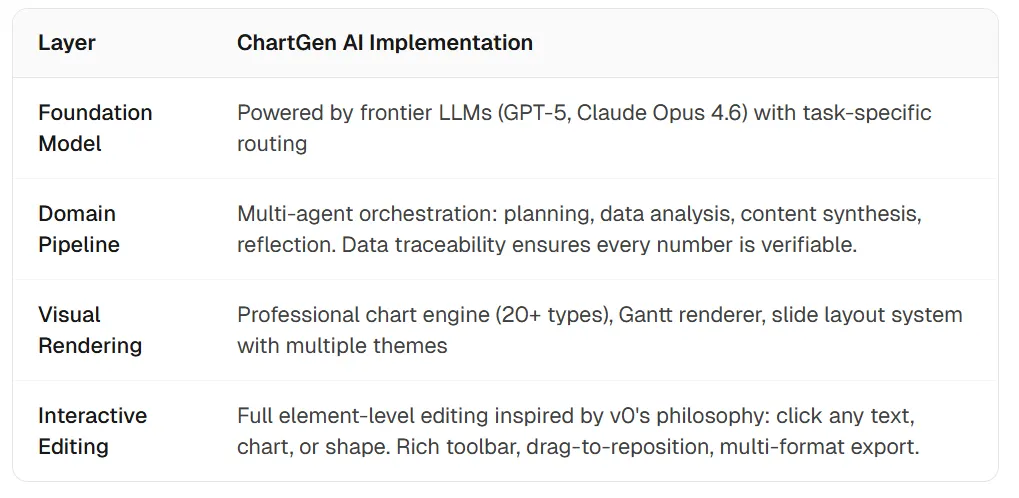

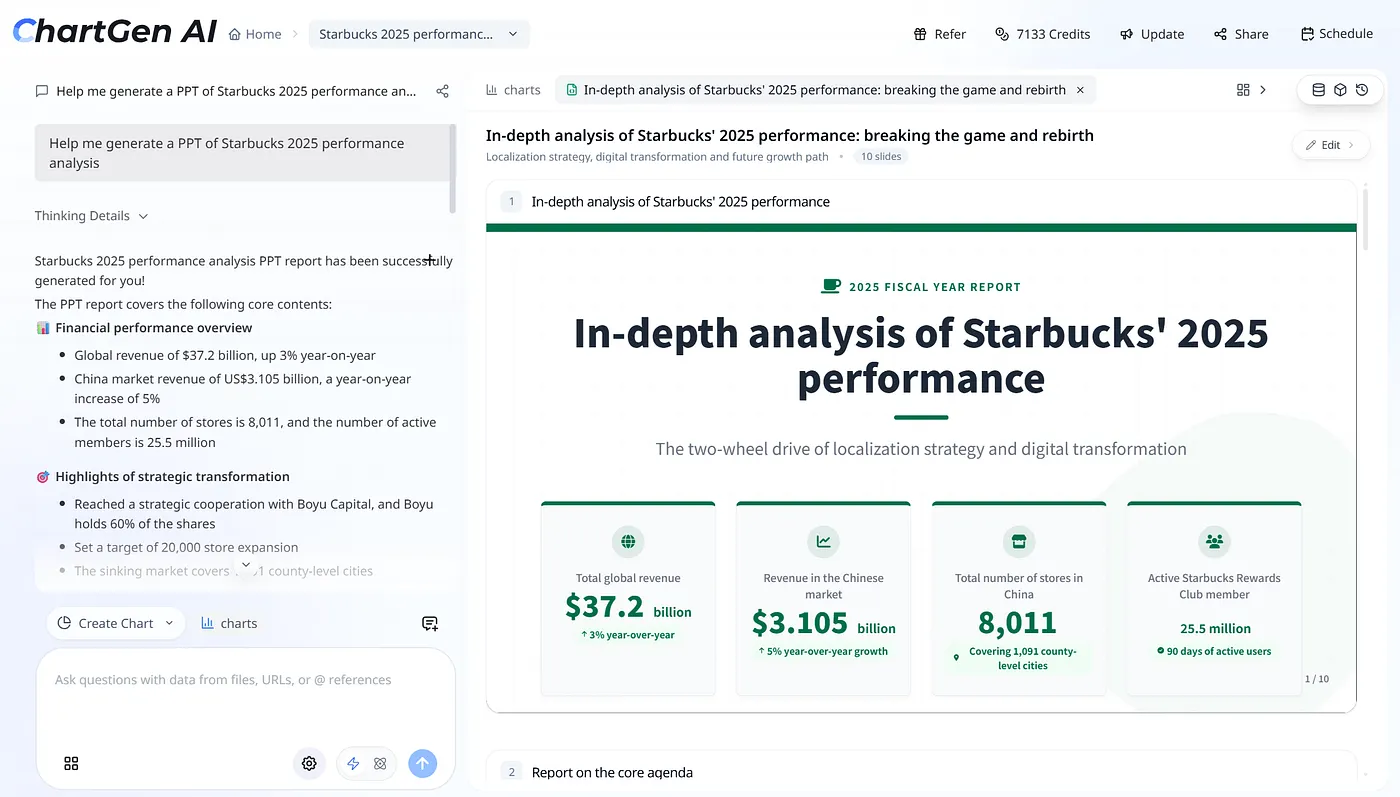

Caso de estudio: Cómo ChartGen AI encarna el cambio hacia la IA visual

No empezamos ChartGen AI para perseguir una tendencia. Empezamos con una tesis estrecha: los profesionales de datos no deberían necesitar ser diseñadores para crear imágenes convincentes. A medida que el producto creció, el patrón más amplio se volvió obvio — una plataforma de IA a salida visual.

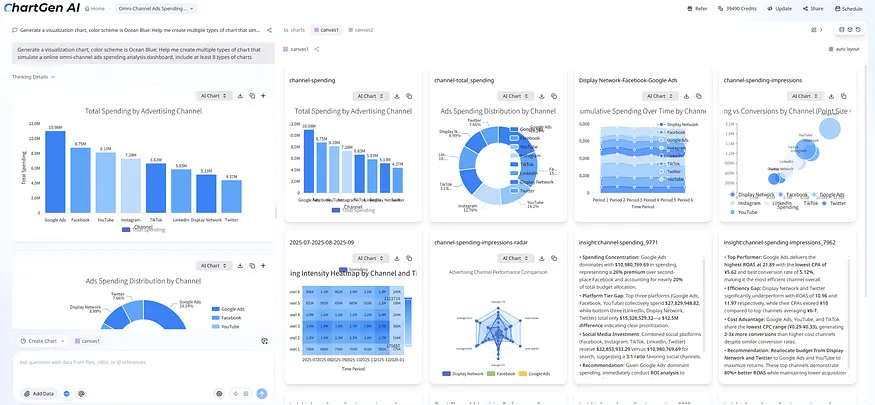

ChartGen AI se comporta como un agente de "IA a interfaz de usuario": lenguaje natural más datos adentro; gráficos, paneles, vistas Gantt y presentaciones completas afuera. Cada turno produce algo que puedes ver, editar y compartir — no un muro de texto.

Tres modos de salida visual

Modo 1 — Visualización de datos. Sube datos, pregunta en lenguaje natural, obtén gráficos y paneles en un lienzo infinito con trazabilidad a las filas de origen.

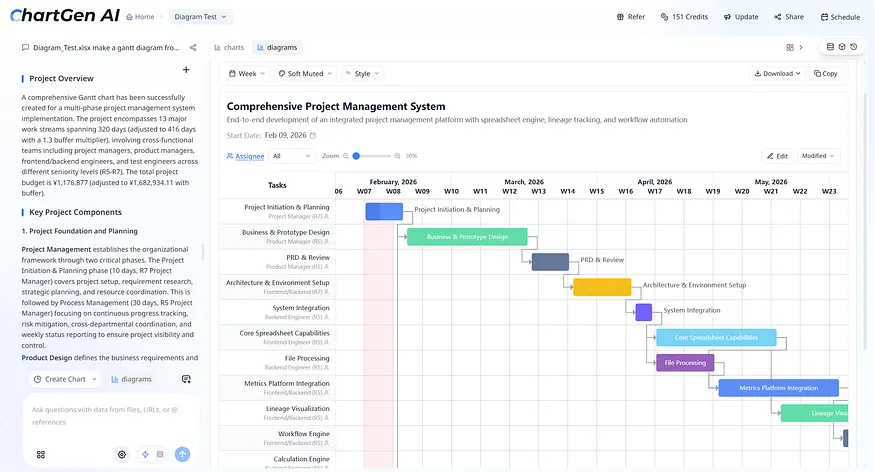

Modo 2 — Diagramas Gantt. Describe un proyecto o sube una hoja; obtén un Gantt interactivo con dependencias, propietarios y progreso, con ediciones en línea.

Modo 3 — Presentaciones con IA. Un aviso puede impulsar un pipeline multiagente (planificar, investigar, analizar, diseñar, reflexionar). Las tablas y gráficos permanecen vinculados a los datos fuente; la edición es a nivel de elemento en un editor de presentaciones dedicado.

Este es el cambio hacia la IA visual en la práctica: un agente que muestra tus datos — en artefactos que puedes confiar, refinar y presentar.

Qué sigue: cinco predicciones para la ola de IA visual

- El video y la visualización de datos convergen — historias de datos animadas, informes trimestrales en formato de video, paneles que se reproducen como presentaciones; la línea entre gráfico y movimiento se desdibuja.

- "IA a interfaz de usuario" se convierte en el flujo de trabajo de desarrollo predeterminado — herramientas de clase v0 se unen al kit diario; contextos de millones de tokens hacen que la generación de interfaz de usuario de todo el repositorio sea normal.

- Las presentaciones con IA se comen la mayoría de las presentaciones internas — artefactos de un solo aviso para actualizaciones y revisiones; el pulido humano se concentra en los momentos externos de mayor riesgo.

- "Agente de IA visual" se convierte en una categoría — herramientas de analista, producto y marketing que por defecto entregan resultados visuales, no desplazamiento hacia atrás.

- La competencia de modelos se desplaza a la calidad visual — los puntos de referencia para gráficos, diapositivas, interfaz de usuario y video importan tanto como las tablas de clasificación de prosa.

El paso de la IA de texto a la IA visual no es una mejora de características. Es un cambio de plataforma — más cerca de CLI a GUI o de escritorio a móvil que de una actualización de modelo. Los constructores que prioricen la salida visual darán forma a la próxima década.

Muestra, no digas

Seedance 2.0 no solo describe una escena — la muestra, con audio sincronizado.

Claude Opus 4.6 no solo describe una interfaz de usuario — puede enviar interfaces listas para producción rápidamente.

v0 no se detiene en una especificación — envía interfaz de usuario funcional a partir de un aviso.

ChartGen AI no se detiene en describir tus datos — los visualiza en gráficos, paneles y presentaciones que puedes editar y defender.

El hilo conductor de los productos más impactantes de 2026: menos párrafos para leer, más artefactos para experimentar.

Pasamos 2023–2024 asombrados de lo que la IA podía decir. En 2026, estamos asombrados de lo que puede mostrar. El canal visual es más amplio y rico de lo que el texto jamás fue — y las empresas que construyan para él definirán el panorama futuro.

Referencias

Ensayo fuente (figuras y diseño original): medium.com — 2026: El año en que la IA dejó de hablar y empezó a mostrar

- seedance.io — Página del producto Seedance 2.0

- wavespeed.ai — Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Anuncio de Claude Opus 4.6

- datastudios.org — Comparación GPT-5 vs Claude 4

- openreview.net — PDF sobre escalado de LLM (tareas de conocimiento, rendimientos decrecientes)

- marketsandmarkets.com — Mercado de generación de imágenes y video con IA

- htfmarketinsights.com — Informe del mercado de generadores de presentaciones con IA

- a16z.com — Creadores de aplicaciones web con IA / aviso a producto

- siliconrepublic.com — Seedance 2.0 y acciones tecnológicas chinas

- neurocanvas.net — Vista previa de generación de imágenes con IA 2026

- lordofthewix.com — Progreso de imagen/video con IA 2020–principios 2026