La modalità di output sta cambiando: dal testo che leggi alle immagini che vivi.

*Le figure e il layout corrispondono al saggio originale su Medium.*

Il momento in cui ho capito che tutto era cambiato

Ho visto un'IA generare un video cinematografico con dialogo sincronizzato. Poi ho capito: l'IA basata su testo era già ieri.

Questa settimana, ByteDance ha rilasciato Seedance 2.0: video cinematografico 1080p, audio nativamente sincronizzato con labiale multilingue, narrazione multi-inquadratura con coerenza dei personaggi tra le scene, fino a nove input di immagini e tre input video e tre audio contemporaneamente, e clip di 15 secondi che possono sembrare di livello professionale.

La scorsa settimana, Claude Opus 4.6 è stato lanciato con una finestra di contesto di un milione di token e una forte codifica agentica. Non solo scrivere codice — ma pubblicare interfacce pronte per la produzione da un breve prompt. GitHub Copilot lo ha integrato rapidamente. Gli sviluppatori hanno iniziato a pubblicare app full-stack in pochi minuti.

Nel frattempo, per i compiti puramente testuali, GPT-5 contro Claude 4 Sonnet può sembrare intercambiabile per molti utenti.

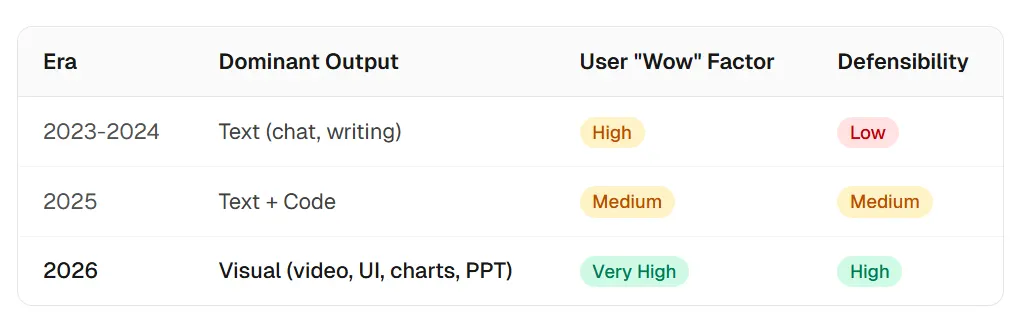

Il 2026 non è l'anno in cui l'IA migliora marginalmente nella scrittura di testo. È l'anno in cui l'IA migliora drasticamente nel mostrarti cose: video, interfacce, grafici, dashboard, presentazioni. La modalità di output si sta spostando dal testo alle immagini — e questo cambia quali prodotti vincono.

Il plateau del testo: perché un “testo migliore” non fa più la differenza

GPT-5 contro Claude 4: le differenze sono reali. Il divario di percezione quotidiano? Spesso vicino a zero.

I modelli di frontiera nel 2026 sono oggettivamente più forti dei loro predecessori del 2025. GPT-5 ha introdotto il ragionamento adattivo — passando tra modalità veloce e profonda. Claude Opus 4.6 ha rilasciato una finestra di contesto di 1 milione di token e forti risultati nei benchmark. Ragionamento, precisione fattuale e velocità sono tutti migliorati.

Ma per l'output testuale, il divario di percezione dell'utente sta convergendo verso zero.

DataStudios (2026) lo dice chiaramente: entrambi sono potenti; la filosofia differisce, ma discernere gli output conta meno. Le persone riferiscono “stanchezza da chatbot AI” — i principali assistenti possono sembrare uguali.

La ricerca sulla scalabilità dei LLM rafforza il tetto. Un PDF di OpenReview nota che per compiti ad alta intensità di conoscenza, più tempo di calcolo non migliora in modo affidabile l'accuratezza — e può aumentare le allucinazioni. I ritorni sulla rifinitura del testo stanno diminuendo.

Il “wow” si è spostato. Poche persone sussultano per un'email ben scritta. Una clip cinematografica di 15 secondi da un prompt, un'interfaccia di produzione in mezzo minuto, o un deck di dati di dieci slide da un caricamento Excel fermano ancora la stanza.

La prossima ondata di aziende AI eccezionali non sarà definita solo da chi scrive i migliori paragrafi. Saranno definite da chi genera le migliori immagini.

L'esplosione visiva: quattro categorie che ridefiniscono l'output AI

Da testo a video. Da testo a interfaccia. Da testo a grafico. Da testo a presentazione. Il livello dell'esperienza viene ricostruito.

Categoria 1: Generazione video AI

Seedance 2.0 non è un piccolo passo. Ridefinisce la categoria: 1080p, audio generato in parallelo con il video, narrazione multi-inquadratura con personaggi coerenti, labiale multilingue e input multimodali pesanti — più simile a un pipeline che a un giocattolo. Vedi anche questo confronto di WaveSpeed.ai tra Seedance 2.0, Kling 3.0, Sora 2 e Veo 3.1.

Il campo è affollato: Sora 2 (focalizzato sulla fisica, ~12s), Veo 3.1 (cinematografico, ~8s), Kling 3.0 (forte in Cina). L'architettura di input multimodale di Seedance 2.0 stabilisce un nuovo standard. Copertura della reazione del mercato: Silicon Republic sui titoli tecnologici cinesi.

Contesto di dimensionamento del mercato: MarketsandMarkets sul mercato della generazione di immagini e video AI (proiezioni fino al 2030, CAGR intorno al 38%).

Categoria 2: Generazione da AI a interfaccia

v0 di Vercel trasforma il linguaggio in React e Tailwind di livello produttivo. Bolt, Lovable e Forge spingono app full-stack da prompt. a16z sull'era “da prompt a prodotto” cattura perché il ciclo idea-pubblicazione è collassato.

Claude Opus 4.6 amplifica questo: un contesto di 1 milione di token permette a un assistente di mantenere interi codebase mentre genera interfacce con consapevolezza architetturale. La velocità di sviluppo cambia quando il modello vede l'intero progetto.

Categoria 3: Visualizzazione dati AI

Gli stack BI tradizionali richiedono configurazione manuale, linguaggi di query e abilità di design. Gli strumenti di visualizzazione nativi AI comprimono il percorso: carica dati, descrivi la vista, ottieni grafici e dashboard rapidamente.

Il differenziatore difficile è la tracciabilità. Le allucinazioni testuali si nascondono facilmente; un grafico sbagliato è ovvio. Questo impone barriere ingegneristiche più alte e un fossato naturale di qualità. La velocità non basta — i numeri devono essere giusti.

Categoria 4: Generazione di presentazioni AI

Il mercato delle presentazioni AI era circa $1.5 miliardi nel 2025, con proiezioni verso ~$4.0 miliardi entro il 2033 a un CAGR del ~14%. Gamma ha scalato gli utenti rapidamente; Tome è uscita dalla categoria. Il mercato si sta dividendo tra strumenti focalizzati sulla velocità e strumenti focalizzati sulla profondità.

La frontiera sono pipeline multi-agente che fanno ricerca, analisi, design e verifica — non un singolo passaggio LLM che decora elenchi puntati. I deck sono il formato universale del business; renderli nativi AI è un'enorme opportunità.

In tutte e quattro le categorie, l'output passa da “testo che leggi” a “immagini che vivi”. L'industria ha passato il 2023–2025 affinando il canale testuale. Nel 2026, sta costruendo il canale visivo — dove spesso risiede la difendibilità.

Perché l'IA visiva è più difficile (e più difendibile) dell'IA testuale

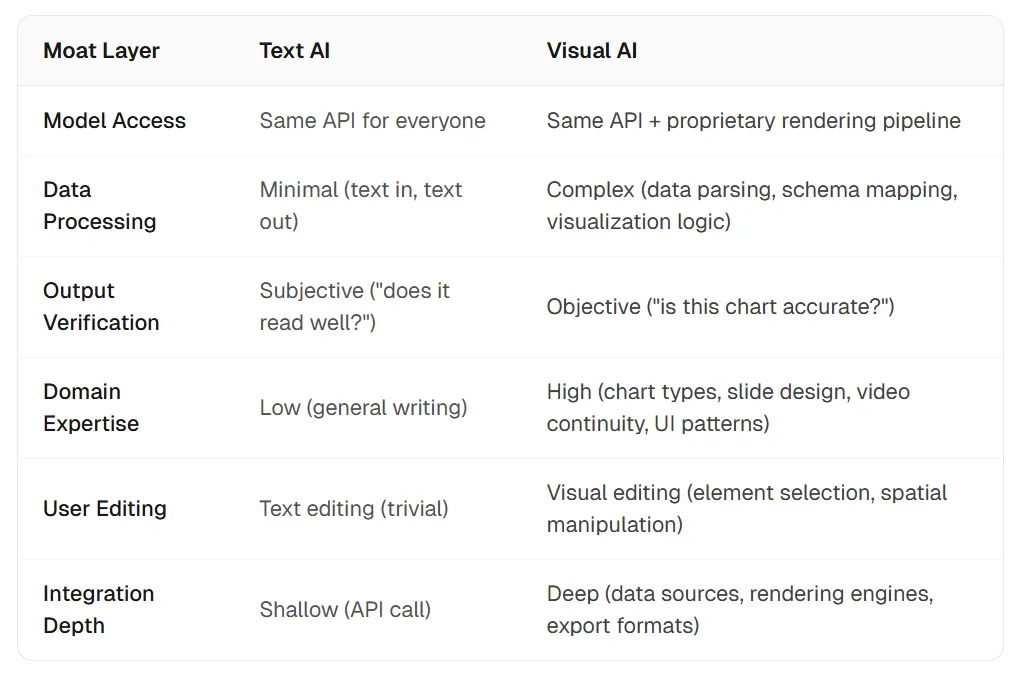

Chiunque può avvolgere un LLM. Pochi team possono spedire un vero motore visivo.

I prodotti testuali si sono commoditizzati rapidamente: chiama GPT o Claude, formatta stringhe, pubblica. Migliaia di assistenti di scrittura si sono confusi. Fossati sottili — stessi modelli, stesse API, qualità simile.

L'IA visiva resiste a questo schema:

- Infrastruttura di rendering — decoder video, motori grafici, sistemi di interfaccia, motori di layout di slide.

- Conoscenza di dominio — quale grafico si adatta a quale forma di dati, come le narrazioni fluiscono tra le slide, come i componenti si compongono.

- Pipeline multi-step — pianificazione, recupero, analisi, rendering e verifica; raramente una singola chiamata API.

Entro la fine del 2026, le startup AI più preziose tendono a essere orientate all'output visivo. L'era del wrapper API si assottiglia; l'era del motore visivo accelera.

Lo stack dell'IA visiva: cosa sta emergendo

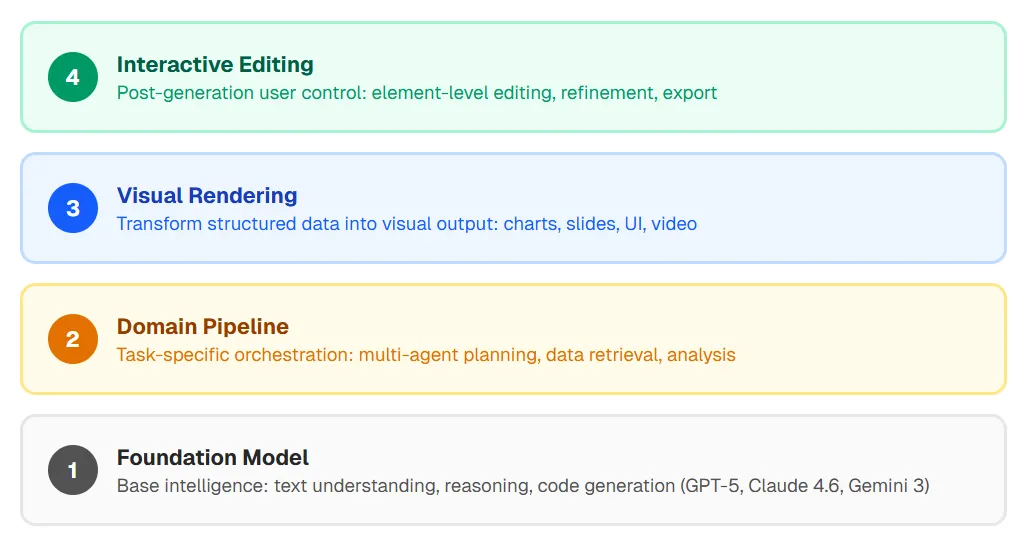

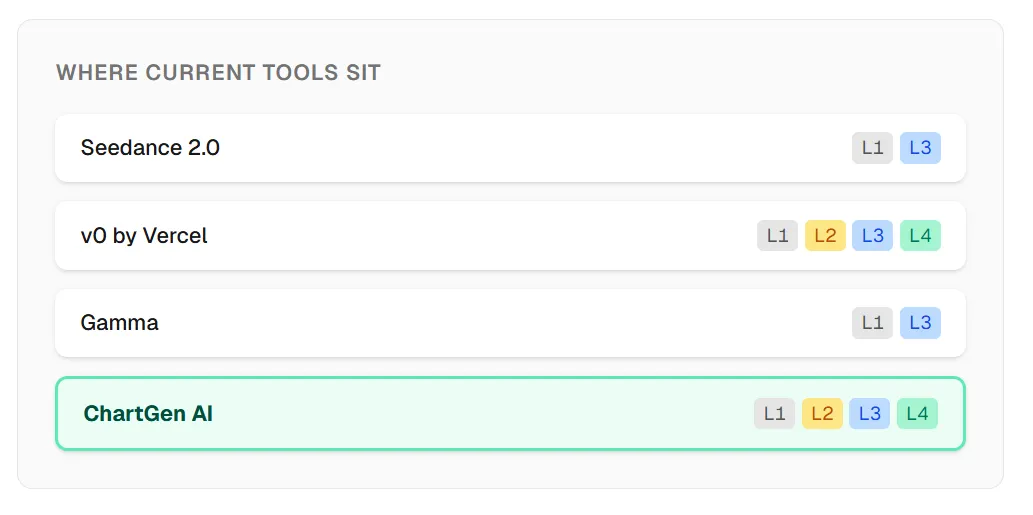

Uno schema a quattro livelli emerge attraverso le categorie:

- Modello fondazionale

- Pipeline di dominio (pianificazione, strumenti, recupero)

- Rendering visivo

- Modifica interattiva

Il livello 1 da solo è un wrapper commodity. I livelli 1–2 sono potenti ma spesso invisibili. I livelli 1–3 sembrano un vero prodotto. I livelli 1–4 permettono agli utenti di generare e iterare in un unico ambiente — la forma duratura.

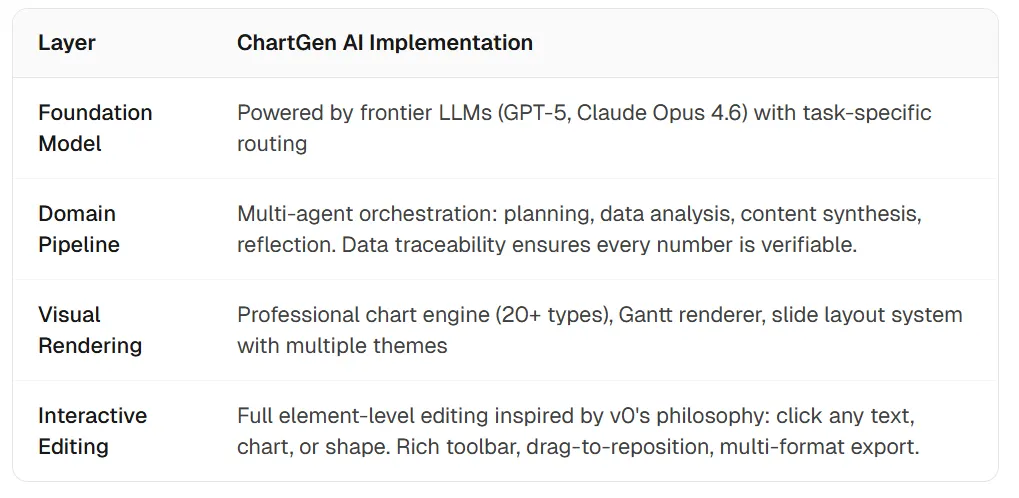

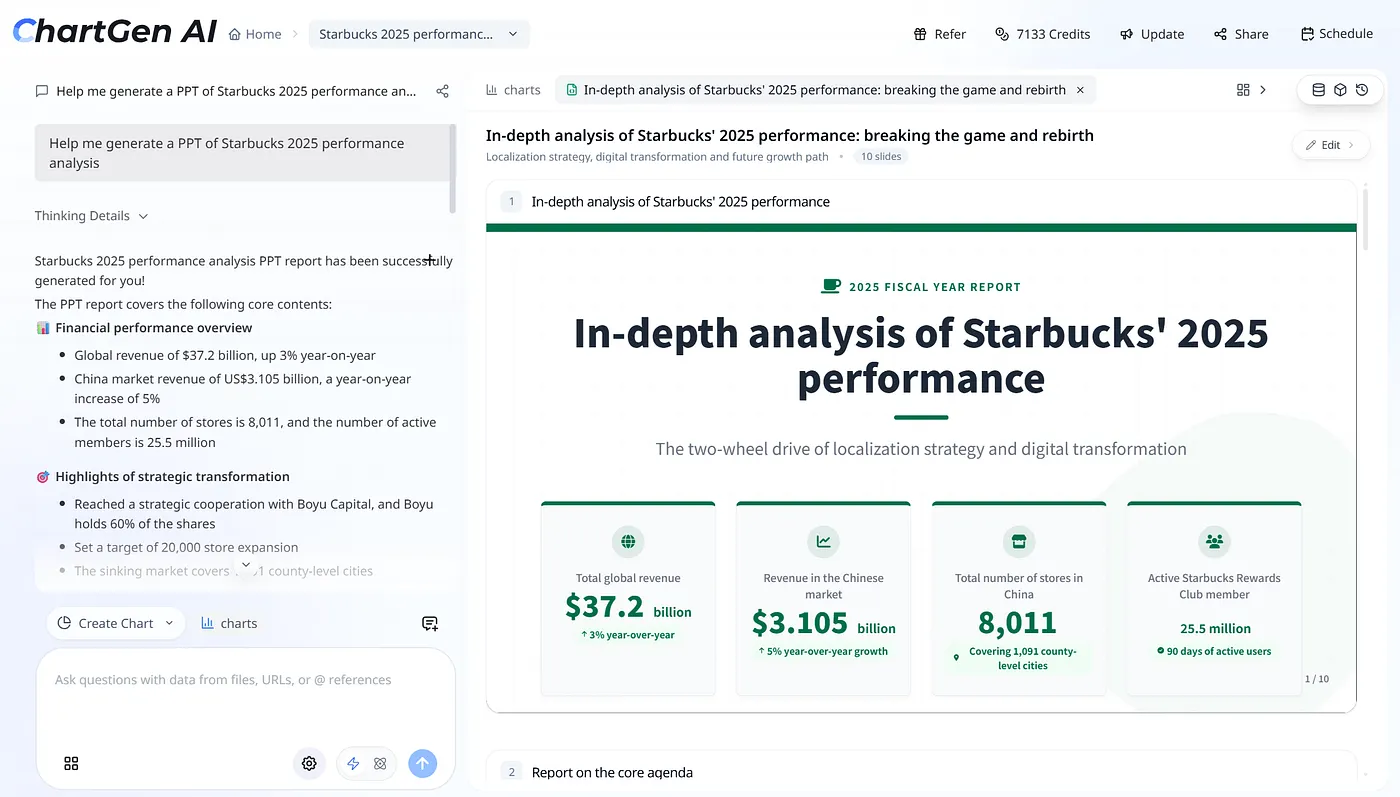

Caso di studio: come ChartGen AI incarna il cambiamento verso l'IA visiva

Non abbiamo iniziato ChartGen AI per inseguire una tendenza. Siamo partiti con una tesi ristretta: i professionisti dei dati non dovrebbero dover essere designer per creare immagini convincenti. Man mano che il prodotto cresceva, lo schema più ampio è diventato ovvio — una piattaforma da AI a output visivo.

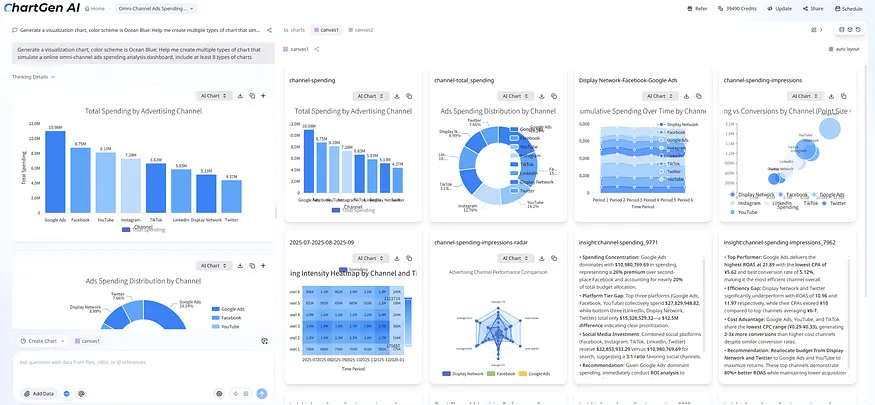

ChartGen AI si comporta come un agente “da AI a interfaccia”: linguaggio naturale più dati in input; grafici, dashboard, viste Gantt e presentazioni complete in output. Ogni giro produce qualcosa che puoi vedere, modificare e condividere — non un muro di testo.

Tre modalità di output visivo

Modalità 1 — Visualizzazione dati. Carica dati, chiedi in linguaggio semplice, ottieni grafici e dashboard su una tela infinita con tracciabilità alle righe di origine.

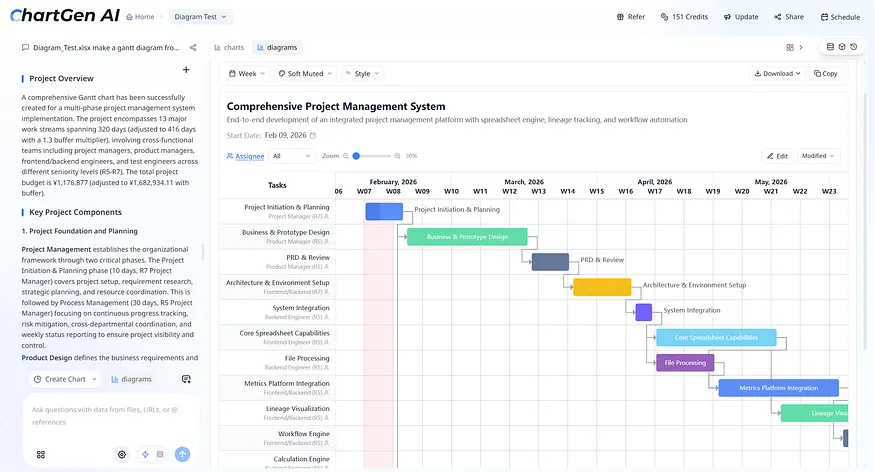

Modalità 2 — Diagrammi Gantt. Descrivi un progetto o carica un foglio; ottieni un Gantt interattivo con dipendenze, responsabili e progressi, con modifiche in linea.

Modalità 3 — Presentazioni AI. Un singolo prompt può guidare una pipeline multi-agente (pianifica, ricerca, analizza, progetta, rifletti). Tabelle e grafici rimangono collegati ai dati di origine; la modifica è a livello di elemento in un editor di deck dedicato.

Questo è il cambiamento verso l'IA visiva in pratica: un agente che mostra i tuoi dati — in artefatti che puoi fidare, perfezionare e presentare.

Cosa c'è dopo: cinque previsioni per l'ondata di IA visiva

- Video e visualizzazione dati convergono — storie di dati animate, report trimestrali in forma di video, dashboard che suonano come presentazioni; il confine tra grafico e movimento si sfuma.

- “Da AI a interfaccia” diventa il flusso di lavoro di sviluppo predefinito — strumenti di classe v0 entrano nel kit quotidiano; contesti di milioni di token rendono normale la generazione di interfacce per intero repository.

- Le presentazioni AI mangiano la maggior parte dei deck interni — artefatti da un singolo prompt per aggiornamenti e revisioni; la rifinitura umana si concentra sui momenti esterni più critici.

- “Agente IA visivo” diventa una categoria — strumenti per analisti, prodotto e marketing che predefiniscono deliverable visivi, non scrollback.

- La competizione tra modelli si sposta sulla qualità visiva — i benchmark per grafici, slide, interfacce e video contano tanto quanto le classifiche di prosa.

Il passaggio dall'IA testuale all'IA visiva non è un miglioramento di funzionalità. È un cambiamento di piattaforma — più vicino al passaggio da CLI a GUI o da desktop a mobile che a un aggiornamento del modello. I costruttori che danno priorità all'output visivo modellano il prossimo decennio.

Mostra, non dire

Seedance 2.0 non si limita a descrivere una scena — la mostra, con audio sincronizzato.

Claude Opus 4.6 non solo descrive un'interfaccia — può pubblicare interfacce pronte per la produzione rapidamente.

v0 non si ferma a un capitolato — pubblica un'interfaccia funzionante da un prompt.

ChartGen AI non si ferma a descrivere i tuoi dati — li visualizza in grafici, dashboard e deck che puoi modificare e difendere.

Il filo conduttore per i prodotti più impattanti del 2026: meno paragrafi da leggere, più artefatti da vivere.

Abbiamo passato il 2023–2024 stupiti da ciò che l'IA poteva dire. Nel 2026, siamo stupiti da ciò che può mostrare. Il canale visivo è più ampio e ricco di quanto il testo sia mai stato — e le aziende che lo costruiranno definiranno il panorama futuro.

Riferimenti

Saggio originale (figure e layout originale): medium.com — 2026: The Year AI Stopped Talking and Started Showing

- seedance.io — Pagina del prodotto Seedance 2.0

- wavespeed.ai — Confronto Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Annuncio di Claude Opus 4.6

- datastudios.org — Confronto GPT-5 vs Claude 4

- openreview.net — PDF sulla scalabilità dei LLM (compiti di conoscenza, rendimenti decrescenti)

- marketsandmarkets.com — Mercato della generazione di immagini e video AI

- htfmarketinsights.com — Rapporto sul mercato dei generatori di presentazioni AI

- a16z.com — Costruttori di app web AI / da prompt a prodotto

- siliconrepublic.com — Seedance 2.0 e titoli tecnologici cinesi

- neurocanvas.net — Anteprima generazione immagini AI 2026

- lordofthewix.com — Progresso della generazione di immagini/video AI 2020–inizio 2026