Datenteams in Unternehmen mangelt es nicht an Werkzeugen – sondern an *Zugänglichkeit, die korrekt bleibt*.

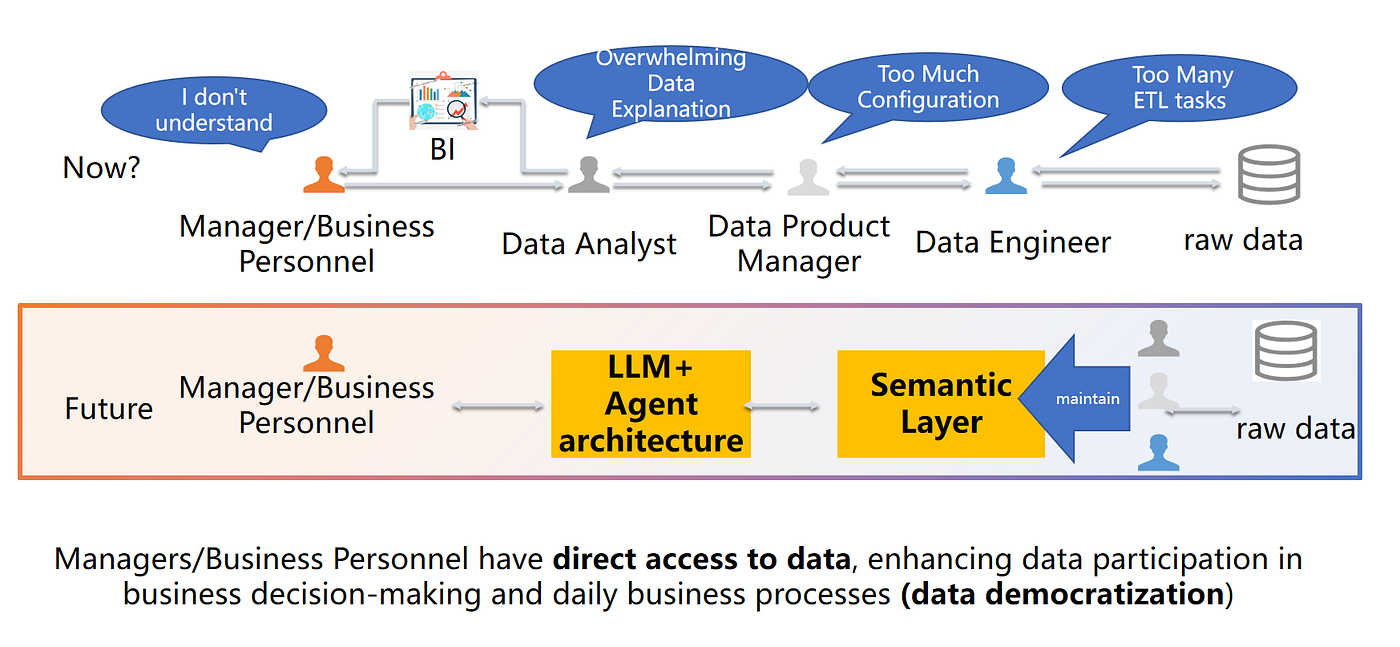

Die meisten Organisationen haben immer noch eine vertraute Aufteilung:

- Eine kleine Gruppe von Analysten kann Daten selbstbewusst erkunden

- Alle anderen warten in einer Warteschlange auf Antworten, Dashboards oder Exporte

Agentische Datenanalyse ist ein praktischer Weg aus diesem Engpass – aber nur, wenn sie auf dem richtigen Fundament aufbaut.

Dieser Artikel erklärt die Kernidee und die Architektur, die sie zuverlässig macht: Agentenarchitektur + eine semantische Schicht.

Einführung: Die Krise der Datenzugänglichkeit

Unternehmen sammeln mehr Daten denn je, doch die meisten Mitarbeiter können sie im Alltag nicht nutzen.

Das übliche Fehlermuster ist nicht „den Leuten ist es egal“. Es ist dieser Workflow:

- Eine Führungskraft stellt eine Frage

- Die Frage springt durch Tools, Dashboards, Analysten und Entwicklung

- Die Definition der Kennzahl ändert sich mitten im Thread

- Die Antwort kommt zu spät, um noch relevant zu sein

Agentische Datenanalyse zielt auf die Architektur hinter diesem Schmerz ab: Sie reduziert Übergaben, während sie Geschäftsbedeutung und Governance intakt hält.

Was ist agentische Datenanalyse?

Agentische Datenanalyse ist kein „Chatbot, der SQL schreibt“.

Es ist ein KI-System, das planen, ausführen, validieren und iterieren kann – durch mehrstufige Analysen, während es in den Definitionen Ihrer Organisation verankert bleibt.

Auf hoher Ebene sollte ein agentischer Analyst in der Lage sein zu:

- Geschäftsabsicht verstehen (nicht nur Query-Syntax)

- Komplexe Fragen in kleinere analytische Aufgaben zerlegen

- Gesteuerte Geschäftsdefinitionen verwenden (Kennzahlen, Dimensionen, Regeln)

- Ergebnisse validieren und Randfälle behandeln

- Kontext über Folgefragen hinweg tragen („Teilen Sie das nach Region auf“)

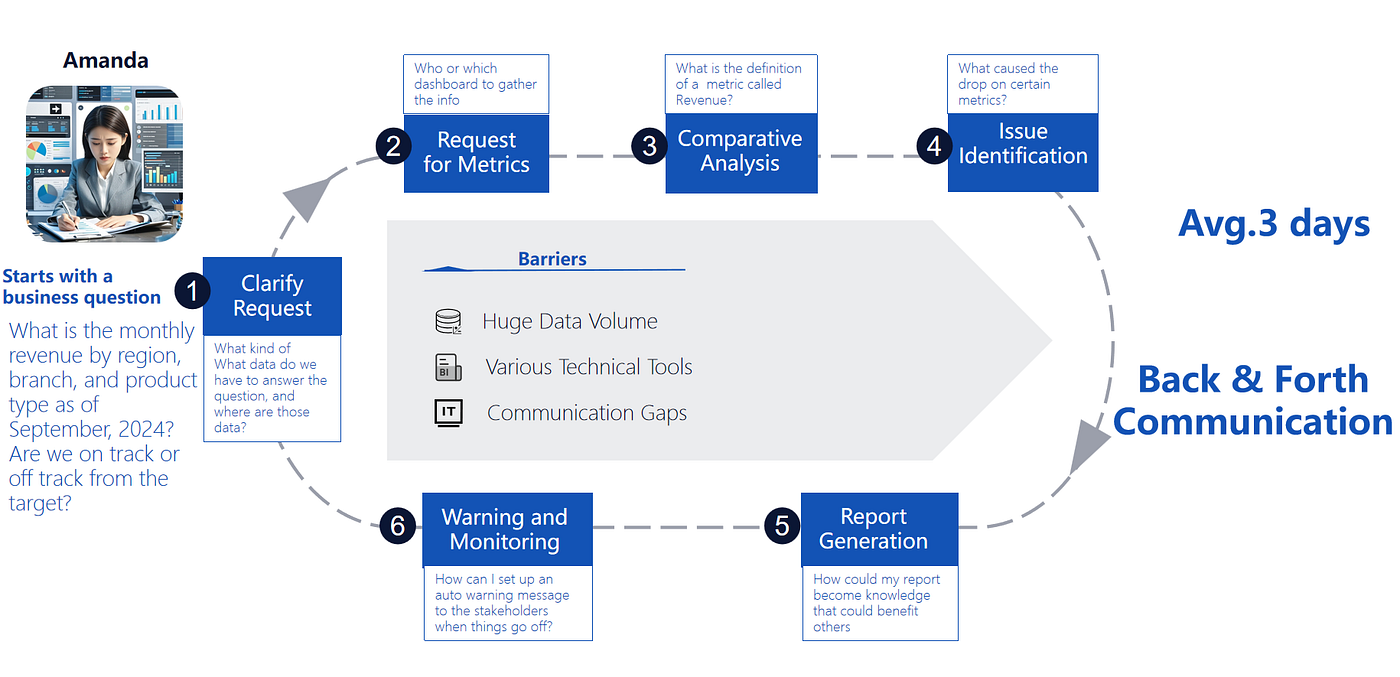

Wer profitiert: Das „Amanda“-Problem

Stellen Sie sich eine Führungskraft vor, die fragt:

> „Wie hoch sind die monatlichen Umsätze nach Region, Filiale und Produkttyp zum September 2024? Liegen wir im oder außerhalb des Zielpfads?“

Diese „eine Frage“ wird typischerweise zu einer Kette von Anforderungen:

- Klären, welche Daten existieren und wo sie sich befinden

- Abstimmung über Kennzahlendefinitionen (was zählt als Umsatz?)

- Untersuchung von Anomalien

- Umwandeln der Ergebnisse in einen teilbaren Bericht

- Einrichten von Überwachung oder Warnungen für die Zukunft

Agentische Analyse eliminiert das Hin und Her, indem sie Geschäftsanwendern direkte Fragen erlaubt – während das System die schwierigen Teile im Hintergrund übernimmt.

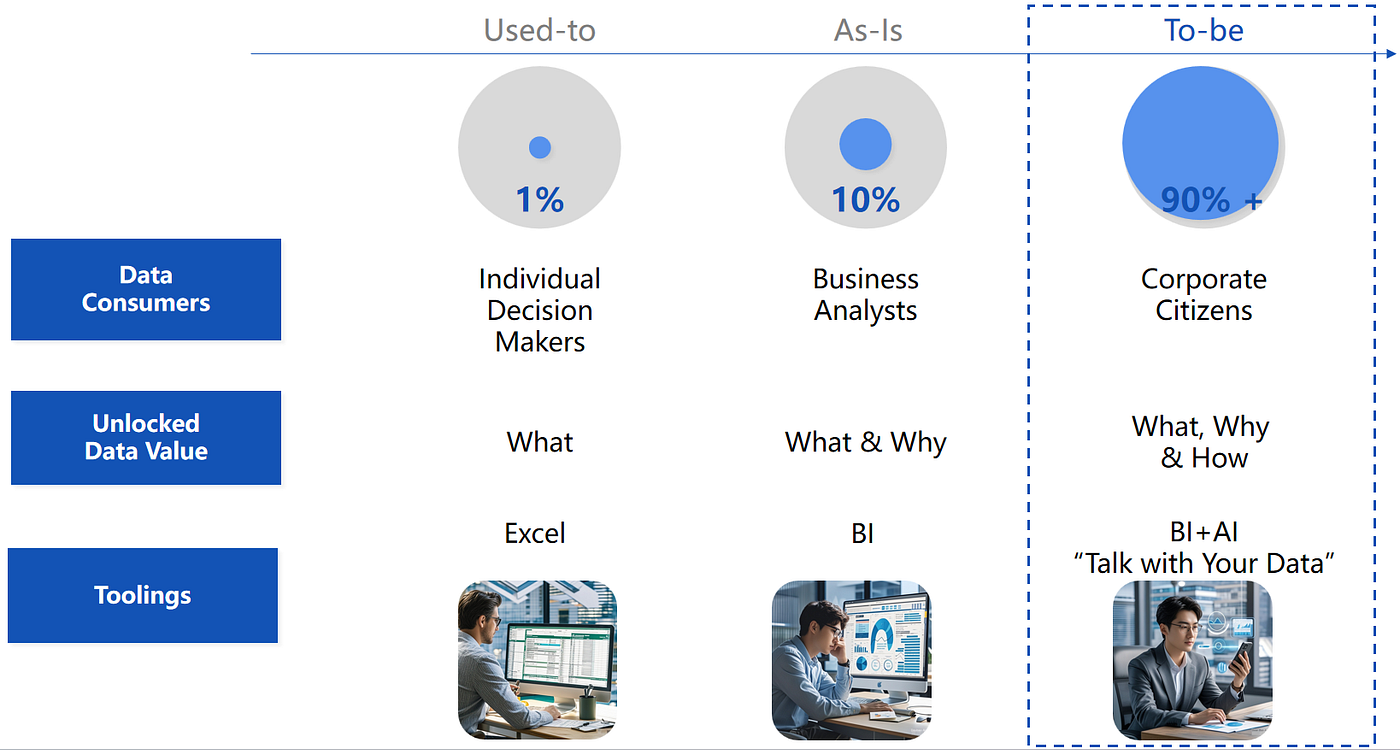

Die drei Epochen der Datenanalyse

Es hilft, agentische Analyse als Evolution zu betrachten, nicht als Ersatz.

Epoche 1: Das Excel-Zeitalter

- Datenkonsumenten: ~1%

- Entfesselter Wert: „Was“ (einfach deskriptiv)

- Werkzeuge: Tabellenkalkulationen und manuelle Workflows

Epoche 2: Das BI-Zeitalter

- Datenkonsumenten: ~10%

- Entfesselter Wert: „Was & Warum“ (deskriptiv + diagnostisch)

- Werkzeuge: Dashboards, Filter und Visualisierungsschichten

Epoche 3: Das Zeitalter der KI-Konversation

- Datenkonsumenten: 90%+

- Entfesselter Wert: „Was, Warum & Wie“ (inklusive präskriptiv)

- Werkzeuge: BI + KI, wobei die Analyse durch Konversation geleitet wird

Das Versprechen ist real – aber die Zuverlässigkeit ist die Hürde.

Warum LLMs allein keine zuverlässige Unternehmensanalyse liefern

In Unternehmensumgebungen scheitert direkter „natürliche Sprache → SQL“-Ansatz auf vorhersehbare Weise:

- Fehlender Geschäftskontext: „Umsatz“ kann fünf verschiedene Dinge bedeuten.

- Undurchsichtige Schemata: Spaltennamen erklären sich selten selbst.

- Join-Komplexität: Data Warehouses haben hunderte Tabellen mit brüchiger Join-Logik.

- Eingebettete Regeln: Transformationen und Ausschlüsse leben im Code, nicht in den Datenbanknamen.

Dies ist der Grund, warum Organisationen selbstbewusst aussehende, aber falsche Antworten erhalten.

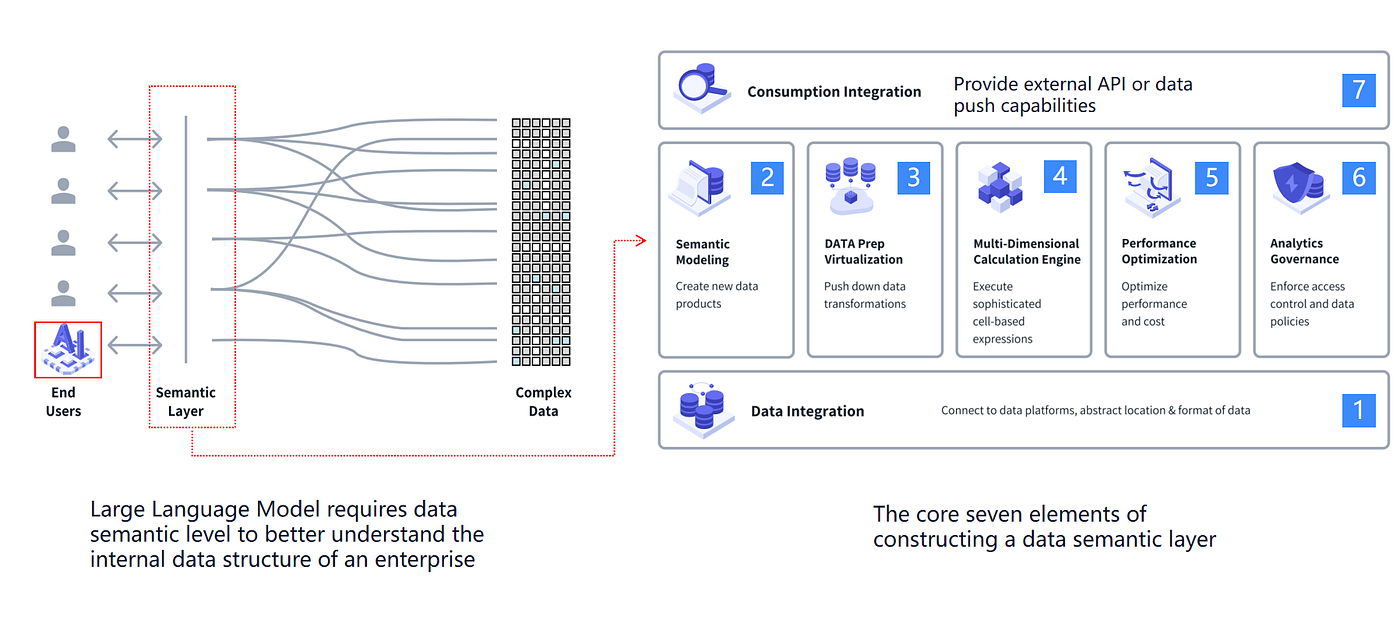

Die semantische Schicht: Das Fundament der Zuverlässigkeit

Eine semantische Schicht sitzt zwischen Endbenutzern (und KI) und Rohdatensystemen und bildet Geschäftskonzepte auf technische Implementierungen ab.

Sie wandelt:

- „Umsatz“ in eine gesteuerte Kennzahldefinition

- „Aktiver Kunde“ in eine konsistente Regel

- „Region“ in die korrekte Dimensionszuordnung

Die Kernelemente einer starken semantischen Schicht

Während Implementierungen variieren, benötigen die meisten unternehmensweit genutzten semantischen Schichten:

- Datenintegration über Plattformen hinweg

- Semantische Modellierung (Kennzahlen + Dimensionen, die Geschäftskonzepten entsprechen)

- Virtualisierung / Pushdown von Transformationen

- Eine Berechnungsengine für konsistente Kennzahlenlogik

- Leistungsoptimierung

- Governance (RBAC, Richtlinien, PII-Handhabung)

- Konsumationsintegration (APIs, BI-Tools, eingebettete Anwendungsfälle)

Ontologie + semantische Schicht: Bedeutung maschinenlesbar machen

In Datensystemen definiert eine Ontologie:

- Entitäten (Kunden, Bestellungen, Transaktionen)

- Attribute (Datum, Betrag, Status)

- Beziehungen (Bestellungen enthalten Produkte)

- Regeln (Beschränkungen und Logik)

Eine semantische Schicht ist oft der praktischste Weg, diese Ontologie für Analysen zu implementieren.

Wenn Kennzahlen und Dimensionen kodifiziert sind, können Agenten semantisches Schlussfolgern durchführen:

- Begriffe disambiguieren („Brutto- vs. Netto-Umsatz“)

- Gruppierungen ableiten („Premium-Kunden“)

- Definitionen konsistent über Teams hinweg halten

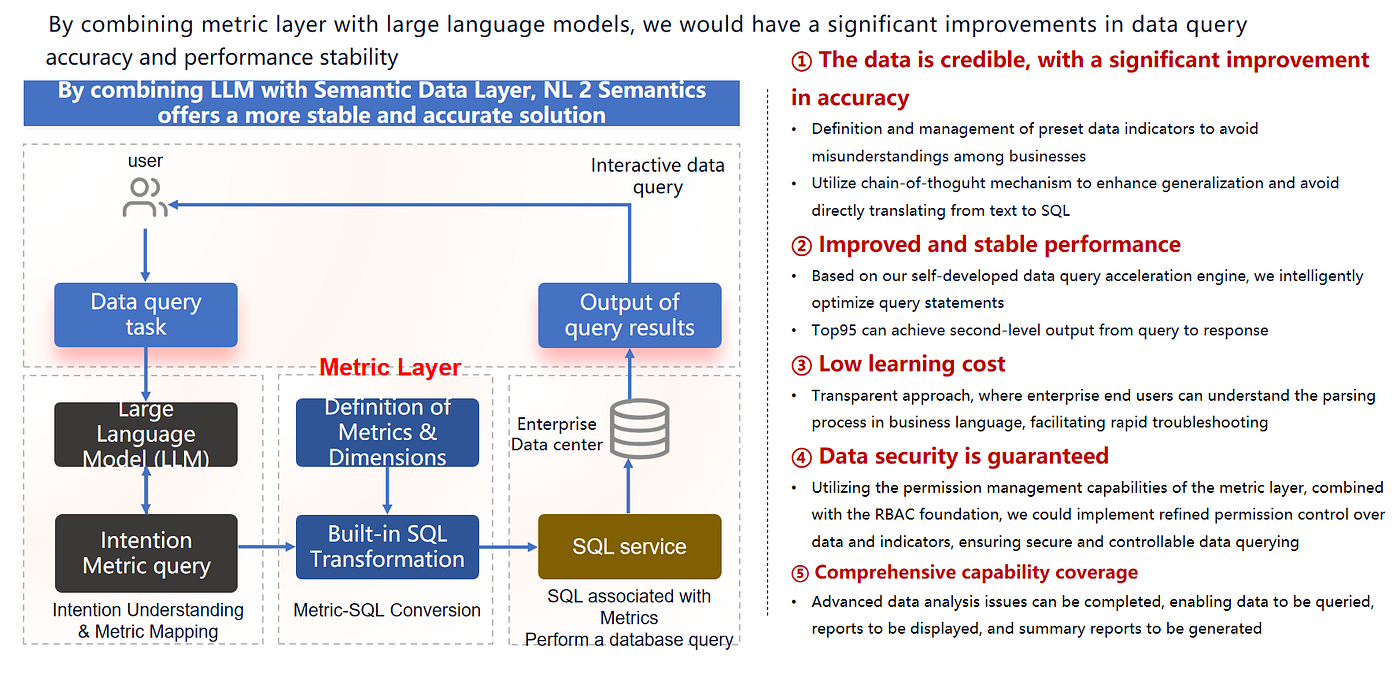

Warum Agentenarchitektur + semantische Schicht reinem LLM-to-SQL überlegen ist

Anstatt ein LLM zu bitten, rohes SQL zu generieren, ist der bessere Ablauf:

- Absicht interpretieren

- Auf gesteuerte Kennzahlen/Dimensionen in der semantischen Schicht abbilden

- Validierte Transformationen verwenden (Metrik-Schicht SQL)

- Durch einen kontrollierten Abfragedienst ausführen

- Ergebnisse zurückgeben, die über Folgefragen explorierbar sind

Häufige Fehlermodi, die dies vermeidet

- Schema-Halluzinationen (Tabellen, die nicht existieren)

- Falsche Joins (besonders mehrstufig und selbstreferenzierend)

- Abweichung der Geschäftslogik (falsche Filter, fehlende Ausschlüsse)

- Leistungsdesaster bei Abfragen (Volltabellenscans)

- Sicherheitsblindstellen (Berechtigungen, PII-Exposition)

Warum es in der Praxis besser funktioniert

Die Kombination bietet:

- Glaubwürdigkeit: gemeinsame Kennzahldefinitionen reduzieren teamübergreifende Debatten

- Stabile Leistung: optimierte, wiederverwendbare Abfragepläne

- Geringere Lernkosten: Benutzer können sehen, wie Absicht auf Kennzahlen abgebildet wurde

- Sicherheit: RBAC und Governance werden auf der semantischen Schicht durchgesetzt

- End-to-End-Workflows: Abfragen → visualisieren → zusammenfassen → teilen → überwachen

Praktische Leitlinien für Teams, die agentische Analysen einführen

Wenn Sie eine agentische Analyseplattform aufbauen (oder kaufen), beginnen Sie hier:

1) Investieren Sie zuerst in die semantische Schicht

Definieren Sie Kennzahlen und Dimensionen mit Geschäftsinteressengruppen. KI kann nicht für undefined Bedeutung sorgen.

2) Bevorzugen Sie echte Agenten gegenüber „Chat mit Ihren Daten“-Hüllen

Mehrstufige Planung, Validierung und gesteuerte Ausführung sind auf Unternehmensebene nicht optional.

3) Planen Sie kontinuierliche Iteration

Semantische Definitionen entwickeln sich weiter, wenn sich Ihr Geschäft verändert. Behandeln Sie sie als Produkte.

4) Messen Sie relevante Ergebnisse

- Entspricht das Ergebnis dem, was ein guter Analyst produzieren würde?

- Wie stark ist die Zykluszeit gesunken?

- Wie viele Benutzer wurden zu Self-Servern?

- Wie viele Analysten-„Erkläre dieses Dashboard“-Meldungen sind verschwunden?

Fazit: Demokratisierung von Daten ist endlich praktikabel

Das Ziel ist nicht, Analysten zu ersetzen. Es ist, ihre Wirkung zu erweitern:

- Analysten kodifizieren Definitionen und Governance

- Agenten machen diese Definitionen für alle zugänglich

Wenn Geschäftsanwender sicher fragen und iterieren können – wobei die semantische Schicht die Antworten verankert – hört Daten auf, ein Engpass zu sein, und wird zu einem Wettbewerbsvorteil.

Wichtige Erkenntnisse

- Direkter LLM-to-SQL scheitert an Schemata, Joins, Geschäftsregeln, Leistung und Sicherheit.

- Eine semantische Schicht liefert die Bedeutung, Governance und Konsistenz, die KI benötigt.

- Agentenarchitektur verwandelt Fragen in mehrstufige, validierte Analysen.

- Zusammen ermöglichen sie zuverlässige KI-Business-Intelligence für die 90%, nicht nur für die 10%.