La modalité de sortie est en train de changer : du texte que vous lisez aux visuels que vous expérimentez.

*Les figures et la mise en page correspondent à l'essai original sur Medium.*

Le moment où j'ai compris que tout avait changé

J'ai regardé une IA générer une vidéo cinématographique avec un dialogue synchronisé. Puis ça a fait tilt : l'IA basée sur le texte était déjà hier.

Cette semaine, ByteDance a publié Seedance 2.0 : vidéo cinématographique 1080p, audio natif synchronisé avec synchronisation labiale multilingue, narration multi-plans avec cohérence des personnages entre les scènes, jusqu'à neuf entrées d'image et trois entrées vidéo et trois entrées audio à la fois, et clips de 15 secondes qui peuvent sembler de qualité professionnelle.

La semaine dernière, Claude Opus 4.6 a été lancé avec une fenêtre de contexte d'un million de tokens et un codage agentique puissant. Pas seulement écrire du code : expédier des UI prêtes pour la production à partir d'une courte invite. GitHub Copilot l'a rapidement intégré. Les développeurs ont commencé à expédier des applications full-stack en quelques minutes.

Pendant ce temps, sur des tâches purement textuelles, GPT-5 contre Claude 4 Sonnet peut sembler interchangeable pour de nombreux utilisateurs.

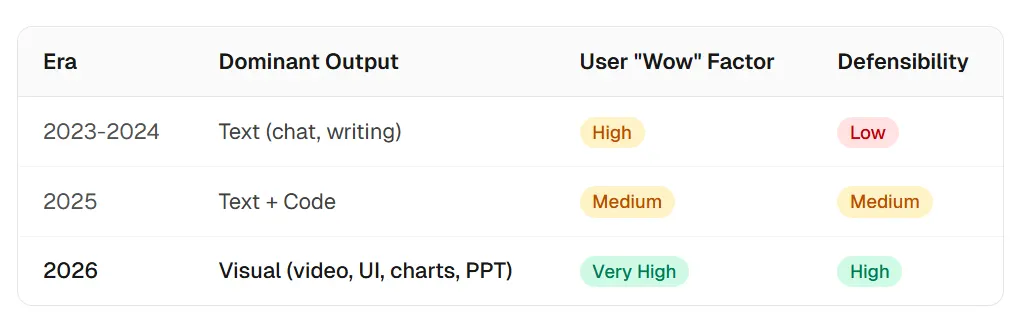

2026 n'est pas l'année où l'IA s'améliore marginalement dans l'écriture de texte. C'est l'année où l'IA s'améliore considérablement dans le fait de montrer des choses : vidéo, UI, graphiques, tableaux de bord, présentations. La modalité de sortie passe du texte aux visuels — et cela change quels produits gagnent.

Le Plateau du Texte : Pourquoi un « Meilleur Texte » ne Change Plus la Donne

GPT-5 contre Claude 4 : les différences sont réelles. L'écart de perception quotidien ? Souvent proche de zéro.

Les modèles de pointe en 2026 sont objectivement plus forts que leurs prédécesseurs de 2025. GPT-5 a introduit le raisonnement adaptatif — basculant entre des modes rapides et profonds. Claude Opus 4.6 a livré une fenêtre de contexte d'un million de tokens et de solides résultats de benchmarks. Le raisonnement, la précision factuelle et la vitesse ont tous progressé.

Mais sur la sortie textuelle, l'écart de perception utilisateur converge vers zéro.

DataStudios (2026) le dit clairement : les deux sont des poids lourds ; la philosophie diffère, mais discerner les sorties importe moins. Les gens rapportent une « fatigue des chatbots IA » — les principaux assistants peuvent sembler identiques.

La recherche sur le scaling des LLM renforce le plafond. Un PDF d'OpenReview note que pour les tâches à forte intensité de connaissances, plus de temps de calcul n'améliore pas de manière fiable la précision — et peut augmenter les hallucinations. Les rendements sur le polissage du texte diminuent.

Le « wow » a bougé. Peu de gens s'émerveillent devant un email poli. Un clip cinématographique de 15 secondes à partir d'une invite, une UI de production en une demi-minute, ou un deck de données de dix diapositives à partir d'un téléchargement Excel arrête encore la pièce.

La prochaine vague d'entreprises d'IA remarquables ne sera pas définie uniquement par qui écrit les meilleurs paragraphes. Elles seront définies par qui génère les meilleurs visuels.

L'Explosion Visuelle : Quatre Catégories Redéfinissant la Sortie IA

Texte-vers-vidéo. Texte-vers-UI. Texte-vers-graphique. Texte-vers-présentation. La couche d'expérience est en train d'être reconstruite.

Catégorie 1 : Génération Vidéo IA

Seedance 2.0 n'est pas un petit pas. Il redéfinit la catégorie : 1080p, audio généré en parallèle avec la vidéo, narration multi-plans avec des personnages cohérents, synchronisation labiale multilingue et entrées multimodales lourdes — plus proche d'un pipeline que d'un jouet. Voir aussi cette comparaison de WaveSpeed.ai de Seedance 2.0 contre Kling 3.0, Sora 2 et Veo 3.1.

Le domaine est encombré : Sora 2 (axé physique, ~12s), Veo 3.1 (cinématographique, ~8s), Kling 3.0 (fort en Chine). L'architecture d'entrée multimodale de Seedance 2.0 établit une nouvelle barre. Couverture de la réaction du marché : Silicon Republic sur les actions technologiques chinoises.

Contexte de dimensionnement du marché : MarketsandMarkets sur le marché de la génération d'images et vidéos IA (projection jusqu'en 2030, TCAC dans la trentaine élevée).

Catégorie 2 : Génération IA vers UI

v0 de Vercel transforme le langage en React et Tailwind de qualité production. Bolt, Lovable et Forge poussent des applications full-stack à partir d'invites. a16z sur l'ère « prompt-to-product » capture pourquoi le cycle idée-à-expédition s'est effondré.

Claude Opus 4.6 amplifie cela : un contexte d'un million de tokens permet à un assistant de contenir des bases de code entières tout en générant une UI avec une conscience architecturale. La vitesse de développement change lorsque le modèle voit l'ensemble du projet.

Catégorie 3 : Visualisation de Données IA

Les piles BI traditionnelles exigent une configuration manuelle, des langages de requête et des compétences en design. Les outils de visualisation natifs IA compressent le chemin : téléchargez des données, décrivez la vue, obtenez rapidement des graphiques et des tableaux de bord.

Le différenciateur difficile est la traçabilité. Les hallucinations textuelles se cachent facilement ; un mauvais graphique est évident. Cela impose des barres d'ingénierie plus élevées et un fossé de qualité naturel. La vitesse ne suffit pas — les chiffres doivent être justes.

Catégorie 4 : Génération de Présentations IA

Le marché des présentations IA était d'environ 1,5 milliard de dollars en 2025, avec des projections vers ~4,0 milliards de dollars d'ici 2033 à un TCAC d'environ 14 %. Gamma a rapidement augmenté ses utilisateurs ; Tome a quitté la catégorie. Le marché se divise entre outils axés sur la vitesse et outils axés sur la profondeur.

La frontière est constituée de pipelines multi-agents qui recherchent, analysent, conçoivent et vérifient — pas un seul passage LLM qui décore des puces. Les présentations sont le format universel des affaires ; les rendre natives IA est un énorme avantage.

Dans toutes les quatre catégories, la sortie passe de « texte que vous lisez » à « visuels que vous expérimentez ». L'industrie a passé 2023-2025 à affiner le canal textuel. En 2026, elle construit le canal visuel — là où la défendabilité réside souvent.

Pourquoi l'IA Visuelle est Plus Difficile (et Plus Défendable) que l'IA Textuelle

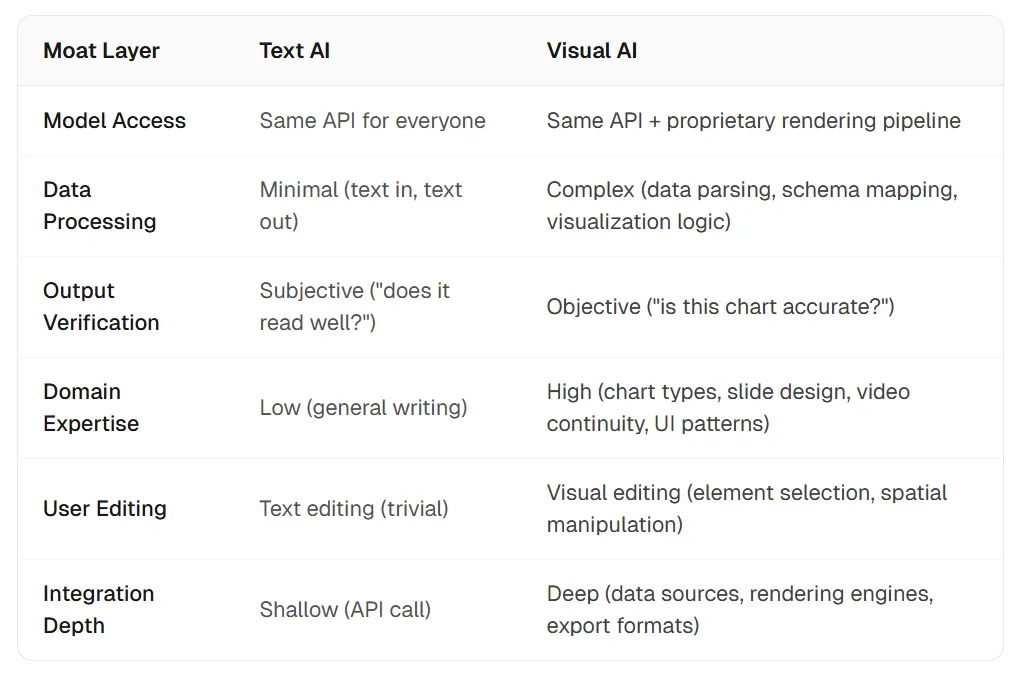

N'importe qui peut envelopper un LLM. Peu d'équipes peuvent livrer un véritable moteur visuel.

Les produits textuels se sont rapidement banalisés : appelez GPT ou Claude, formatez des chaînes, expédiez. Des milliers d'assistants d'écriture se sont mélangés. Fossés minces — mêmes modèles, mêmes API, qualité similaire.

L'IA visuelle résiste à ce schéma :

- Infrastructure de rendu — décodeurs vidéo, moteurs de graphiques, systèmes d'UI, moteurs de mise en page de diapositives.

- Connaissance du domaine — quel graphique correspond à quelle forme de données, comment les récits s'écoulent à travers les diapositives, comment les composants se composent.

- Pipelines multi-étapes — planification, récupération, analyse, rendu et vérification ; rarement un seul appel API.

D'ici fin 2026, les startups IA les plus précieuses penchent vers une sortie visuelle en premier. L'ère des wrappers API s'amincit ; l'ère des moteurs visuels s'accélère.

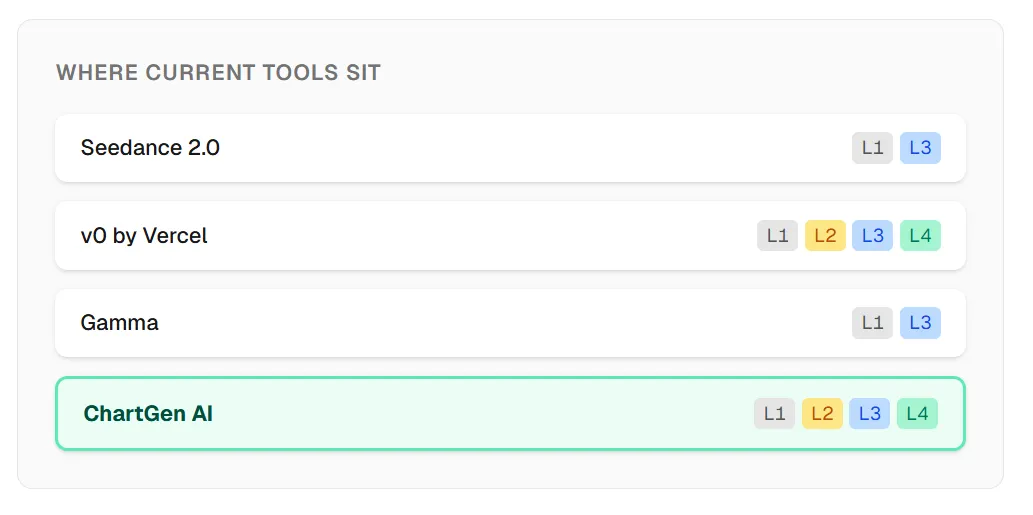

La Pile de l'IA Visuelle : Ce Qui Émerge

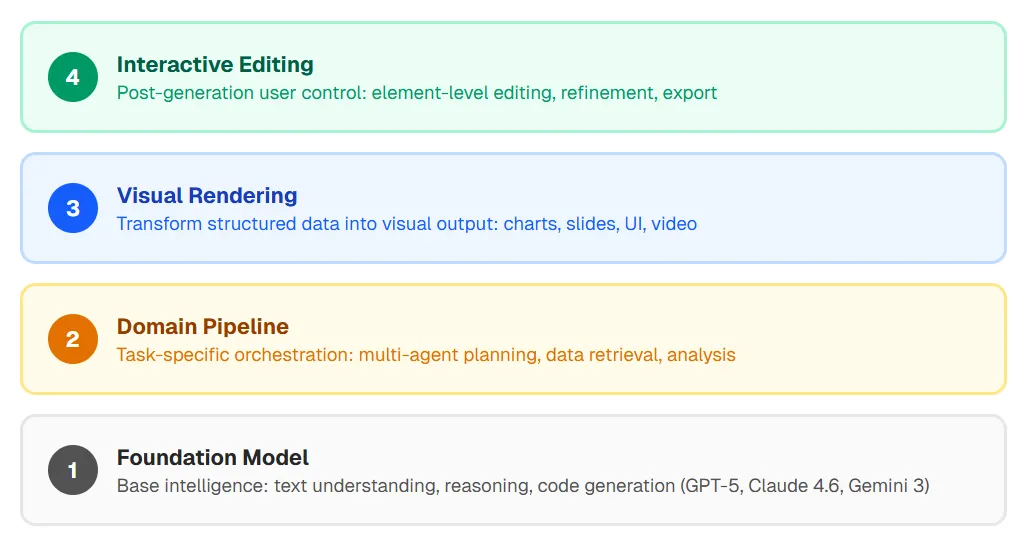

Un schéma à quatre couches apparaît dans toutes les catégories :

- Modèle fondamental

- Pipeline de domaine (planification, outils, récupération)

- Rendu visuel

- Édition interactive

La couche 1 seule est un wrapper de commodité. Les couches 1–2 sont puissantes mais souvent invisibles. Les couches 1–3 ressemblent à un véritable produit. Les couches 1–4 permettent aux utilisateurs de générer et itérer dans un seul environnement — la forme durable.

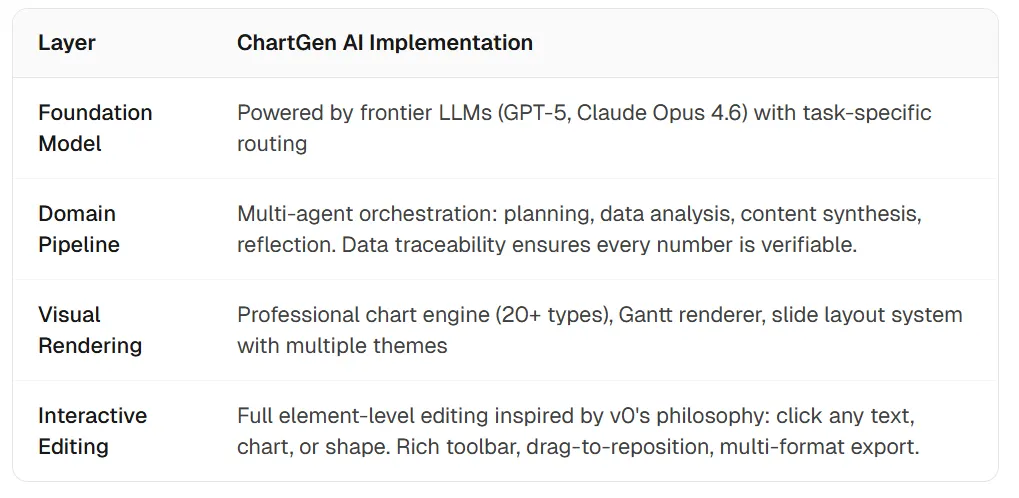

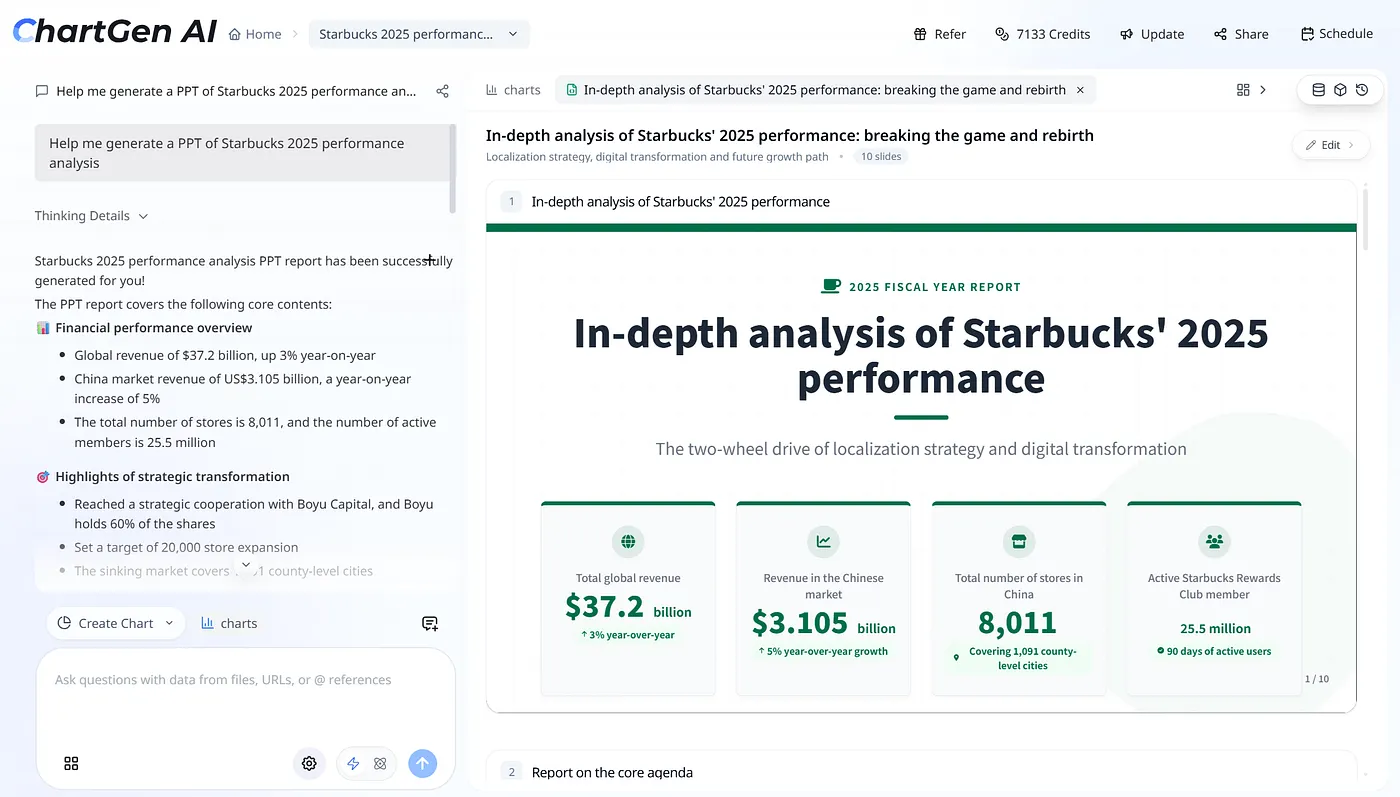

Étude de Cas : Comment ChartGen AI Incarne le Changement vers l'IA Visuelle

Nous n'avons pas lancé ChartGen AI pour suivre une tendance. Nous avons commencé avec une thèse étroite : les professionnels des données ne devraient pas avoir besoin d'être des designers pour créer des visuels convaincants. Au fur et à mesure que le produit grandissait, le schéma plus large est devenu évident — une plateforme de sortie IA vers visuel.

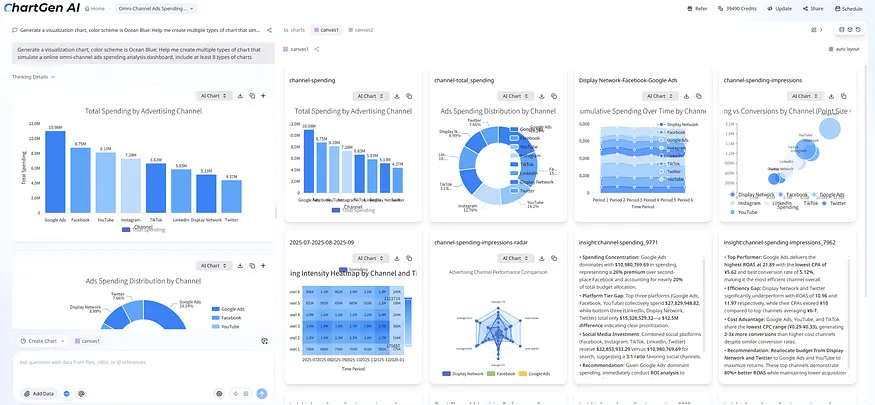

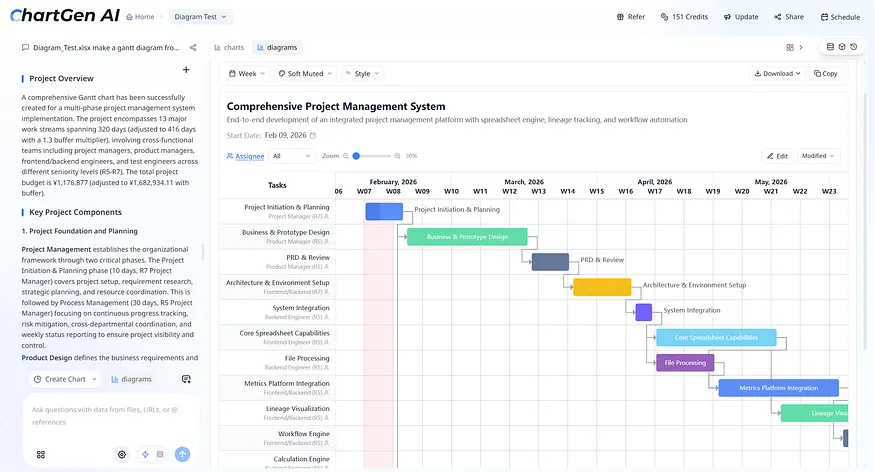

ChartGen AI se comporte comme un agent « IA vers UI » : langage naturel plus données en entrée ; graphiques, tableaux de bord, vues Gantt et présentations complètes en sortie. Chaque tour produit quelque chose que vous pouvez voir, modifier et partager — pas un mur de texte.

Trois Modes de Sortie Visuelle

Mode 1 — Visualisation de données. Téléchargez des données, demandez en langage naturel, obtenez des graphiques et des tableaux de bord sur un canevas infini avec traçabilité jusqu'aux lignes sources.

Mode 2 — Diagrammes de Gantt. Décrivez un projet ou téléchargez une feuille ; obtenez un Gantt interactif avec dépendances, responsables et progression, avec modifications en ligne.

Mode 3 — Présentations IA. Une seule invite peut piloter un pipeline multi-agents (planifier, rechercher, analyser, concevoir, réfléchir). Les tableaux et graphiques restent liés aux données sources ; l'édition est au niveau des éléments dans un éditeur de présentation dédié.

C'est le changement vers l'IA visuelle en pratique : un agent qui montre vos données — dans des artefacts auxquels vous pouvez faire confiance, affiner et présenter.

Quelle est la Suite : Cinq Prédictions pour la Vague de l'IA Visuelle

- La vidéo et la visualisation de données convergent — histoires de données animées, rapports trimestriels en forme de vidéo, tableaux de bord qui se jouent comme des présentations ; la ligne entre graphique et mouvement s'estompe.

- « IA vers UI » devient le flux de travail de développement par défaut — les outils de classe v0 rejoignent la boîte à outils quotidienne ; les contextes d'un million de tokens rendent la génération d'UI sur l'ensemble du dépôt normale.

- Les présentations IA dévorent la plupart des présentations internes — artefacts en une invite pour les mises à jour et les revues ; le polissage humain se concentre sur les moments externes les plus importants.

- « Agent IA visuel » devient une catégorie — outils pour analystes, produits et marketing qui par défaut produisent des livrables visuels, pas du défilement arrière.

- La compétition des modèles se déplace vers la qualité visuelle — les benchmarks pour les graphiques, les diapositives, l'UI et la vidéo comptent autant que les classements de prose.

Le passage de l'IA textuelle à l'IA visuelle n'est pas une amélioration de fonctionnalité. C'est un changement de plateforme — plus proche du passage de CLI à GUI ou du desktop au mobile que d'une mise à jour de modèle. Les bâtisseurs qui priorisent la sortie visuelle façonnent la prochaine décennie.

Montrer, Ne Pas Dire

Seedance 2.0 ne se contente pas de décrire une scène — il la montre, avec un audio synchronisé.

Claude Opus 4.6 ne se contente pas de décrire une UI — il peut expédier rapidement des interfaces prêtes pour la production.

v0 ne s'arrête pas à un cahier des charges — il expédie une UI fonctionnelle à partir d'une invite.

ChartGen AI ne s'arrête pas à décrire vos données — il les visualise dans des graphiques, tableaux de bord et présentations que vous pouvez modifier et défendre.

Le fil conducteur des produits les plus marquants de 2026 : moins de paragraphes à lire, plus d'artefacts à expérimenter.

Nous avons passé 2023-2024 à nous émerveiller de ce que l'IA pouvait dire. En 2026, nous nous émerveillons de ce qu'elle peut montrer. Le canal visuel est plus large et plus riche que le texte ne l'a jamais été — et les entreprises qui construisent pour lui définiront le paysage à venir.

Références

Essai source (figures et mise en page originale) : medium.com — 2026 : l'année où l'IA a arrêté de parler et a commencé à montrer

- seedance.io — Page produit Seedance 2.0

- wavespeed.ai — Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Annonce de Claude Opus 4.6

- datastudios.org — Comparaison GPT-5 vs Claude 4

- openreview.net — PDF sur le scaling des LLM (tâches de connaissances, rendements décroissants)

- marketsandmarkets.com — Marché de la génération d'images et vidéos IA

- htfmarketinsights.com — Rapport sur le marché des générateurs de présentations IA

- a16z.com — Constructeurs d'applications web IA / prompt-to-product

- siliconrepublic.com — Seedance 2.0 et actions technologiques chinoises

- neurocanvas.net — Aperçu de la génération d'images IA 2026

- lordofthewix.com — Progrès de l'image/vidéo IA 2020-début 2026