输出模态正在转变:从阅读文本到体验视觉。

*图表和布局与Medium上的原始文章一致。*

那一刻我知道一切都变了

我观看了一个AI生成带有同步对话的电影级视频。然后我意识到:基于文本的AI已经成为过去。

本周,字节跳动发布了Seedance 2.0:1080p电影级视频,原生同步音频并支持多语言唇形同步,多镜头叙事且角色一致性跨场景,最多同时输入9张图像、3个视频和3个音频,以及15秒的片段,看起来可以达到制作级别。

上周,Claude Opus 4.6推出,拥有百万令牌上下文窗口和强大的智能体编码能力。不仅仅是编写代码——从简短提示中交付生产级UI。GitHub Copilot迅速集成。开发者在几分钟内开始交付全栈应用。

与此同时,在纯文本任务上,GPT-5与Claude 4 Sonnet对许多用户来说感觉可以互换。

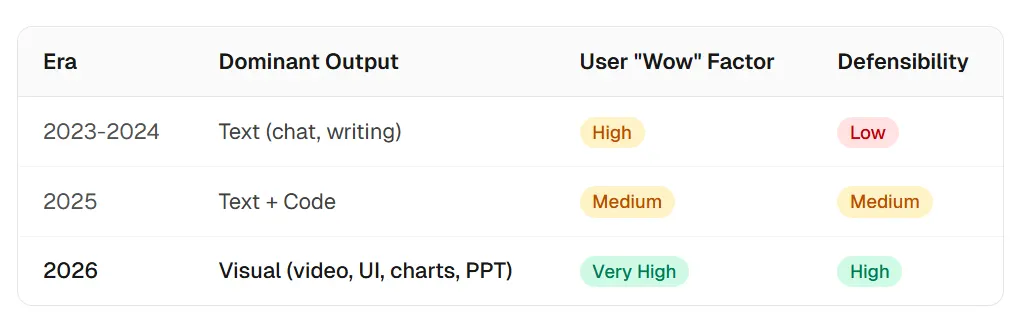

2026年不是AI在写文本方面略有进步的一年。而是AI在展示事物方面大幅提升的一年:视频、UI、图表、仪表盘、演示文稿。输出模态从文本转向视觉——这改变了哪些产品会胜出。

文本平台:为什么“更好的文本”不再起效

GPT-5 vs Claude 4:差异是真实的。日常感知差距?通常接近零。

2026年的前沿模型客观上都比2025年的前代更强。GPT-5引入了自适应推理——在快速和深度模式之间切换。Claude Opus 4.6提供了百万令牌上下文窗口和强劲的基准测试结果。推理、事实准确性和速度都提升了。

但在文本输出上,用户感知差距正在趋近于零。

DataStudios (2026)明确表示:两者都是强大的;哲学不同,但辨别输出不太重要。人们报告“AI聊天机器人疲劳”——主要助手听起来可能相同。

关于LLM扩展的研究加强了这一上限。一份OpenReview PDF指出,对于知识密集型任务,更多的计算时间并不能可靠地提高准确性——甚至可能增加幻觉。文本润色的回报正在递减。

“哇”效应转移了。很少有人会为了一封润色的电子邮件而惊叹。但一个从提示生成的15秒电影片段、半分钟内生成的生产级UI、或从Excel上传生成的十页数据演示文稿仍然能让全场安静。

下一波杰出的AI公司将不再仅由谁写出最好的段落来定义。它们将由谁生成最好的视觉来定义。

视觉大爆发:重新定义AI输出的四个类别

文本转视频。文本转UI。文本转图表。文本转演示文稿。体验层正在被重建。

类别1:AI视频生成

Seedance 2.0不是一小步。它重新定义了该类别:1080p,音频与视频并行生成,多镜头叙事并保持角色一致,多语言唇形同步,以及大量的多模态输入——更像一个流水线而非玩具。另见WaveSpeed.ai对比:Seedance 2.0 vs Kling 3.0、Sora 2、Veo 3.1。

该领域竞争激烈:Sora 2(注重物理,约12秒)、Veo 3.1(电影感,约8秒)、Kling 3.0(在中国表现强劲)。Seedance 2.0的多模态输入架构设定了新标杆。市场反应报道:Silicon Republic关于中国科技股。

市场规模背景:MarketsandMarkets关于AI图像和视频生成(预测到2030年,复合年增长率超过30%)。

类别2:AI到UI生成

Vercel的v0将语言转化为生产级React和Tailwind。Bolt、Lovable和Forge从提示推动全栈应用。a16z关于“提示到产品”时代捕捉了从想法到交付循环崩溃的原因。

Claude Opus 4.6放大了这一点:百万令牌上下文让助手在生成UI时能够持有整个代码库并具有架构意识。当模型看到整个项目时,开发速度发生了变化。

类别3:AI数据可视化

传统的BI堆栈需要手动配置、查询语言和设计技能。AI原生的可视化工具缩短了路径:上传数据,描述视图,快速获得图表和仪表盘。

最难区分的是可追溯性。文本幻觉容易隐藏;错误的图表显而易见。这迫使更高的工程标准和自然的质量护城河。速度不够——数字必须正确。

类别4:AI演示文稿生成

AI演示文稿市场在2025年大约15亿美元,预测到2033年约40亿美元,复合年增长率约14%。Gamma快速扩展用户;Tome退出了该类别。市场正在分裂为速度优先的工具和深度优先的工具。

前沿是多智能体流水线,进行研究、分析、设计和验证——而不是一次装饰要点的LLM传递。演示文稿是通用的商务格式;使其AI原生是一个巨大的解锁。

在所有四个类别中,输出从“阅读文本”转向“体验视觉”。行业在2023–2025年磨练了文本渠道。在2026年,它正在构建视觉渠道——防御性往往所在。

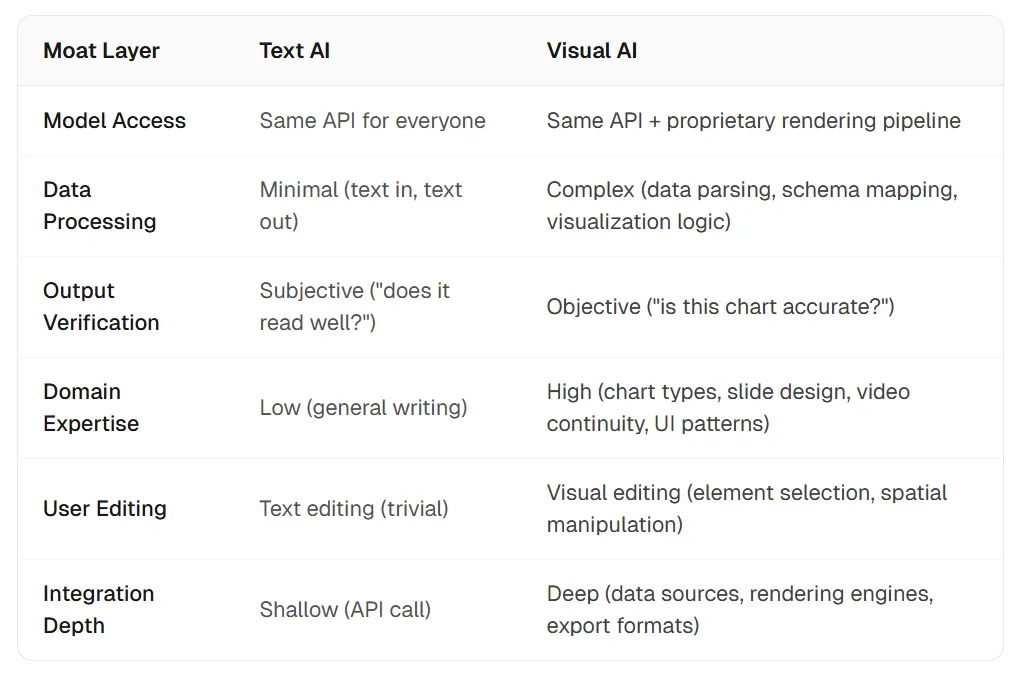

为什么视觉AI比文本AI更难(且更具防御性)

任何人都可以封装LLM。很少有团队能交付真正的视觉引擎。

文本产品很快商品化:调用GPT或Claude,格式化字符串,交付。数千个写作助手混为一谈。薄护城河——相同的模型、相同的API、相似的质量。

视觉AI抵抗这种模式:

- 渲染基础设施——视频解码器、图表引擎、UI系统、幻灯片布局引擎。

- 领域知识——哪种图表适合哪种数据形状,叙事如何在幻灯片间流动,组件如何组合。

- 多步流水线——规划、检索、分析、渲染和验证;很少是一次API调用。

到2026年底,最有价值的AI初创公司偏向视觉输出优先。API封装时代逐渐消退;视觉引擎时代加速。

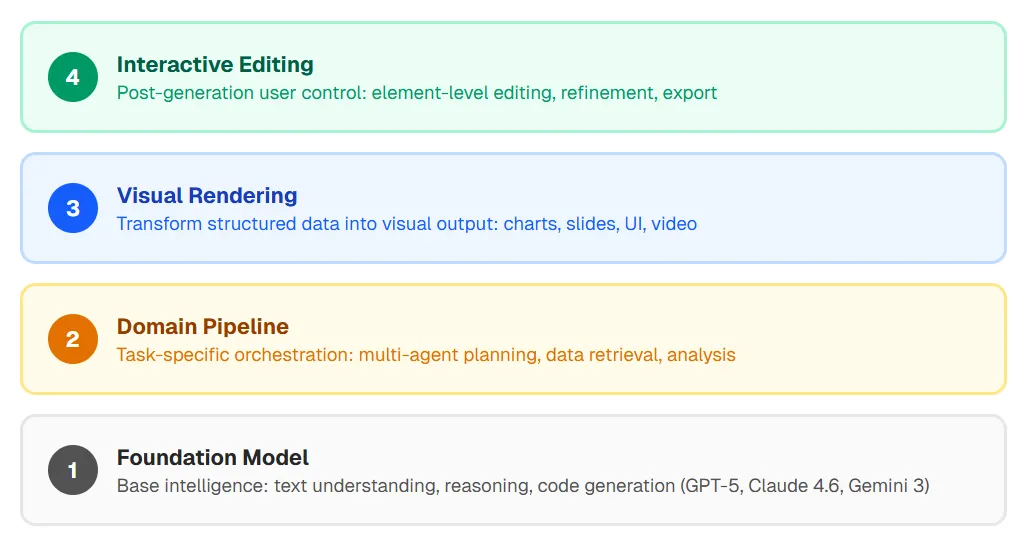

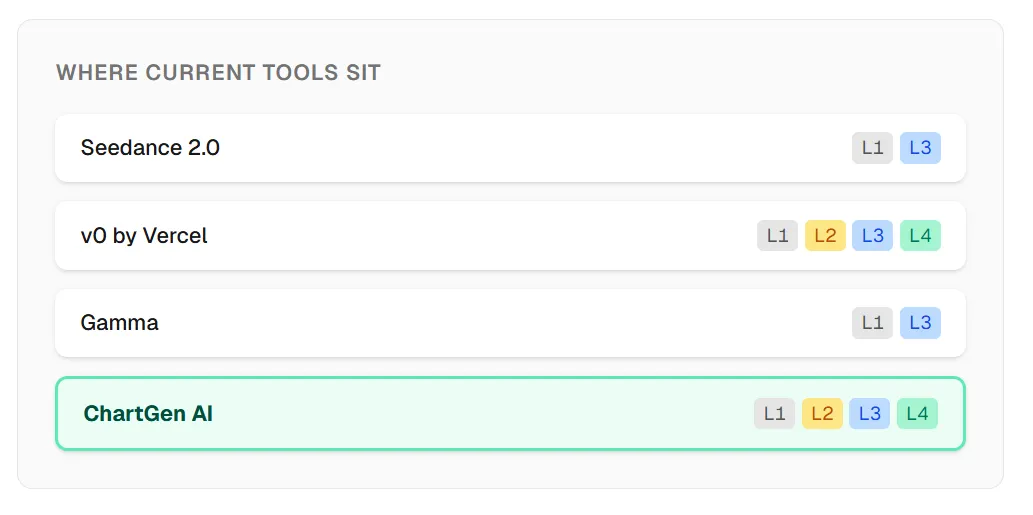

视觉AI技术栈:正在兴起的模式

一个四层模式在各个类别中出现:

- 基础模型

- 领域流水线(规划、工具、检索)

- 视觉渲染

- 交互式编辑

仅第一层是一个商品化封装。第1-2层强大但往往不可见。第1-3层感觉像真正的产品。第1-4层让用户在一个环境中生成和迭代——持久形态。

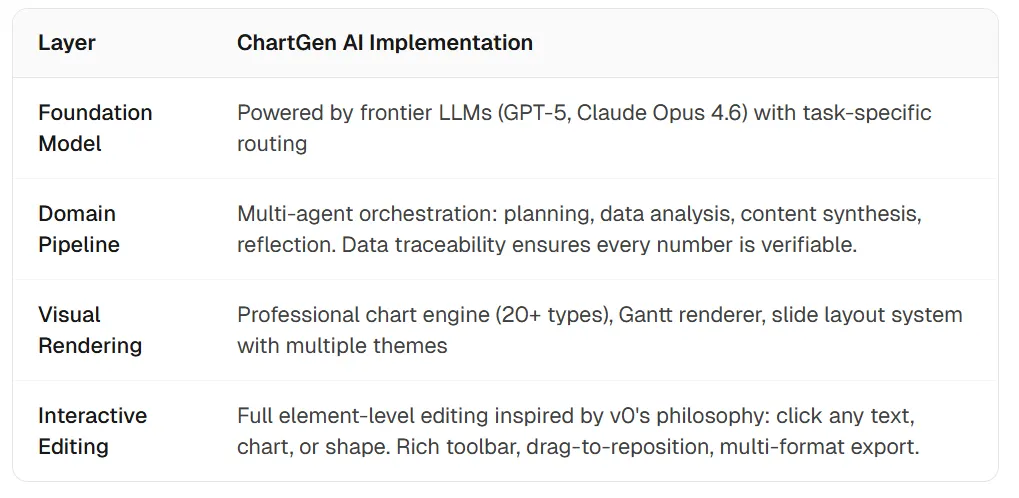

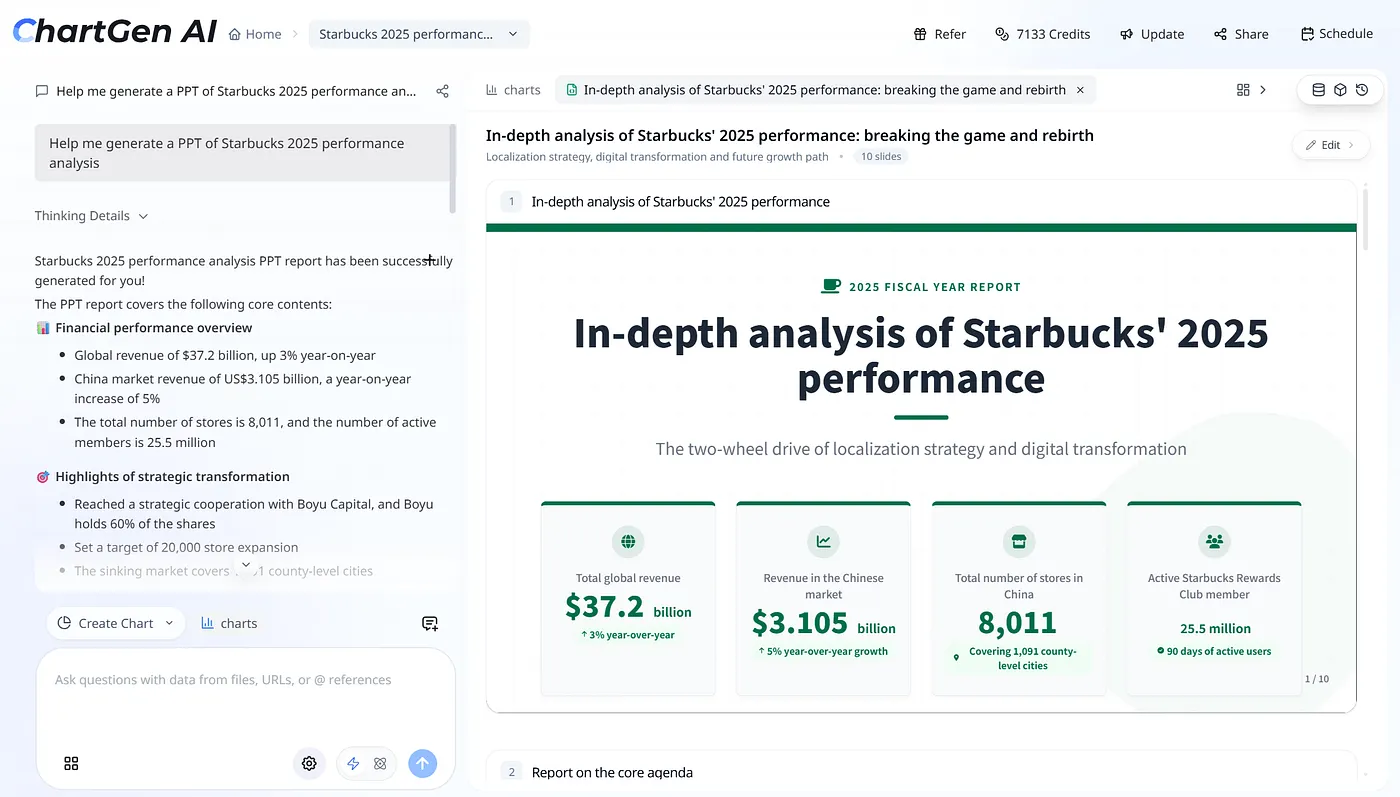

案例研究:ChartGen AI如何体现视觉AI转变

我们并非为了追逐趋势而创办ChartGen AI。我们从一个狭窄的论点开始:数据专业人士不应该需要成为设计师才能构建引人注目的视觉作品。随着产品的发展,更广泛的模式变得明显——一个AI到视觉输出平台。

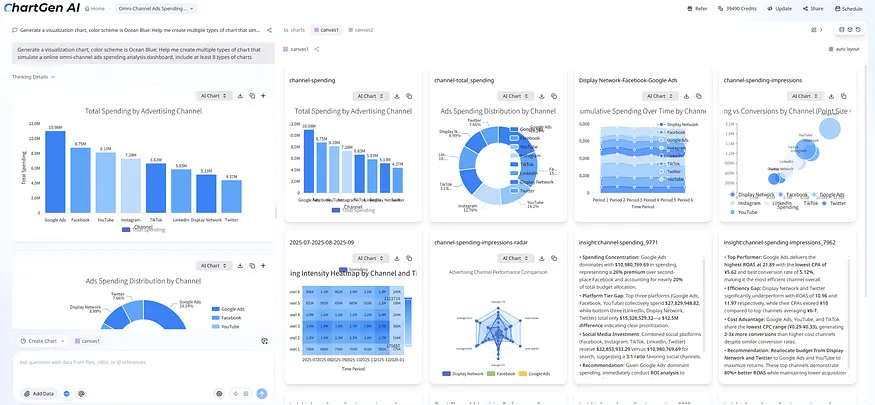

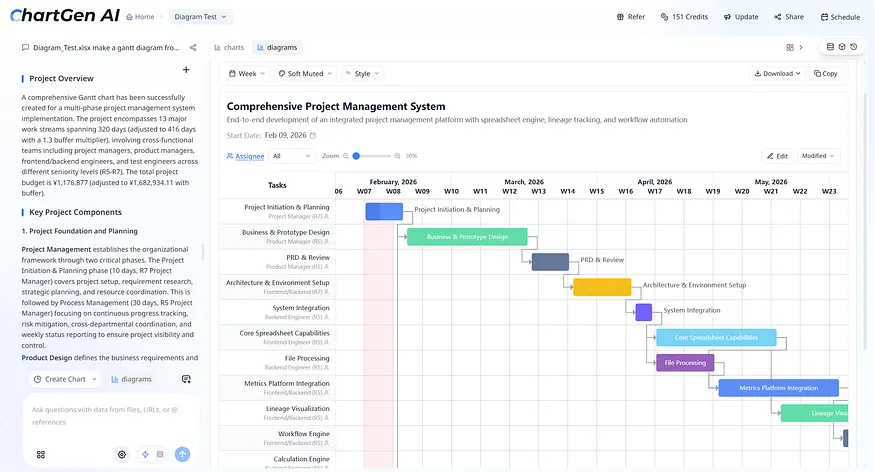

ChartGen AI的行为像一个“AI到UI”智能体:自然语言加上数据输入;图表、仪表盘、甘特图和完整演示文稿输出。每次互动都产生你可以看到、编辑和分享的东西——而不是一堵文本墙。

三种视觉输出模式

模式1 — 数据可视化。 上传数据,用自然语言提问,在无限画布上获得图表和仪表盘,并可追溯到源行。

模式2 — 甘特图。 描述一个项目或上传表格;获得交互式甘特图,包含依赖关系、负责人和进度,并支持内联编辑。

模式3 — AI演示文稿。 一个提示可以驱动多智能体流水线(规划、研究、分析、设计、反思)。表格和图表与源数据保持关联;编辑在专用演示文稿编辑器中进行元素级操作。

这就是视觉AI转变的实践:一个展示你的数据的智能体——以你可以信任、优化和呈现的制品形式。

接下来是什么:视觉AI浪潮的五个预测

- 视频和数据可视化融合——动画数据故事、视频形式的季度报告、像演示一样播放的仪表盘;图表和运动之间的界限模糊。

- “AI到UI”成为默认开发工作流——v0类工具加入日常工具包;百万令牌上下文使全仓库UI生成成为常态。

- AI演示文稿取代大多数内部演示文稿——一次提示生成更新和评审制品;人工润色集中于最高风险的外部场合。

- “视觉AI智能体”成为一个类别——分析、产品和营销工具默认提供视觉交付物,而不是滚动历史。

- 模型竞争转向视觉质量——图表、幻灯片、UI和视频的基准测试与文字排行榜同等重要。

从文本AI到视觉AI的转变不是功能上的提升。这是一个平台转变——更接近从命令行到图形界面或从桌面到移动,而不是模型刷新。优先考虑视觉输出的构建者将塑造未来十年。

展示,而非告知

Seedance 2.0不仅描述场景——它展示场景,并带有同步音频。

Claude Opus 4.6不仅描述UI——它可以快速交付生产级界面。

v0不止于规范——它从提示中交付工作UI。

ChartGen AI不止于描述数据——它将数据可视化为你能够编辑和辩护的图表、仪表盘和演示文稿。

2026年最具影响力的产品的主线:更少的段落需要阅读,更多的制品可以体验。

我们在2023–2024年惊叹于AI能说什么。在2026年,我们惊叹于它能展示什么。视觉渠道比文本更宽广、更丰富——为它而构建的公司将定义未来的格局。

参考文献

原始文章(图表和原始布局):medium.com — 2026:AI不再说话,开始展示的一年

- seedance.io — Seedance 2.0产品页面

- wavespeed.ai — Seedance 2.0 vs Kling 3.0、Sora 2、Veo 3.1

- anthropic.com — Claude Opus 4.6公告

- datastudios.org — GPT-5 vs Claude 4对比

- openreview.net — LLM扩展PDF(知识任务,收益递减)

- marketsandmarkets.com — AI图像和视频生成器市场

- htfmarketinsights.com — AI演示文稿生成器市场报告

- a16z.com — AI Web应用构建器/提示到产品

- siliconrepublic.com — Seedance 2.0和中国科技股

- neurocanvas.net — 2026年AI图像生成预览

- lordofthewix.com — AI图像/视频进展2020–2026年初