Kurze Antwort: A2UI (Agent-to-UI) ist ein von Google entwickeltes Open-Source-Protokoll, das es KI-Agenten ermöglicht, reichhaltige, interaktive Benutzeroberflächen zu generieren – Formulare, Diagramme, Karten, Dashboards – anstelle von reinem Text. Veröffentlicht im Dezember 2025 (v0.8 öffentliche Vorschau) erlaubt A2UI Agenten, deklarative JSON-Komponentenbeschreibungen zu senden, die Client-Anwendungen als native interaktive Widgets rendern. Für Datenteams bedeutet dies, dass KI erkundbare Dashboards anstelle von Aufzählungspunkten ausgeben kann, was die Art und Weise verändert, wie wir mit KI für Datenanalyse und Visualisierung interagieren.

1. Ihr KI-Agent hat geredet, obwohl er hätte zeigen sollen

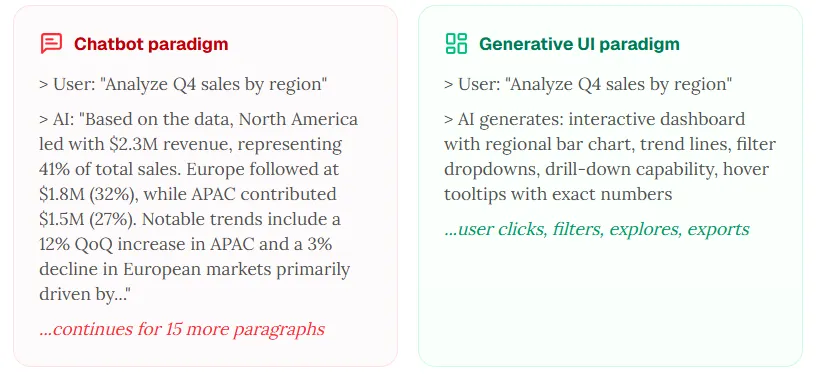

Das Chatbot-Paradigma war nie für Daten gemacht

Bitten Sie einen allgemeinen Assistenten, vierteljährliche Verkaufsdaten zu analysieren. Was erhalten Sie? Eine Textwand. Aufzählungspunkte. Vielleicht einen Codeblock, den Sie in ein Notebook kopieren müssen, um das Diagramm tatsächlich zu sehen. Das Modell versteht Ihre Daten vielleicht – aber es antwortet oft im primitivsten Format: Absätzen.

Seit 2022 interagieren wir mit bemerkenswert fähigen Modellen über ein lineares, reines Text-Chatfenster – im Wesentlichen dieselbe grundlegende Form wie klassisches IRC. Das System kann über komplexe Datensätze nachdenken, Anomalien erkennen und Empfehlungen vorschlagen – doch die Schnittstelle ist eine scrollende Liste von Nachrichten, die Sie von oben nach unten lesen und dann vergessen.

Im Dezember 2025 hat Google A2UI (Agent-to-UI) als Open Source veröffentlicht – ein Protokoll, das es Agenten ermöglicht, reichhaltige, interaktive Benutzeroberflächen anstelle von reinem Text zu generieren. Formulare, Datumsauswahlen, Diagramme, Karten, Dashboards – nativ in Ihrer Anwendung gerendert, dynamisch vom Agenten generiert.

Die reale Demo ist überzeugend: Google zeigte einen Restaurant-Finder-Agenten, der ein Buchungsformular mit Datumsauswahl, Zeitauswahl und Senden-Button generierte – anstatt des mühsamen Text-Hin-und-Hers über mehrere Nachrichten, das viele Chatbots für eine einfache Reservierung benötigen. Für Datenteams ist die Implikation deutlicher: Der Agent kann ein erkundbares Dashboard generieren, anstatt einer Beschreibung der Daten.

2. Was ist A2UI? Eine verständliche Erklärung

Das Protokoll, das Agenten erlaubt, Oberflächen statt Absätze zu bauen

A2UI (Agent-to-UI) ist ein Open-Source-Protokoll, das es Agenten ermöglicht, deklarative UI-Beschreibungen – JSON-Nachrichten, die Schaltflächen, Formulare, Diagramme, Karten und Layouts beschreiben – an einen Client zu senden, der sie als native interaktive Komponenten rendert. Betrachten Sie es als "HTML für Agenten", mit stärkeren Sicherheits- und Portabilitätsstandards.

Das Problem, das A2UI löst: Vertrauensgrenzen

Wir befinden uns im Zeitalter der Multi-Agenten-Systeme. Agenten auf verschiedenen Servern und von verschiedenen Anbietern koordinieren sich. Sie können Ihre Benutzeroberfläche nicht direkt berühren.

Das alte Muster? Rohes HTML oder JavaScript in iframes ausliefern – schwer, visuell uneinheitlich und ein Sicherheitsrisiko. A2UIs Ansatz: Übertragen Sie UI, die sich wie Daten verhält, aber wie Design aussieht. Der Agent sendet eine JSON-Blaupause; der Client rendert sie mit seinen eigenen nativen Widgets.

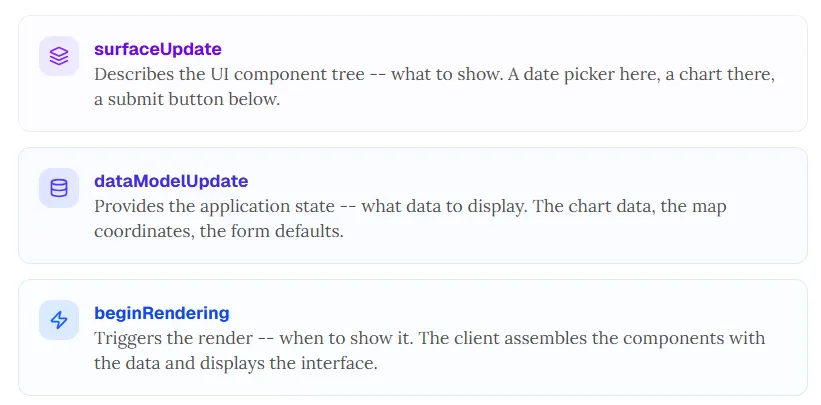

Wie es funktioniert: das Drei-Nachrichten-Muster

surfaceUpdate

Beschreibt den UI-Komponentenbaum – was anzuzeigen ist. Hier eine Datumsauswahl, dort ein Diagramm, darunter ein Senden-Button.

dataModelUpdate

Liefert den Anwendungszustand – welche Daten anzuzeigen sind. Die Diagrammreihen, die Kartenkoordinaten, die Formularvorgaben.

beginRendering

Löst das Rendern aus – wann es anzuzeigen ist. Der Client setzt Komponenten mit Daten zusammen und zeigt die Oberfläche an.

Für das Restaurant-Buchungsbeispiel: Der Agent sendet JSON, das eine Datumsauswahl, Zeitauswahl, Dropdown für Personenzahl und Senden-Button beschreibt. Der Client rendert jedes Stück mit seinem eigenen UI-Framework (React, Angular, Flutter, Lit), wendet sein eigenes Styling und seine Barrierefreiheitsstandards an und präsentiert ein kohärentes Formular. Kein iframe. Keine fremde Codeausführung.

Drei Kernentwurfsprinzipien

Sicherheit zuerst

Deklarative Daten, kein ausführbarer Code. Der Agent fordert Komponenten aus einem vertrauenswürdigen Katalog an – reduziert das Risiko beliebiger Codeausführung im Vergleich zur Auslieferung undurchsichtiger Skripte.

Natürliches Gefühl

Keine iframes. Der Client rendert mit seinem eigenen UI-Framework, sodass generierte UI die App-Styling-, Barrierefreiheits- und Leistungsmerkmale übernehmen kann.

LLM-freundliche Struktur

Eine flache Komponentenliste mit ID-Referenzen ist für Modelle einfacher zu generieren, zu korrigieren und progressiv zu streamen als ein ad-hoc Gemisch von Markup.

Das Ökosystem (v0.8 öffentliche Vorschau)

A2UI ist in der v0.8 öffentlichen Vorschau, veröffentlicht unter der Apache 2.0-Lizenz. Stabile Renderer existieren für Lit, Angular und Flutter (über Googles GenUI SDK). React-Unterstützung war für Q1 2026 geplant, SwiftUI und Jetpack Compose für Q2. Das Protokoll unterstützt mehrere Transporte, darunter das A2A-Protokoll, AG UI, SSE und WebSockets.

Zu den Ökosystempartnern am Tag Null gehören CopilotKit/AG UI (Kompatibilitätsschicht), Opal (KI-Mini-Apps), Gemini Enterprise und Flutters GenUI SDK. Dies ist Googles Wette auf einen offenen Standard für agentengesteuerte Oberflächen – und die Auswirkungen auf die Datenvisualisierung sind groß.

3. Warum Chatbots bei der Datenanalyse scheitern: die fünf Wände

Ein Chatfenster ist die falsche Oberfläche zur Erkundung von Daten

Chat funktioniert für Fragen und Antworten, Schreiben und Codegenerierung. Es versagt kläglich bei Analysen, die räumlich, interaktiv und visuell sein sollten. Hier sind fünf Wände – und wie ein generativer UI-Ansatz jede adressiert.

Wand 1: die Textwand

Bitten Sie einen Chatbot, zehntausend Zeilen Verkaufsdaten zu analysieren. Sie erhalten möglicherweise viele Absätze mit Aufzählungspunkten. Die menschliche visuelle Verarbeitung ist für Mustererkennungsaufgaben deutlich schneller als das Lesen von dichtem Text. Ein gut gestaltetes Diagramm kann in unter einer Sekunde kommunizieren, wofür Minuten benötigt werden, um Prosa zu parsen.

Was Sie stattdessen brauchen: Ein interaktives Diagramm mit Hover-Details, Drill-Down und Datumsfiltern.

Wand 2: die Linearitätswand

Chat ist sequenziell – jede Nachricht konkurriert um Aufmerksamkeit. Sie können nicht gleichzeitig den Umsatztrend, die Kundensegmentierung und die Margenanalyse auf einen Blick sehen. Analyse ist räumlich, nicht nur zeitlich.

Was Sie stattdessen brauchen: Ein mehrteiliges Dashboard, bei dem Ansichten nebeneinander liegen und reaktiv aktualisiert werden.

Wand 3: die Interaktionswand

Möchten Sie nur Q3? Sie tippen "filtere auf Q3". Der Agent regeneriert möglicherweise die gesamte Analyse. Möchten Sie Juni vergrößert? Eine weitere Nachricht. Vergleich mit dem letzten Jahr? Noch eine Nachricht. Interaktionen, die ein Klick sein sollten, werden zu einem Satz, einem Aufruf, einer vollständigen Neuschreibung.

Was Sie stattdessen brauchen: Native Dropdowns, Bereichsauswahlen und Schalter, die sofort reagieren.

Wand 4: die Erkundungswand

Analyse ist nichtlinear: einer Anomalie folgen, umschwenken, zurücktreten, einen anderen Blickwinkel versuchen. Chat-Threads sind permanent und sequenziell – Sie können die Erkundung nicht "rückgängig machen", wie Sie es in den zustandsbehafteten Steuerelementen eines Dashboards können.

Was Sie stattdessen brauchen: Interaktiven Zustand mit Rückgängig, Wiederholen und verzweigter Erkundung.

Wand 5: die Präsentationswand

Sie haben die Erkenntnis gefunden – aber das Artefakt ist ein langer Chat-Thread. Das ist schwer als Dashboard oder präsentationsreife Geschichte zu exportieren.

Was Sie stattdessen brauchen: Exportierbare Dashboards, herunterladbare Diagramme und Ein-Klick-Deck-Generierung, wo das Produkt dies unterstützt.

Das Fazit: Chat optimiert auf Konversation, nicht auf Erkundung. A2UI ist ein Weg zu Oberflächen, die der tatsächlichen Arbeitsweise von Analysten entsprechen.

4. A2UI für Datenvisualisierung: das RizzCharts-Beispiel

Google zeigte bereits eine agentenbasierte Analyseoberfläche

Der Agent sendet deklarative Komponentenbeschreibungen. Der Client rendert sie als native interaktive Widgets.

Was RizzCharts ist

RizzCharts ist Googles offizielles A2UI-Beispiel – ein KI-gestütztes E-Commerce-Dashboard, das das generative UI-Paradigma für Visualisierung demonstriert. Das Interaktionsmodell unterscheidet sich von Chat-First-Tools:

- Benutzer: "Zeige Umsatzaufteilung nach Kategorie" → Agent generiert ein interaktives Donut-Diagramm mit Drill-Down, nativ gerendert.

- Benutzer: "Gab es Ausreißer-Filialen?" → Agent generiert eine Karte mit hervorgehobenen Markierungen und Tooltips.

- Benutzer klickt auf ein Segment → das Dashboard bohrt in Unterkategorien ohne neuen Chat-Durchlauf.

Keine Codeausführung im Client aus dem Agentenpaket, kein iframe – deklaratives JSON wird als native Komponenten gerendert. Der Agent (Gemini plus Google ADK im Beispiel) ruft Daten über Tools wie get_sales_data und get_store_sales ab und erstellt dann A2UI-Nutzdaten unter Verwendung des surfaceUpdate → dataModelUpdate → beginRendering-Flusses.

Warum das wichtig ist

Der Agent analysiert Daten nicht nur in Text – er erstellt eine Oberfläche, die der Benutzer erkunden kann. Die Trennung von Struktur und Zustand bedeutet, dass Diagramme reaktiv aktualisiert werden können, wenn neue Daten eintreffen. Dasselbe JSON kann auf Web-, Mobil- und Desktop-Oberflächen abzielen. Benutzerdefinierte Kataloge können A2UI mit domänenspezifischen Komponenten erweitern: Finanzdiagramme, medizinische Zeitachsen, technische Diagramme, Geodatenebenen.

Die Einschränkung

A2UI ist ein Protokoll, kein Produkt. Es definiert, wie Agenten UI kommunizieren – nicht die Bereinigung, Statistik, Diagrammtypauswahl und das Design-Denken, die vor der UI stattfinden müssen. Ein vollständiger Visualisierungsworkflow benötigt weiterhin eine Intelligenzschicht, die entscheidet, was angezeigt werden soll und warum.

5. Vom Protokoll zum Produkt: Wie eine generative UI-Datenplattform aussieht

A2UI definiert den Transport; Intelligenz ist der Ort, an dem sich der Wert konzentriert

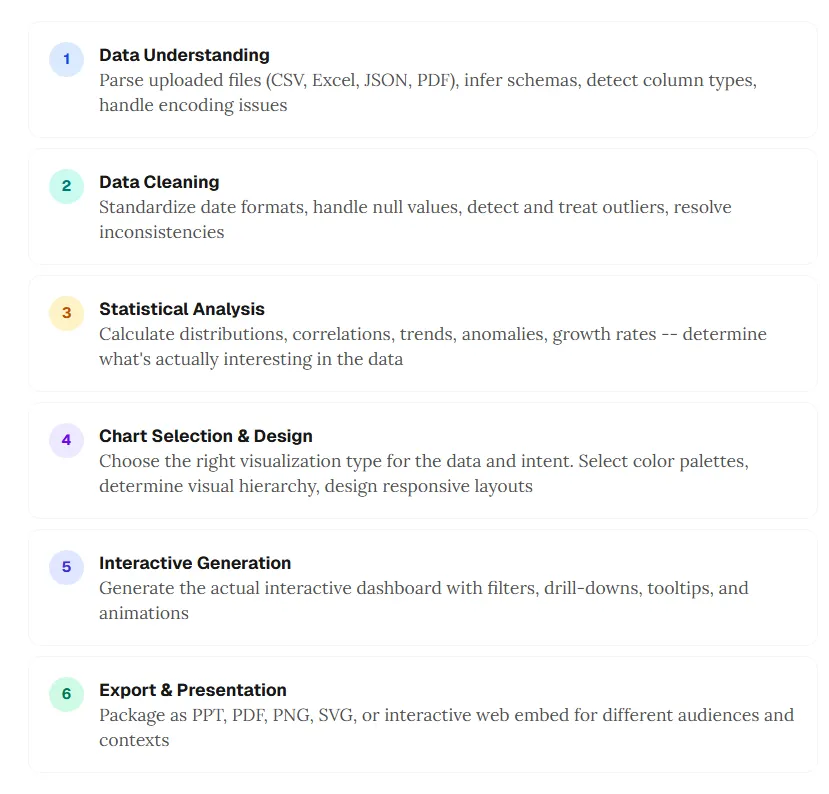

A2UI zielt auf die letzte Meile ab: interaktive UI vom Agenten zum Bildschirm zu bringen. Die gesamte Pipeline benötigt dennoch Tiefe jenseits des Transports:

- Datenverständnis – CSV, Excel, JSON, PDF parsen; Schemas ableiten; Spaltentypen erkennen; Kodierungsrandfälle behandeln.

- Datenbereinigung – Daten standardisieren; Nullwerte behandeln; Ausreißer behandeln; Inkonsistenzen auflösen.

- Statistische Analyse – Verteilungen, Korrelationen, Trends, Anomalien, Wachstum – entscheiden, was interessant ist.

- Diagrammauswahl und -design – Diagrammtyp an die Absicht anpassen; Farbpaletten; visuelle Hierarchie; responsives Layout.

- Interaktive Generierung – Filter, Drill-Downs, Tooltips, Bewegung, wo sie das Verständnis fördert.

- Export und Präsentation – PPT, PDF, PNG, SVG oder Einbettungen für verschiedene Zielgruppen.

A2UI hilft dabei, wie Schritt 5 den Client erreicht. Die Schritte 1–4 und 6 erfordern weiterhin Domänenintelligenz, die kein Protokoll ersetzt. Diese Lücke ist der Unterschied zwischen einem Standard und einem Produkt.

Wie ChartGen AI diese Philosophie umsetzt

Bei ChartGen AI bauen wir auf derselben generativen UI-Philosophie auf – nicht weil wir speziell das A2UI-Wire-Format ausliefern, sondern weil wir die Überzeugung teilen: Agenten sollten interaktive visuelle Arbeitsbereiche ausgeben, keine Absätze über Diagramme.

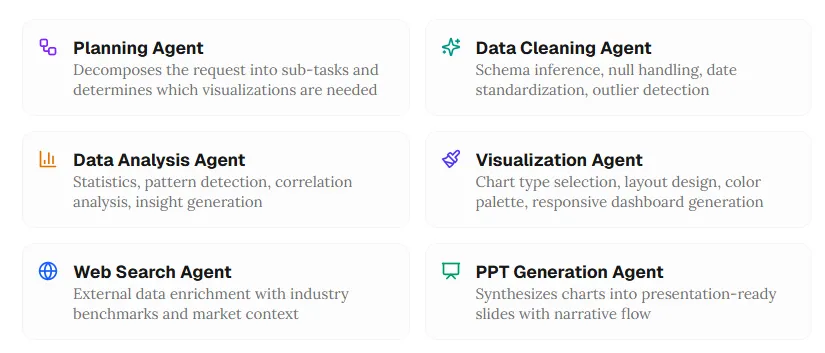

Laden Sie Daten in gängigen Formaten hoch und beschreiben Sie in natürlicher Sprache, was Sie möchten. Das System zielt auf ein erkundbares Dashboard ab – nicht nur eine Chat-Antwort. Sechs spezialisierte Agenten decken die Pipeline ab:

Planungsagent

Zerlegt die Anfrage in Teilaufgaben und entscheidet, welche Visualisierungen benötigt werden.

Datenbereinigungsagent

Schema-Inferenz, Nullbehandlung, Datumsstandardisierung, Ausreißererkennung.

Datenanalyseagent

Statistik, Mustererkennung, Korrelationsanalyse, Erkenntnisgenerierung.

Visualisierungsagent

Diagrammtypauswahl, Layout, Farbpalette, responsives Dashboard-Composing.

Websuche-Agent

Externe Anreicherung mit Benchmarks und Marktkontext, wenn relevant.

PPT-Generierungsagent

Verwandelt Diagramme und Erkenntnisse in präsentationsreife Folien mit narrativem Fluss.

Die Ausgabe soll eine Leinwand sein, auf die Sie klicken, filtern, bohren und exportieren können – generative UI angewendet auf Datenvisualisierungs-Workflows.

Die gemeinsame Philosophie: Agentengenerierte UI schlägt agentengenerierten Text für Daten

Ob der Transport A2UIs deklaratives JSON oder ein Multi-Agenten-Visualisierungsstack ist, die Erkenntnis ist dieselbe:

Für die Analyse ist das richtige Artefakt oft eine Oberfläche, kein Absatz.

- Agent schlägt die UI vor: Diagrammtypen, Layouts und Interaktionen, die auf den Datensatz abgestimmt sind – Benutzer sollten nicht mikromanagen müssen "erstellen Sie ein Balkendiagramm".

- Standardmäßig interaktiv: Hover, Drill, Filter – kein statischer Screenshot, der im Chat vergraben ist.

- Native Qualität: Die Oberfläche sollte sich wie ein Dashboard für Entscheidungen lesen, nicht wie eine Nachricht mit Anhang.

6. Die Zukunft: Was agentengesteuerte Oberflächen für Datenteams bedeuten

Drei Vorhersagen für 2026–2027

Chat-First-Tools werden generative UI-Schichten hinzufügen. Viele Analyseprodukte geben standardmäßig immer noch Text plus statische Bilder aus. Bis Ende 2027 werden mehr von ihnen interaktive Dashboards als erstklassige Ausgaben liefern – und offene Standards wie A2UI verringern die Abhängigkeit für die Art und Weise, wie das geschieht.

Die Arbeit des Analysten verschiebt sich vom Bauen zum Kuratieren. Wenn der Agent das Dashboard erstellt, führt der Mensch mit Fragen, validiert Erkenntnisse und formt die Erzählung – redaktionelles Urteilsvermögen mehr als manuelles Diagramm-Assemblierung.

Domänenspezifische Kataloge werden zu einem Burggraben. Das Protokoll ist offen; Wettbewerbsvorteil konzentriert sich in vertrauenswürdigen Komponentenbibliotheken und Domänenintelligenz – Risiko-Heatmaps, Kohortenansichten, Geo-Umsatzkarten und andere spezialisierte Primitive, auf die Teams angewiesen sind.

Was Sie jetzt tun können

- Entwickler: Experimentieren Sie mit A2UI (v0.8), ADK und Gemini, um agentengesteuerte Oberflächen mit deklarativem JSON zu erstellen.

- Analysten: Nutzen Sie Tools wie ChartGen AI, die Dashboards bereits als primäre Ausgabe behandeln.

- Produktverantwortliche: Bewerten Sie, wo interne Workflows von Chat-First-Prompts zu UI-First-Erkundung wechseln sollten – der ROI zeigt sich in Erkundungsgeschwindigkeit und Entscheidungsqualität.

7. Häufig gestellte Fragen

Was ist A2UI?

A2UI (Agent-to-UI) ist ein Open-Source-Protokoll von Google, das es Agenten ermöglicht, deklaratives JSON zu senden, das UI-Komponenten – Formulare, Diagramme, Karten, Dashboards – beschreibt, die Clients mit nativen Widgets rendern. Öffentliche Vorschau um v0.8 (Ende 2025) unter Apache 2.0.

Was ist generative UI?

Generative UI bedeutet, dass Modelle dynamisch aus Eingabeaufforderungen Layouts und interaktive Elemente erstellen, anstatt nur feste Vorlagen zu füllen. A2UI ist ein Protokoll, das auf Multi-Agenten- und übergreifende Vertrauensgrenzen-Umgebungen abzielt.

Warum sind Chatbots für die Datenanalyse schwach?

Sie serialisieren die Analyse in linearen Text. Erkundung profitiert von räumlichem Layout, direkter Manipulation und visuellen Elementen. Häufige Reibungspunkte sind die Textwand, Linearität, langsame Interaktionsschleifen, begrenzter Erkundungszustand und schwache Präsentationsartefakte.

Wie produzieren Agenten interaktive Dashboards?

Protokolle wie A2UI transportieren deklarative Beschreibungen von Komponenten und gebundenen Daten. Der Client rendert native Steuerelemente. Die Produktionsqualität hängt dennoch von vorgelagerter Bereinigung, Analyse und Design-Intelligenz ab – nicht nur vom Transport.

Was ist der Unterschied zwischen A2UI und generativer UI?

Generative UI ist die breite Idee. A2UI ist ein spezifischer offener Ansatz, der deklarative Daten gegenüber ausführbarem Code, Portabilität über Clients hinweg und sicherere Zusammenarbeit zwischen Organisationen betont.

8. Hören Sie auf, über Ihre Daten zu lesen – beginnen Sie, sie zu erkunden

Die beste KI-Datenanalyse ist ein Erlebnis, nicht nur ein Gespräch

Googles A2UI formalisiert etwas, das Praktiker bereits spürten: Erkenntnisse wollen Oberflächen – Filter, Hover, Vergleiche – nicht nur Absätze.

Die Chat-Ära hat bewiesen, dass Modelle Daten verstehen können. Text ist immer noch die falsche Standard-Oberfläche für tiefgehende Erkundung: Sie können einen Absatz nicht filtern, in einen Aufzählungspunkt bohren oder über einen Satz für die Herkunft fahren.

A2UI bietet eine Transportgeschichte. Generative UI bietet eine Produktphilosophie. Multi-Agenten-Systeme tragen das Denken, das entscheidet, was visualisiert werden soll. Zusammen skizzieren sie die nächste Ära: Analyse, die standardmäßig interaktiv, visuell und erkundbar ist.

Ob Sie A2UI direkt übernehmen, Plattformen nutzen, die die Philosophie teilen, oder Ihre eigene bauen – die Richtung ist klar. Die Zukunft der KI-gestützten Analyse ist nicht nur ein Chat-Thread. Es ist ein Erlebnis, das Sie navigieren können.

Probieren Sie ChartGen AI mit Ihrer eigenen Datei aus: Beschreiben Sie die Frage, überprüfen Sie die Zahlen anhand Ihrer Zeilen und erkunden Sie die Leinwand, anstatt dieselbe Zusammenfassung in Nachrichtenform erneut zu lesen.