Réponse rapide : A2UI (Agent-to-UI) est un protocole open source créé par Google qui permet aux agents IA de générer des interfaces utilisateur riches et interactives — formulaires, graphiques, cartes, tableaux de bord — au lieu de réponses textuelles simples. Publié en décembre 2025 (aperçu public v0.8), A2UI permet aux agents d'envoyer des descriptions de composants JSON déclaratifs que les applications clientes rendent sous forme de widgets interactifs natifs. Pour les équipes de données, cela signifie que l'IA peut produire des tableaux de bord explorables au lieu de résumés à puces, modifiant ainsi notre interaction avec l'IA pour l'analyse et la visualisation des données.

1. Votre agent IA a parlé alors qu'il aurait dû montrer

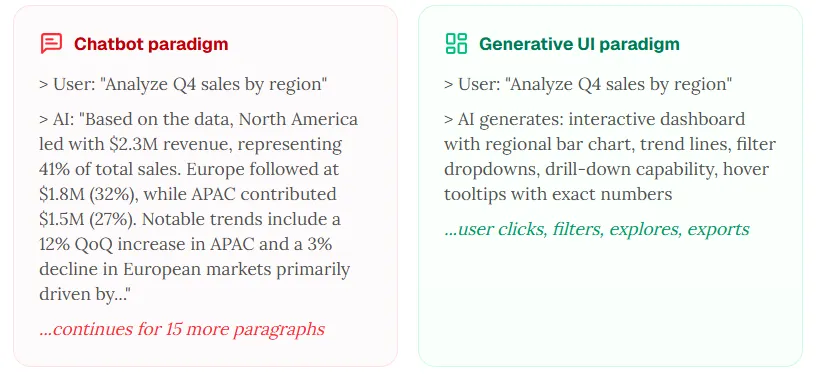

Le paradigme du chatbot n'a jamais été conçu pour les données

Demandez à un assistant généraliste d'analyser les données de ventes trimestrielles. Qu'obtenez-vous ? Un mur de texte. Des puces. Peut-être un bloc de code que vous devez copier dans un notebook pour voir réellement le graphique. Le modèle peut comprendre vos données — mais il répond souvent dans le format le plus primitif : des paragraphes.

Depuis 2022, nous interagissons avec des modèles remarquablement performants via une fenêtre de chat linéaire et textuelle — la même forme de base que l'IRC classique. Le système peut raisonner sur des ensembles de données complexes, signaler des anomalies et proposer des recommandations — pourtant l'interface est une liste défilante de messages que vous lisez de haut en bas puis oubliez.

En décembre 2025, Google a open-sourcé A2UI (Agent-to-UI) — un protocole qui permet aux agents de générer des interfaces utilisateur riches et interactives au lieu de texte brut. Formulaires, sélecteurs de date, graphiques, cartes, tableaux de bord — rendus nativement dans votre application, générés à la volée par l'agent.

La démo réelle est convaincante : Google a montré un agent de recherche de restaurant générant un formulaire de réservation avec un sélecteur de date, un sélecteur d'heure et un bouton de soumission — au lieu du fastidieux échange de messages textuels aller-retour que de nombreux chatbots nécessitent pour une simple réservation. Pour les équipes de données, l'implication est plus nette : l'agent peut générer un tableau de bord explorable au lieu d'une description des données.

2. Qu'est-ce qu'A2UI ? Un explicateur en langage simple

Le protocole qui permet aux agents de construire des interfaces au lieu d'écrire des paragraphes

A2UI (Agent-to-UI) est un protocole open source qui permet aux agents d'envoyer des descriptions d'UI déclaratives — des messages JSON décrivant des boutons, formulaires, graphiques, cartes et mises en page — à un client, qui les rend sous forme de composants interactifs natifs. Considérez-le comme « HTML pour agents », avec des valeurs par défaut plus fortes en matière de sécurité et de portabilité.

Le problème qu'A2UI résout : les limites de confiance

Nous sommes à l'ère des systèmes multi-agents. Des agents sur différents serveurs et de différents fournisseurs coordonnent. Ils ne peuvent pas toucher directement votre UI.

Le schéma ancien ? Envoyer du HTML brut ou du JavaScript dans des iframes — lourd, visuellement incohérent et un casse-tête de sécurité. L'approche d'A2UI : transmettre une UI qui se comporte comme des données mais se lit comme du design. L'agent envoie un plan JSON ; le client le rend avec ses propres widgets natifs.

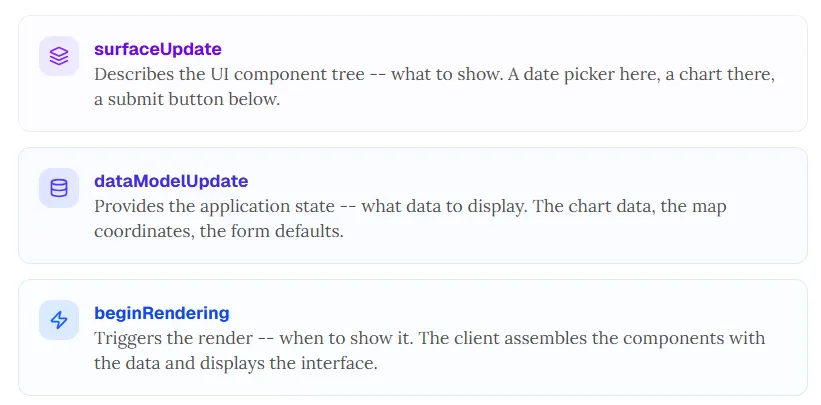

Comment cela fonctionne : le modèle à trois messages

surfaceUpdate

Décrit l'arbre des composants UI — quoi afficher. Un sélecteur de date ici, un graphique là, un bouton de soumission en dessous.

dataModelUpdate

Fournit l'état de l'application — quelles données afficher. Les séries du graphique, les coordonnées de la carte, les valeurs par défaut du formulaire.

beginRendering

Déclenche le rendu — quand l'afficher. Le client assemble les composants avec les données et affiche l'interface.

Pour l'exemple de réservation de restaurant : l'agent envoie du JSON décrivant un sélecteur de date, un sélecteur d'heure, une liste déroulante pour le nombre de convives et un bouton de soumission. Le client rend chaque élément avec son propre framework UI (React, Angular, Flutter, Lit), applique son propre style et ses normes d'accessibilité, et présente un formulaire cohérent. Pas d'iframe. Pas d'exécution de code externe.

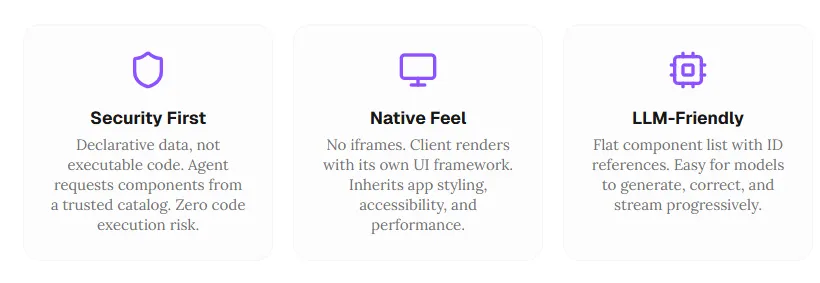

Trois principes de conception fondamentaux

Sécurité d'abord

Données déclaratives, pas de code exécutable. L'agent demande des composants à partir d'un catalogue de confiance — réduisant le risque d'exécution de code arbitraire par rapport à l'envoi de scripts opaques.

Sensation native

Pas d'iframes. Le client rend avec son propre framework UI afin que l'UI générée puisse hériter du style de l'application, de l'accessibilité et des caractéristiques de performance.

Structure adaptée aux LLM

Une liste plate de composants avec des références d'ID est plus facile à générer, corriger et diffuser progressivement pour les modèles qu'une soupe ad hoc de balisage.

L'écosystème (aperçu public v0.8)

A2UI est en aperçu public v0.8, publié sous licence Apache 2.0. Des moteurs de rendu stables existent pour Lit, Angular et Flutter (via le SDK GenUI de Google). Le support React était prévu pour le T1 2026, avec SwiftUI et Jetpack Compose prévus pour le T2. Le protocole prend en charge plusieurs transports, notamment le protocole A2A, AG UI, SSE et WebSockets.

Les partenaires de l'écosystème au jour zéro incluent CopilotKit/AG UI (couche de compatibilité), Opal (mini-apps IA), Gemini Enterprise et le SDK GenUI de Flutter. C'est le pari de Google sur un standard ouvert pour les interfaces pilotées par des agents — et les implications pour la visualisation de données sont importantes.

3. Pourquoi les chatbots échouent dans l'analyse de données : les cinq murs

Une fenêtre de chat est la mauvaise interface pour explorer des données

Le chat fonctionne pour les questions-réponses, l'écriture et la génération de code. Il échoue lamentablement pour une analyse qui devrait être spatiale, interactive et visuelle. Voici cinq murs — et comment une approche d'UI générative répond à chacun.

Mur 1 : le mur de texte

Demandez à un chatbot d'analyser dix mille lignes de données de ventes. Vous pourriez obtenir de nombreux paragraphes de puces. Le traitement visuel humain est considérablement plus rapide que la lecture de texte dense pour les tâches de reconnaissance de motifs. Un graphique bien conçu peut communiquer en moins d'une seconde ce qui prend des minutes à analyser en prose.

Ce dont vous avez besoin à la place : un graphique interactif avec détails au survol, exploration descendante et filtres de date.

Mur 2 : le mur de la linéarité

Le chat est séquentiel — chaque message se bat pour attirer l'attention. Vous ne pouvez pas voir simultanément la tendance des ventes, la segmentation des clients et l'analyse des marges en un coup d'œil. L'analyse est spatiale, pas seulement temporelle.

Ce dont vous avez besoin à la place : un tableau de bord multi-panneaux où les vues côte à côte se mettent à jour réactivement.

Mur 3 : le mur de l'interaction

Vous voulez seulement le T3 ? Vous tapez « filtrer sur T3 ». L'agent peut régénérer toute l'analyse. Vous voulez zoomer sur juin ? Un autre message. Comparer avec l'année dernière ? Un autre message. Les interactions qui devraient être un clic deviennent une phrase, un appel, une réécriture complète.

Ce dont vous avez besoin à la place : des listes déroulantes natives, des sélecteurs de plage et des interrupteurs qui répondent immédiatement.

Mur 4 : le mur de l'exploration

L'analyse est non linéaire : suivre une anomalie, pivoter, revenir en arrière, essayer un autre angle. Les fils de discussion sont permanents et séquentiels — vous ne pouvez pas « annuler » une exploration comme vous le feriez avec les contrôles avec état d'un tableau de bord.

Ce dont vous avez besoin à la place : un état interactif avec annulation, rétablissement et exploration ramifiée.

Mur 5 : le mur de la présentation

Vous avez trouvé l'insight — mais l'artefact est un long fil de discussion. C'est difficile à exporter en tant que tableau de bord ou histoire prête pour une diapositive.

Ce dont vous avez besoin à la place : des tableaux de bord exportables, des graphiques téléchargeables et une génération de diapositives en un clic là où le produit le supporte.

En résumé : le chat optimise pour la conversation, pas pour l'exploration. A2UI est une voie vers des interfaces qui correspondent à la façon dont les analystes travaillent réellement.

4. A2UI pour la visualisation de données : l'exemple RizzCharts

Google a déjà montré une surface d'analyse construite par un agent

L'agent émet des descriptions de composants déclaratifs. Le client les rend sous forme de widgets interactifs natifs.

Qu'est-ce que RizzCharts ?

RizzCharts est l'exemple officiel d'A2UI de Google — un tableau de bord e-commerce alimenté par l'IA qui illustre le paradigme de l'UI générative pour la visualisation. Le modèle d'interaction diffère des outils basés sur le chat :

- Utilisateur : « montre la répartition des ventes par catégorie » → l'agent génère un graphique en anneau interactif avec exploration descendante, rendu nativement.

- Utilisateur : « y avait-il des magasins aberrants ? » → l'agent génère une carte avec des points surlignés et des infobulles.

- L'utilisateur clique sur un segment → le tableau de bord explore les sous-catégories sans un nouveau tour de chat.

Pas d'exécution de code dans le client à partir du bundle de l'agent, pas d'iframe — JSON déclaratif rendu en composants natifs. L'agent (Gemini plus ADK Google dans l'exemple) récupère les données via des outils comme get_sales_data et get_store_sales, puis construit les charges utiles A2UI en utilisant le flux surfaceUpdate → dataModelUpdate → beginRendering.

Pourquoi c'est important

L'agent ne se contente pas d'analyser les données textuellement — il crée une interface que l'utilisateur peut explorer. Séparer la structure de l'état signifie que les graphiques peuvent se mettre à jour réactivement lorsque de nouvelles données arrivent. Le même JSON peut cibler des surfaces web, mobiles et de bureau. Des catalogues personnalisés peuvent étendre A2UI avec des composants spécifiques à un domaine : graphiques financiers, chronologies médicales, diagrammes techniques, couches géospatiales.

La limitation

A2UI est un protocole, pas un produit. Il définit comment les agents communiquent l'UI — pas le nettoyage, les statistiques, la sélection du type de graphique et le raisonnement de conception qui doivent avoir lieu avant que l'UI n'existe. Un workflow de visualisation complet a encore besoin d'une couche d'intelligence qui décide quoi montrer et pourquoi.

5. Du protocole au produit : à quoi ressemble une plateforme de données à UI générative

A2UI définit le transport ; l'intelligence est là où la valeur se concentre

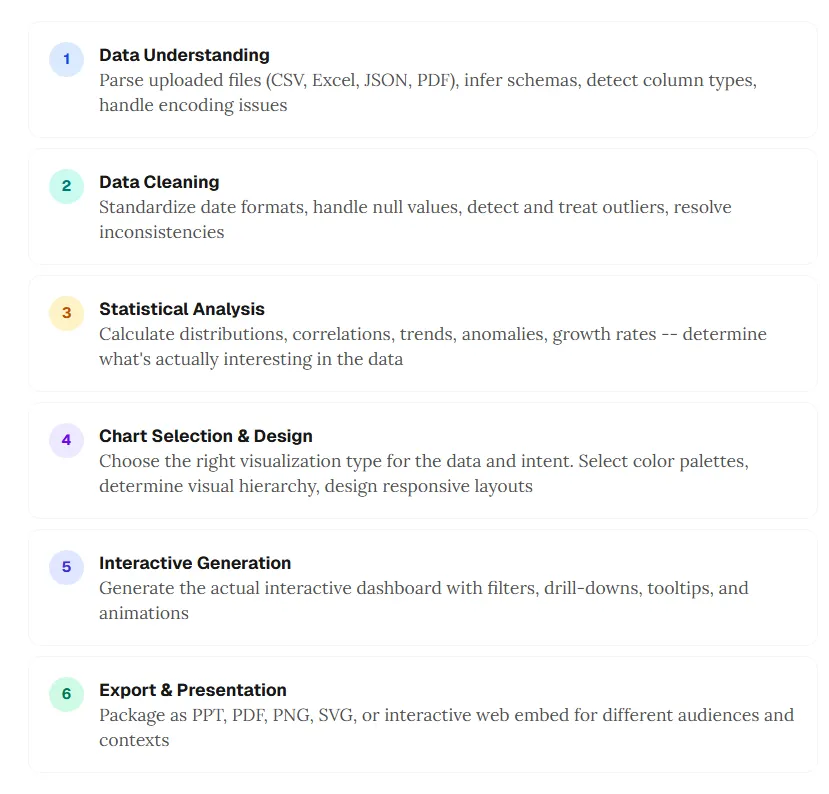

A2UI cible le dernier kilomètre : amener l'UI interactive de l'agent à l'écran. Le pipeline complet a encore besoin de profondeur au-delà du transport :

- Compréhension des données — analyser CSV, Excel, JSON, PDF ; inférer les schémas ; détecter les types de colonnes ; gérer les cas limites d'encodage.

- Nettoyage des données — standardiser les dates ; gérer les valeurs nulles ; traiter les valeurs aberrantes ; résoudre les incohérences.

- Analyse statistique — distributions, corrélations, tendances, anomalies, croissance — décider ce qui est intéressant.

- Sélection et conception du graphique — faire correspondre le type de graphique à l'intention ; palettes ; hiérarchie visuelle ; mise en page réactive.

- Génération interactive — filtres, explorations descendantes, infobulles, mouvement là où il aide à la compréhension.

- Exportation et présentation — PPT, PDF, PNG, SVG ou intégrations pour différents publics.

A2UI aide à la façon dont l'étape 5 atteint le client. Les étapes 1–4 et 6 nécessitent encore une intelligence de domaine qu'aucun protocole ne remplace. Cet écart est la différence entre un standard et un produit.

Comment ChartGen AI implémente cette philosophie

Chez ChartGen AI, nous construisons sur la même philosophie d'UI générative — non pas parce que nous expédions le format filaire A2UI spécifiquement, mais parce que nous partageons la conviction : les agents devraient produire des espaces de travail visuels interactifs, pas des paragraphes sur des graphiques.

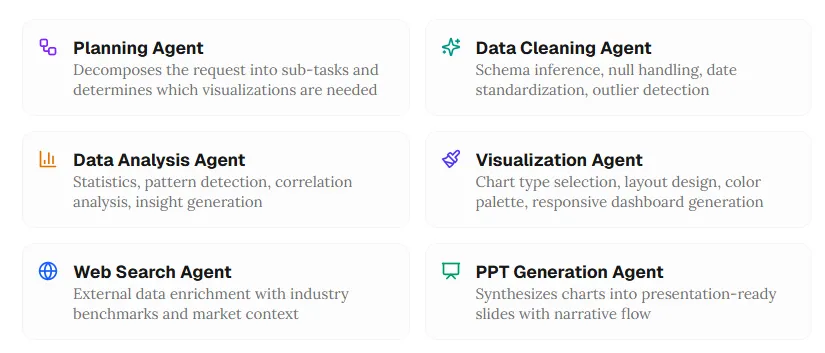

Téléchargez des données dans des formats courants et décrivez ce que vous voulez en langage naturel. Le système vise un tableau de bord explorable — pas une réponse uniquement textuelle. Six agents spécialisés couvrent le pipeline :

Agent de planification

Décompose la demande en sous-tâches et décide quelles visualisations sont nécessaires.

Agent de nettoyage des données

Inférence de schéma, gestion des valeurs nulles, standardisation des dates, détection des valeurs aberrantes.

Agent d'analyse des données

Statistiques, détection de motifs, analyse de corrélation, génération d'insights.

Agent de visualisation

Sélection du type de graphique, mise en page, palette, composition réactive du tableau de bord.

Agent de recherche web

Enrichissement externe avec des benchmarks et du contexte de marché lorsque pertinent.

Agent de génération PPT

Transforme les graphiques et les insights en diapositives prêtes pour la présentation avec un flux narratif.

Le résultat est destiné à être un canevas sur lequel vous pouvez cliquer, filtrer, explorer et exporter — l'UI générative appliquée aux workflows de visualisation de données.

La philosophie partagée : l'UI générée par un agent bat le texte généré par un agent pour les données

Que le transport soit le JSON déclaratif d'A2UI ou une pile de visualisation multi-agents, l'insight est le même :

Pour l'analyse, le bon artefact est souvent une interface, pas un paragraphe.

- L'agent propose l'UI : types de graphiques, mises en page et interactions adaptées à l'ensemble de données — les utilisateurs ne devraient pas avoir à micro-gérer « fais un diagramme à barres ».

- Interactif par défaut : survol, exploration, filtre — pas une capture d'écran statique enterrée dans le chat.

- Qualité native : la surface devrait ressembler à un tableau de bord conçu pour les décisions, pas à un message avec une pièce jointe.

6. L'avenir : ce que les interfaces pilotées par des agents signifient pour les équipes de données

Trois prédictions pour 2026–2027

Les outils basés sur le chat ajouteront des couches d'UI générative. De nombreux produits d'analyse se contentent encore de texte et d'images statiques. D'ici fin 2027, beaucoup d'entre eux livreront des tableaux de bord interactifs en tant que résultats de première classe — et les standards ouverts comme A2UI réduisent le verrouillage sur la façon dont cela se produit.

Le travail de l'analyste passe de la construction à la curation. Lorsque l'agent compose le tableau de bord, l'humain dirige avec des questions, valide les insights et façonne le récit — un jugement éditorial plus qu'un assemblage manuel de graphiques.

Les catalogues spécifiques à un domaine deviennent un fossé. Le protocole est ouvert ; l'avantage concurrentiel se concentre dans les bibliothèques de composants de confiance et l'intelligence de domaine — cartes de chaleur de risque, vues de cohorte, cartes de revenus géographiques, et autres primitives spécialisées sur lesquelles les équipes comptent.

Ce que vous pouvez faire maintenant

- Développeurs : expérimentez avec A2UI (v0.8), ADK et Gemini pour construire des surfaces pilotées par des agents avec du JSON déclaratif dès aujourd'hui.

- Analystes : utilisez des outils comme ChartGen AI qui traitent déjà les tableaux de bord comme le résultat principal.

- Responsables produit : évaluez où les workflows internes devraient passer de requêtes basées sur le chat à une exploration basée sur l'UI — le retour sur investissement se voit dans la vitesse d'exploration et la qualité des décisions.

7. Foire aux questions

Qu'est-ce qu'A2UI ?

A2UI (Agent-to-UI) est un protocole open source de Google qui permet aux agents d'envoyer du JSON déclaratif décrivant des composants UI — formulaires, graphiques, cartes, tableaux de bord — que les clients rendent avec des widgets natifs. Aperçu public autour de la v0.8 (fin 2025) sous Apache 2.0.

Qu'est-ce que l'UI générative ?

L'UI générative signifie que les modèles créent des mises en page et des éléments interactifs dynamiquement à partir de requêtes, plutôt que de seulement remplir des modèles fixes. A2UI est un protocole visant les contextes multi-agents et inter-domaines de confiance.

Pourquoi les chatbots sont-ils faibles pour l'analyse de données ?

Ils sérialisent l'analyse en texte linéaire. L'exploration bénéficie d'une mise en page spatiale, d'une manipulation directe et de visuels. Les frictions courantes incluent le mur de texte, la linéarité, les boucles d'interaction lentes, l'état d'exploration limité et les artefacts de présentation faibles.

Comment les agents produisent-ils des tableaux de bord interactifs ?

Des protocoles tels qu'A2UI transportent des descriptions déclaratives de composants et de données liées. Le client rend les contrôles natifs. La qualité de production dépend toujours du nettoyage en amont, de l'analyse et de l'intelligence de conception — pas seulement du transport.

Quelle est la différence entre A2UI et l'UI générative ?

L'UI générative est l'idée générale. A2UI est une approche ouverte spécifique mettant l'accent sur les données déclaratives plutôt que sur le code exécutable, la portabilité entre clients et une collaboration plus sûre entre organisations.

8. Arrêtez de lire sur vos données — commencez à les explorer

La meilleure analyse de données IA est une expérience, pas seulement une conversation

L'A2UI de Google formalise ce que les praticiens ressentaient déjà : les insights veulent des interfaces — filtres, survols, comparaisons — pas seulement des paragraphes.

L'ère du chat a prouvé que les modèles peuvent comprendre les données. Le texte reste la surface par défaut erronée pour une exploration approfondie : vous ne pouvez pas filtrer un paragraphe, explorer une puce ou survoler une phrase pour obtenir la lignée.

A2UI offre une histoire de transport. L'UI générative offre une philosophie de produit. Les systèmes multi-agents portent le raisonnement qui décide quoi visualiser. Ensemble, ils esquissent la prochaine ère : une analyse interactive, visuelle et explorable par défaut.

Que vous adoptiez directement A2UI, utilisiez des plateformes qui partagent la philosophie, ou construisiez la vôtre — la direction est claire. L'avenir de l'analyse assistée par IA n'est pas seulement un fil de discussion. C'est une expérience que vous pouvez naviguer.

Essayez ChartGen AI sur votre propre fichier : décrivez la question, vérifiez les chiffres par rapport à vos lignes, et explorez le canevas au lieu de relire le même résumé sous forme de message.