Die Ausgabemodalität verschiebt sich: von Text, den Sie lesen, zu Bildern, die Sie erleben.

*Abbildungen und Layout entsprechen dem Originalessay auf Medium.*

Der Moment, als ich wusste, dass sich alles geändert hat

Ich sah zu, wie eine KI ein Kinovideo mit synchronisiertem Dialog erstellte. Da wurde mir klar: Textbasierte KI war bereits gestern.

Diese Woche veröffentlichte ByteDance Seedance 2.0: Kinovideos in 1080p, nativ synchronisierte Audio- und mehrsprachige Lippen synchronisation, Multi-Shot-Storytelling mit konsistenten Charakteren über Szenen hinweg, bis zu neun Bildeingaben und drei Video- und drei Audioeingaben gleichzeitig sowie 15-Sekunden-Clips, die produktionsreif aussehen können.

Letzte Woche startete Claude Opus 4.6 mit einem Kontextfenster von einer Million Token und starkem agentischem Coden. Es schrieb nicht nur Code – es lieferte produktionsreife UIs aus einer kurzen Eingabeaufforderung. GitHub Copilot integrierte es schnell. Entwickler begannen, Full-Stack-Apps in Minuten auszuliefern.

Inzwischen fühlen sich GPT-5 und Claude 4 Sonnet bei reinen Textaufgaben für viele Benutzer austauschbar an.

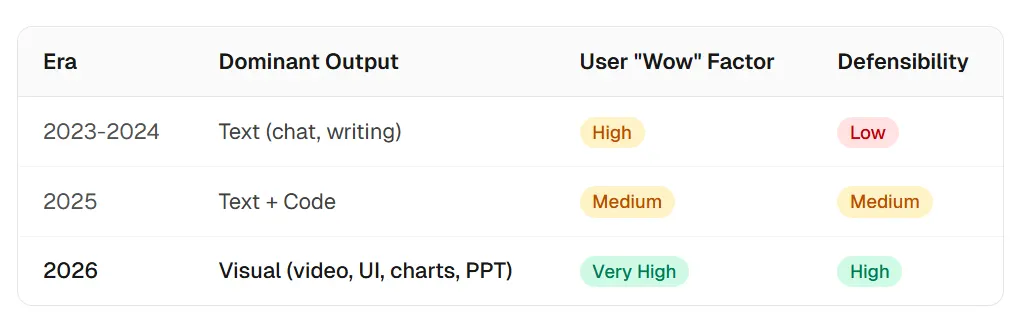

2026 ist nicht das Jahr, in dem KI marginal besser im Schreiben von Text wird. Es ist das Jahr, in dem KI dramatisch besser darin wird, Ihnen Dinge zu zeigen: Videos, UIs, Diagramme, Dashboards, Präsentationen. Die Ausgabemodalität wechselt von Text zu Bildern – und das verändert, welche Produkte gewinnen.

Das Textplateau: Warum „besserer Text“ nicht mehr den Ausschlag gibt

GPT-5 vs. Claude 4: Die Unterschiede sind real. Die Wahrnehmungslücke im Alltag? Oft nahe Null.

Frontmodelle im Jahr 2026 sind objektiv stärker als ihre Vorgänger von 2025. GPT-5 führte adaptives Denken ein – Wechsel zwischen schnellen und tiefen Modi. Claude Opus 4.6 lieferte ein 1M-Token-Kontextfenster und starke Benchmark-Ergebnisse. Denken, faktische Genauigkeit und Geschwindigkeit haben sich verbessert.

Aber bei der Textausgabe konvergiert die Wahrnehmungslücke der Benutzer gegen Null.

DataStudios (2026) drückte es klar aus: Beide sind Schwergewichte; die Philosophie unterscheidet sich, aber die Unterscheidung von Ausgaben ist weniger wichtig. Menschen berichten von „KI-Chatbot-Müdigkeit“ – große Assistenten können sich gleich anhören.

Die Forschung zur LLM-Skalierung untermauert die Obergrenze. Ein OpenReview-PDF stellt fest, dass bei wissensintensiven Aufgaben mehr Rechenzeit die Genauigkeit nicht zuverlässig verbessert – und Halluzinationen verstärken kann. Der Ertrag der Textverbesserung nimmt ab.

Das „Wow“ hat sich verlagert. Nur wenige staunen über eine ausgefeilte E-Mail. Ein 15-Sekunden-Kinoclip aus einer Aufforderung, eine produktionsreife UI in einer halben Minute oder ein zehnfolien Daten-Deck aus einem Excel-Upload bringen den Raum noch zum Stillstand.

Die nächste Welle herausragender KI-Unternehmen wird nicht nur danach definiert, wer die besten Absätze schreibt. Sie wird danach definiert, wer die besten Bilder erzeugt.

Die visuelle Explosion: Vier Kategorien, die die KI-Ausgabe neu definieren

Text-zu-Video. Text-zu-UI. Text-zu-Diagramm. Text-zu-Präsentation. Die Erlebnisebene wird neu aufgebaut.

Kategorie 1: KI-Videogenerierung

Seedance 2.0 ist kein kleiner Schritt. Es definiert die Kategorie neu: 1080p, parallel zum Video generiertes Audio, Multi-Shot-Erzählungen mit konsistenten Charakteren, mehrsprachige Lippen synchronisation und umfangreiche multimodale Eingaben – eher eine Pipeline als ein Spielzeug. Siehe auch diesen WaveSpeed.ai-Vergleich von Seedance 2.0 vs. Kling 3.0, Sora 2 und Veo 3.1.

Das Feld ist überfüllt: Sora 2 (physikfokussiert, ~12s), Veo 3.1 (kinematografisch, ~8s), Kling 3.0 (stark in China). Seedance 2.0s multimodale Eingabearchitektur setzt eine neue Messlatte. Berichterstattung über die Marktreaktion: Silicon Republic zu chinesischen Technologieaktien.

Kontext der Marktgröße: MarketsandMarkets zur KI-Bild- und Videogenerierung (Prognose bis 2030, CAGR im hohen dreißiger Bereich).

Kategorie 2: KI-zu-UI-Generierung

v0 von Vercel verwandelt Sprache in produktionsreifes React und Tailwind. Bolt, Lovable und Forge pushen Full-Stack-Apps aus Eingabeaufforderungen. a16z zur „Prompt-to-Product“-Ära erfasst, warum der Idee-zu-Auslieferungs-Kreislauf kollabierte.

Claude Opus 4.6 verstärkt dies: Ein 1M-Token-Kontext erlaubt einem Assistenten, ganze Codebasen zu halten, während er UIs mit Architekturbewusstsein generiert. Die Entwicklungsgeschwindigkeit ändert sich, wenn das Modell das gesamte Projekt sieht.

Kategorie 3: KI-Datenvisualisierung

Traditionelle BI-Stacks erfordern manuelle Konfiguration, Abfragesprachen und gestalterisches Können. KI-native Visualisierungswerkzeuge verkürzen den Pfad: Daten hochladen, die Ansicht beschreiben, Diagramme und Dashboards schnell erhalten.

Das entscheidende Unterscheidungsmerkmal ist Rückverfolgbarkeit. Text-Halluzinationen verstecken sich leicht; ein falsches Diagramm ist offensichtlich. Das erzwingt höhere technische Hürden und einen natürlichen Qualitätsgraben. Geschwindigkeit allein reicht nicht – die Zahlen müssen stimmen.

Kategorie 4: KI-Präsentationsgenerierung

Der KI-Präsentationsmarkt lag 2025 bei etwa 1,5 Mrd. USD, mit Prognosen von etwa 4,0 Mrd. USD bis 2033 bei einer CAGR von etwa 14 %. Gamma skalierte Benutzer schnell; Tome verließ die Kategorie. Der Markt teilt sich in geschwindigkeitsorientierte und tiefgangsorientierte Werkzeuge.

Die Grenze bilden Multi-Agent-Pipelines, die recherchieren, analysieren, gestalten und verifizieren – nicht ein einzelner LLM-Durchlauf, der Aufzählungspunkte dekoriert. Decks sind das universelle Geschäftsformat; sie KI-nativ zu machen, ist eine massive Befreiung.

In allen vier Kategorien bewegt sich die Ausgabe von „Text, den Sie lesen“ zu „Bildern, die Sie erleben“. Die Branche verbrachte 2023–2025 damit, den Textkanal zu schärfen. 2026 baut sie den visuellen Kanal auf – wo oft die Verteidigungsfähigkeit liegt.

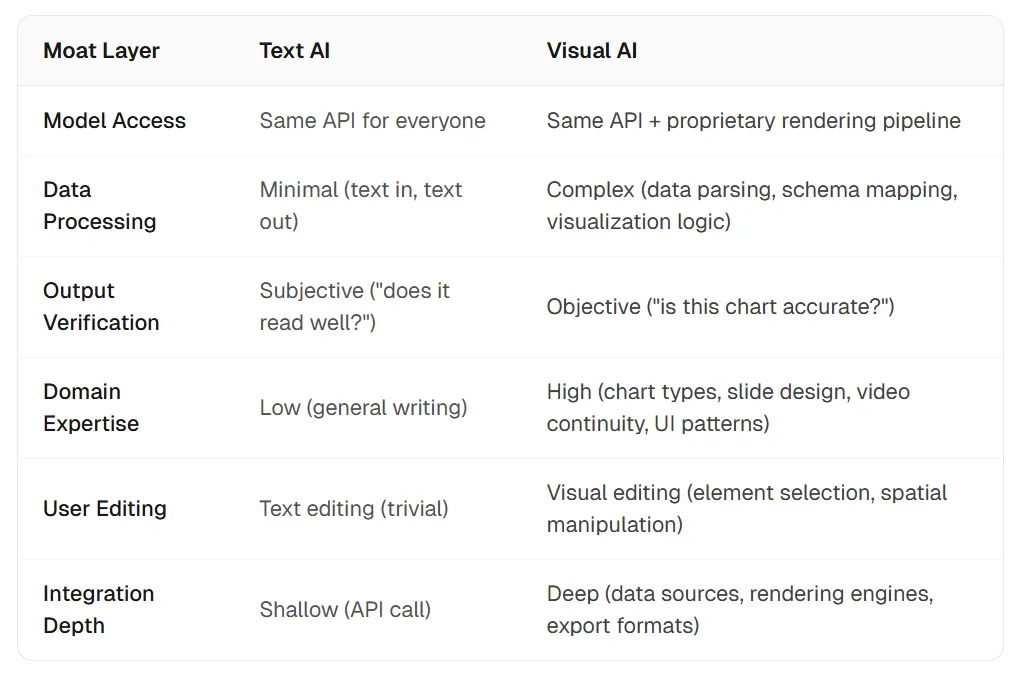

Warum visuelle KI schwieriger (und verteidigungsfähiger) ist als Text-KI

Jeder kann einen LLM einwickeln. Nur wenige Teams können eine echte visuelle Engine ausliefern.

Textprodukte wurden schnell zur Ware: GPT oder Claude aufrufen, Strings formatieren, ausliefern. Tausende Schreibassistenten verschwammen. Dünne Gräben – gleiche Modelle, gleiche APIs, ähnliche Qualität.

Visuelle KI widersetzt sich diesem Muster:

- Rendering-Infrastruktur – Videodecoder, Diagramm-Engines, UI-Systeme, Folienlayout-Engines.

- Domänenwissen – welches Diagramm zu welcher Datenform passt, wie Erzählungen über Folien fließen, wie Komponenten zusammengesetzt werden.

- Mehrstufige Pipelines – Planung, Abruf, Analyse, Rendering und Verifizierung; selten ein einzelner API-Aufruf.

Bis Ende 2026 tendieren die wertvollsten KI-Startups zu visueller Ausgabe. Die API-Wrapper-Ära dünnt aus; die Ära der visuellen Engine beschleunigt sich.

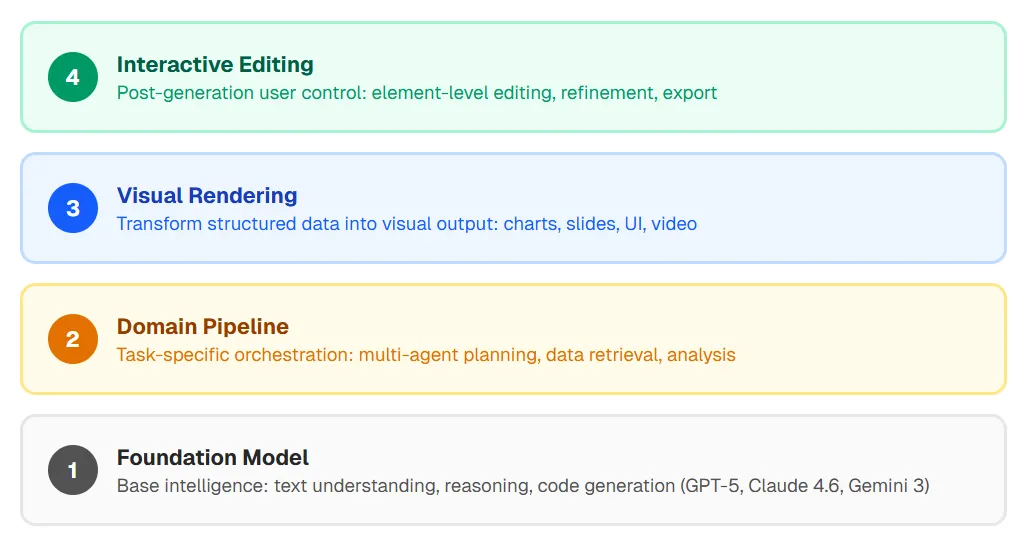

Der visuelle KI-Stack: Was entsteht

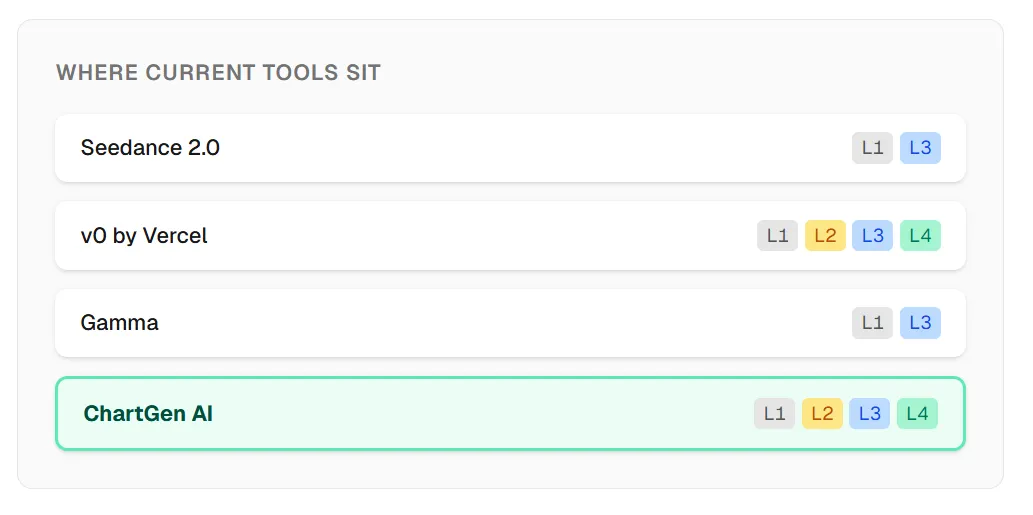

Ein vierschichtiges Muster zeigt sich kategorieübergreifend:

- Foundation Model

- Domänenpipeline (Planung, Werkzeuge, Abruf)

- Visuelles Rendering

- Interaktive Bearbeitung

Schicht 1 allein ist ein Commodity-Wrapper. Schichten 1–2 sind leistungsstark, aber oft unsichtbar. Schichten 1–3 fühlen sich wie ein echtes Produkt an. Schichten 1–4 erlauben Benutzern, in einer Umgebung zu generieren und zu iterieren – die dauerhafte Form.

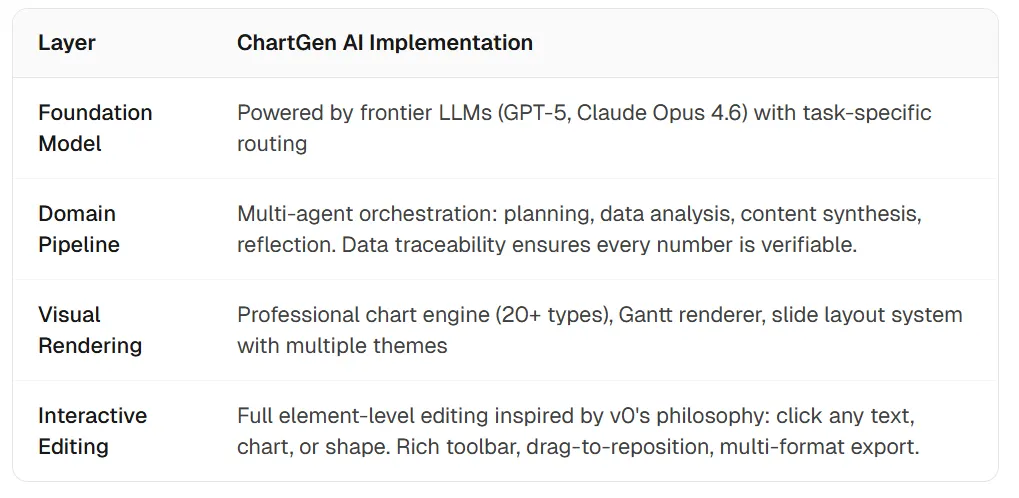

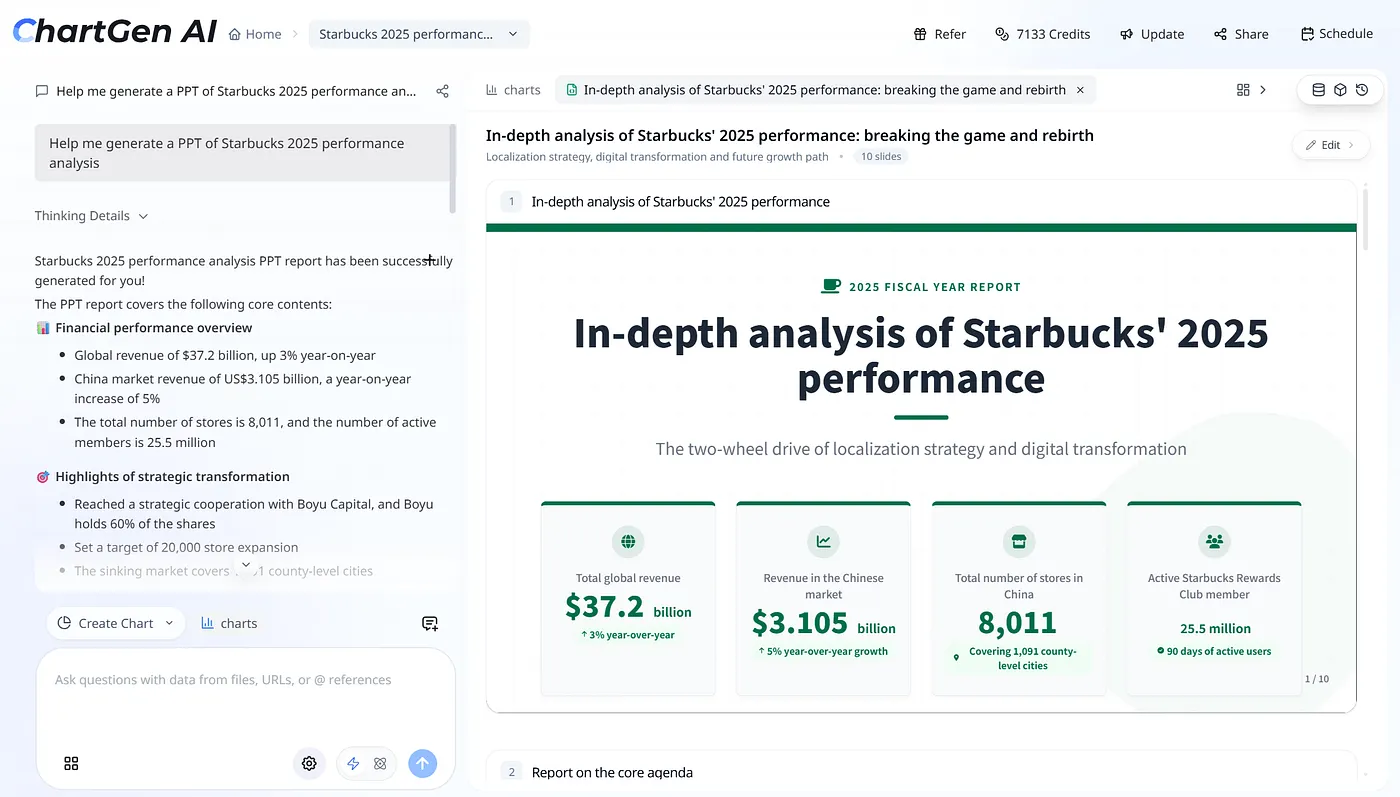

Fallstudie: Wie ChartGen AI den visuellen KI-Wandel verkörpert

Wir haben ChartGen AI nicht gestartet, um einem Trend zu folgen. Wir begannen mit einer engen These: Datenprofis sollten keine Designer sein müssen, um überzeugende Bilder zu erstellen. Als das Produkt wuchs, wurde das breitere Muster offensichtlich – eine Plattform von KI zu visueller Ausgabe.

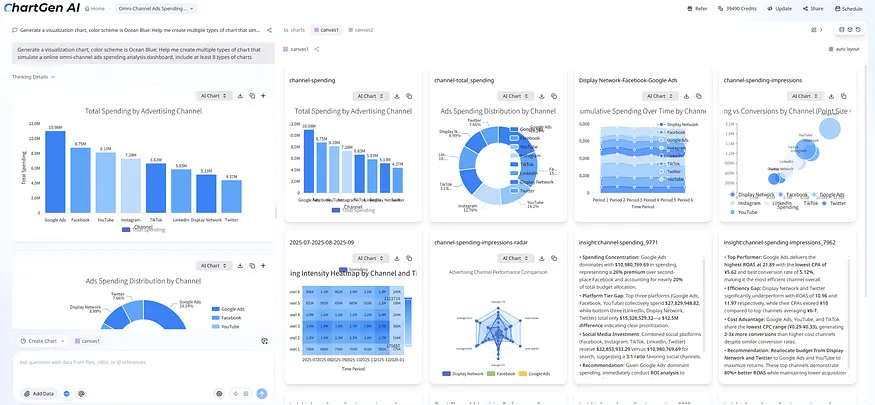

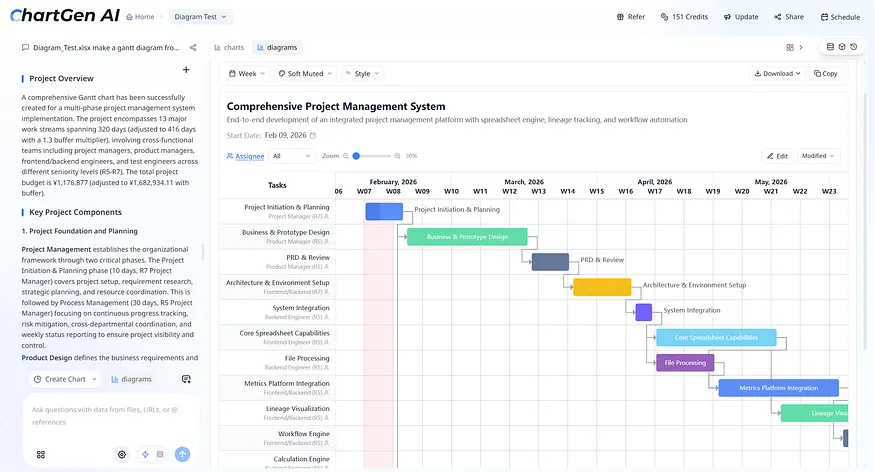

ChartGen AI verhält sich wie ein „KI zu UI“-Agent: natürliche Sprache plus Daten hinein; Diagramme, Dashboards, Gantt-Ansichten und vollständige Präsentationen heraus. Jeder Schritt produziert etwas, das Sie sehen, bearbeiten und teilen können – keine Textwand.

Drei visuelle Ausgabemodi

Modus 1 – Datenvisualisierung. Daten hochladen, in einfacher Sprache fragen, Diagramme und Dashboards auf einer unendlichen Leinwand mit Rückverfolgbarkeit zu den Quellzeilen erhalten.

Modus 2 – Gantt-Diagramme. Ein Projekt beschreiben oder eine Tabelle hochladen; ein interaktives Gantt-Diagramm mit Abhängigkeiten, Verantwortlichen und Fortschritt erhalten, mit Inline-Bearbeitung.

Modus 3 – KI-Präsentationen. Eine Eingabeaufforderung kann eine Multi-Agent-Pipeline antreiben (planen, recherchieren, analysieren, gestalten, reflektieren). Tabellen und Diagramme bleiben mit den Quelldaten verbunden; die Bearbeitung erfolgt auf Elementebene in einem dedizierten Deck-Editor.

Dies ist der visuelle KI-Wandel in der Praxis: Ein Agent, der Ihre Daten zeigt – in Artefakten, denen Sie vertrauen, sie verfeinern und präsentieren können.

Was kommt als Nächstes: Fünf Vorhersagen für die visuelle KI-Welle

- Video und Datenvisualisierung konvergieren – animierte Datengeschichten, videoförmige Quartalsberichte, Dashboards, die wie Präsentationen ablaufen; die Grenze zwischen Diagramm und Bewegung verschwimmt.

- „KI zu UI“ wird zum Standardentwicklungs-Workflow – v0-ähnliche Werkzeuge gehören zum täglichen Werkzeugkasten; Millionen-Token-Kontexte machen die UI-Generierung über das gesamte Repository hinweg normal.

- KI-Präsentationen ersetzen die meisten internen Decks – Ein-Prompt-Artefakte für Updates und Überprüfungen; menschliche Verfeinerung konzentriert sich auf die wichtigsten externen Momente.

- „Visueller KI-Agent“ wird zu einer Kategorie – Analyse-, Produkt- und Marketingwerkzeuge, die standardmäßig visuelle Ergebnisse liefern, nicht Bildlauf zurück.

- Der Modellwettbewerb verlagert sich auf visuelle Qualität – Benchmarks für Diagramme, Folien, UI und Video sind genauso wichtig wie Prosa-Bestenlisten.

Der Wechsel von Text-KI zu visueller KI ist keine Funktionsverbesserung. Es ist ein Plattformwechsel – näher an CLI-zu-GUI oder Desktop-zu-Mobil als an einer Modellaktualisierung. Entwickler, die visuelle Ausgabe priorisieren, gestalten das nächste Jahrzehnt.

Zeigen, nicht erzählen

Seedance 2.0 beschreibt nicht nur eine Szene – es zeigt sie mit synchronisiertem Audio.

Claude Opus 4.6 beschreibt nicht nur eine UI – es kann produktionsreife Oberflächen schnell ausliefern.

v0 stoppt nicht bei einer Spezifikation – es liefert funktionierende UI aus einer Aufforderung.

ChartGen AI hört nicht bei der Beschreibung Ihrer Daten auf – es visualisiert sie in Diagrammen, Dashboards und Decks, die Sie bearbeiten und verteidigen können.

Der rote Faden für die wirkungsvollsten Produkte 2026: weniger Absätze zum Lesen, mehr Artefakte zum Erleben.

2023–2024 staunten wir darüber, was KI sagen konnte. 2026 staunen wir darüber, was sie zeigen kann. Der visuelle Kanal ist breiter und reichhaltiger als Text es je war – und die Unternehmen, die für ihn bauen, werden die zukünftige Landschaft definieren.

Referenzen

Quell-Essay (Abbildungen und ursprüngliches Layout): medium.com — 2026: Das Jahr, in dem KI aufhörte zu reden und anfing zu zeigen

- seedance.io — Seedance 2.0 Produktseite

- wavespeed.ai — Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Claude Opus 4.6 Ankündigung

- datastudios.org — GPT-5 vs Claude 4 Vergleich

- openreview.net — LLM-Skalierung PDF (Wissensaufgaben, abnehmende Erträge)

- marketsandmarkets.com — KI-Bild- und Videogeneratormarkt

- htfmarketinsights.com — KI-Präsentationsgeneratoren Marktbericht

- a16z.com — KI-Web-App-Builder / Prompt-to-Product

- siliconrepublic.com — Seedance 2.0 und chinesische Technologieaktien

- neurocanvas.net — KI-Bildgenerierung 2026 Vorschau

- lordofthewix.com — Fortschritt der KI-Bild/Video 2020–Anfang 2026