A modalidade de saída está mudando: de texto que você lê para visuais que você experiencia.

*Figuras e layout correspondem ao ensaio original no Medium.*

O Momento em que Percebi que Tudo Mudou

Eu assisti uma IA gerar um vídeo cinematográfico com diálogo sincronizado. E então caiu a ficha: a IA baseada em texto já era coisa do passado.

Esta semana, a ByteDance lançou o Seedance 2.0: vídeo cinematográfico em 1080p, áudio nativamente sincronizado com sincronização labial multilíngue, narrativa com múltiplas cenas e consistência de personagens, até nove entradas de imagem e três de vídeo e três de áudio simultaneamente, e clipes de 15 segundos que podem parecer de nível profissional.

Na semana passada, o Claude Opus 4.6 foi lançado com uma janela de contexto de um milhão de tokens e forte capacidade de codificação agente. Não só escrever código — mas enviar UIs prontas para produção a partir de um breve prompt. O GitHub Copilot o integrou rapidamente. Desenvolvedores começaram a criar aplicações full-stack em minutos.

Enquanto isso, em tarefas puramente textuais, GPT-5 versus Claude 4 Sonnet podem parecer intercambiáveis para muitos usuários.

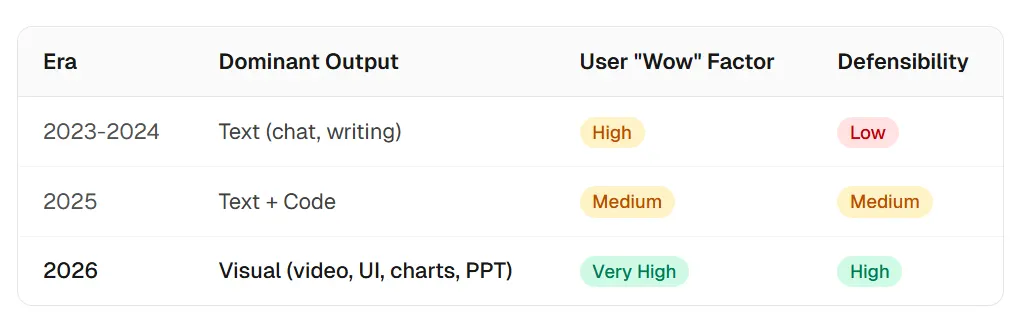

2026 não é o ano em que a IA melhora marginalmente na escrita de texto. É o ano em que a IA melhora drasticamente em mostrar coisas: vídeo, UI, gráficos, painéis, apresentações. A modalidade de saída está se movendo de texto para visuais — e isso muda quais produtos vencem.

O Platô do Texto: Por que “Texto Melhor” Não Faz Mais Diferença

GPT-5 versus Claude 4: as diferenças são reais. A percepção cotidiana? Muitas vezes perto de zero.

Os modelos de fronteira em 2026 são objetivamente mais fortes que seus predecessores de 2025. O GPT-5 introduziu raciocínio adaptativo — alternando entre modos rápido e profundo. Claude Opus 4.6 entregou uma janela de contexto de 1M de tokens e fortes resultados em benchmarks. Raciocínio, precisão factual e velocidade avançaram.

Mas na saída de texto, a lacuna de percepção do usuário está convergindo para zero.

DataStudios (2026) colocou de forma clara: ambos são potências; a filosofia difere, mas discernir as saídas importa menos. As pessoas relatam “fadiga de chatbot” — os principais assistentes podem soar iguais.

A pesquisa sobre escalonamento de LLM reforça o teto. Um PDF do OpenReview observa que para tarefas intensivas em conhecimento, mais tempo de computação não melhora a precisão de forma confiável — e pode aumentar alucinações. Os retornos do polimento de texto estão diminuindo.

O “uau” se moveu. Poucas pessoas se surpreendem com um e-mail polido. Um clipe cinematográfico de 15 segundos a partir de um prompt, uma UI de produção em meio minuto ou um deck de dados de dez slides a partir de um upload do Excel ainda param a sala.

A próxima onda de empresas de IA de destaque não será definida apenas por quem escreve os melhores parágrafos. Será definida por quem gera os melhores visuais.

A Explosão Visual: Quatro Categorias Redefinindo a Saída da IA

Texto-para-vídeo. Texto-para-UI. Texto-para-gráfico. Texto-para-apresentação. A camada de experiência está sendo reconstruída.

Categoria 1: Geração de Vídeo por IA

Seedance 2.0 não é um pequeno passo. Ele reformula a categoria: 1080p, áudio gerado em paralelo com o vídeo, narrativa com múltiplas cenas e personagens consistentes, sincronização labial multilíngue e entradas multimodais pesadas — mais perto de um pipeline do que de um brinquedo. Veja também esta comparação do WaveSpeed.ai do Seedance 2.0 versus Kling 3.0, Sora 2 e Veo 3.1.

O campo está cheio: Sora 2 (foco em física, ~12s), Veo 3.1 (cinematográfico, ~8s), Kling 3.0 (forte na China). A arquitetura de entrada multimodal do Seedance 2.0 estabelece um novo padrão. Cobertura da reação do mercado: Silicon Republic sobre ações de tecnologia chinesas.

Contexto de dimensionamento de mercado: MarketsandMarkets sobre geração de imagem e vídeo por IA (projeção até 2030, CAGR na faixa dos trinta e poucos por cento).

Categoria 2: Geração de UI por IA

v0 da Vercel transforma linguagem em React e Tailwind de nível de produção. Bolt, Lovable e Forge impulsionam aplicações full-stack a partir de prompts. a16z sobre a era “prompt-para-produto” captura por que o ciclo ideia-para-envio colapsou.

Claude Opus 4.6 amplifica isso: um contexto de 1M de tokens permite que um assistente mantenha bases de código inteiras enquanto gera UI com consciência arquitetônica. A velocidade de desenvolvimento muda quando o modelo vê o projeto inteiro.

Categoria 3: Visualização de Dados por IA

Os stacks tradicionais de BI exigem configuração manual, linguagens de consulta e habilidade de design. As ferramentas de visualização nativas de IA comprimem o caminho: faça upload de dados, descreva a visualização, obtenha gráficos e painéis rapidamente.

O grande diferencial é a rastreabilidade. Alucinações de texto se escondem facilmente; um gráfico errado é óbvio. Isso força barras de engenharia mais altas e um fosso de qualidade natural. Velocidade não é suficiente — os números têm que estar certos.

Categoria 4: Geração de Apresentações por IA

O mercado de apresentações por IA era aproximadamente US$ 1,5B em 2025, com projeções para cerca de US$ 4,0B até 2033 a um CAGR de ~14%. Gamma escalou usuários rapidamente; Tome saiu da categoria. O mercado está se dividindo entre ferramentas focadas em velocidade e ferramentas focadas em profundidade.

A fronteira são pipelines multiagentes que pesquisam, analisam, projetam e verificam — não uma única passagem de LLM que decora tópicos. Decks são o formato universal de negócios; torná-los nativos de IA é um grande avanço.

Em todas as quatro categorias, a saída passa de “texto que você lê” para “visuais que você experiencia”. A indústria gastou 2023–2025 aprimorando o canal de texto. Em 2026, está construindo o canal visual — onde a defensabilidade muitas vezes reside.

Por que a IA Visual é Mais Difícil (e Mais Defensável) que a IA de Texto

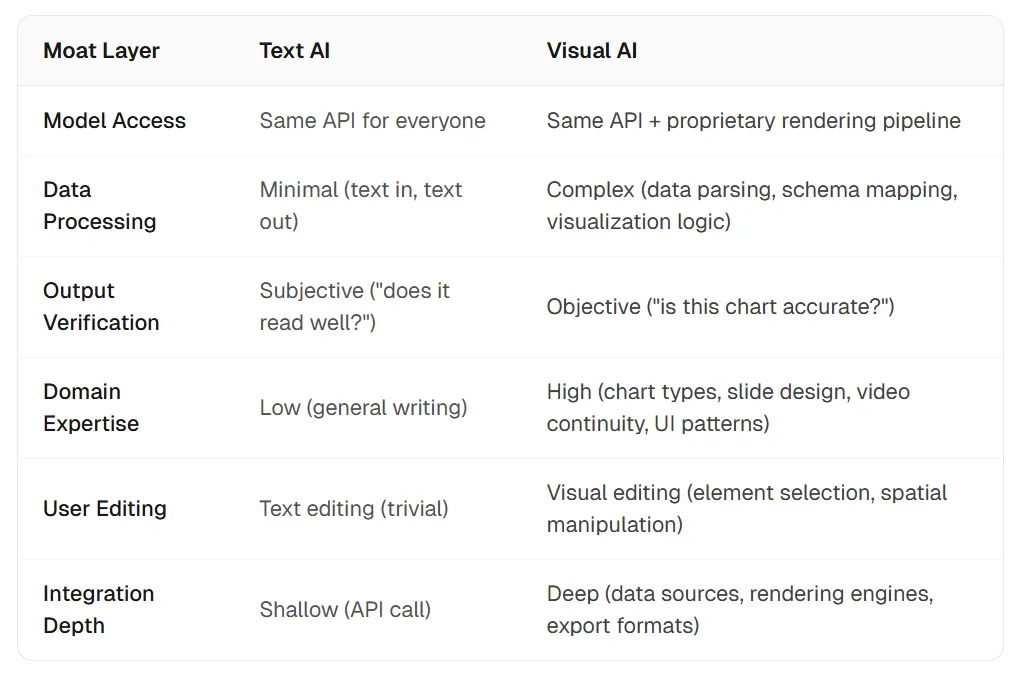

Qualquer um pode empacotar um LLM. Poucas equipes conseguem entregar um motor visual real.

Produtos de texto se commoditizaram rapidamente: chamar GPT ou Claude, formatar strings, publicar. Milhares de assistentes de escrita se misturaram. Fossos finos — mesmos modelos, mesmas APIs, qualidade semelhante.

A IA visual resiste a esse padrão:

- Infraestrutura de renderização — decodificadores de vídeo, motores de gráficos, sistemas de UI, motores de layout de slides.

- Conhecimento de domínio — qual gráfico se adequa a qual forma de dados, como as narrativas fluem pelos slides, como os componentes se compõem.

- Pipelines de várias etapas — planejamento, recuperação, análise, renderização e verificação; raramente uma única chamada de API.

No final de 2026, as startups de IA mais valiosas tendem a ser focadas em saída visual. A era do wrapper de API está diminuindo; a era do motor visual acelera.

O Stack de IA Visual: O que Está Surgindo

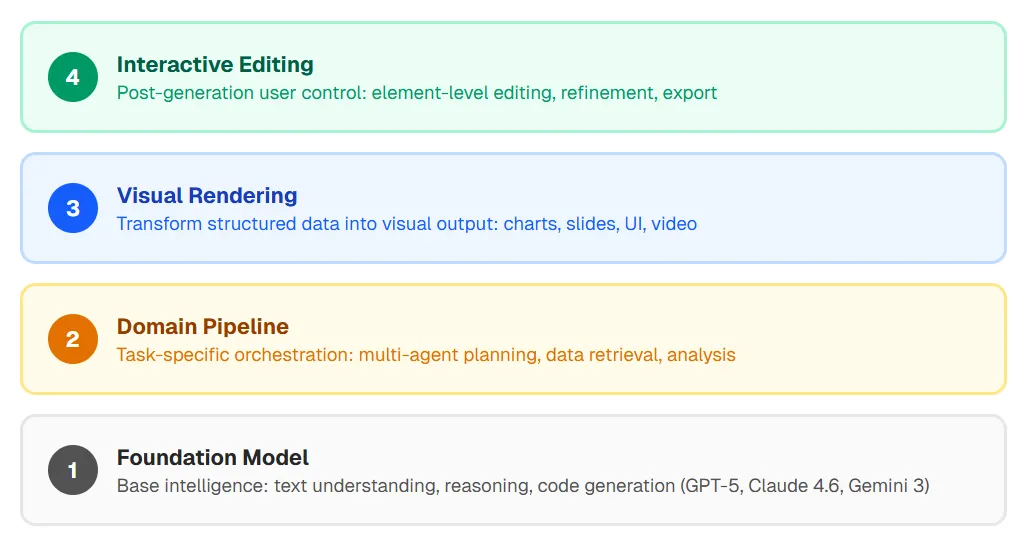

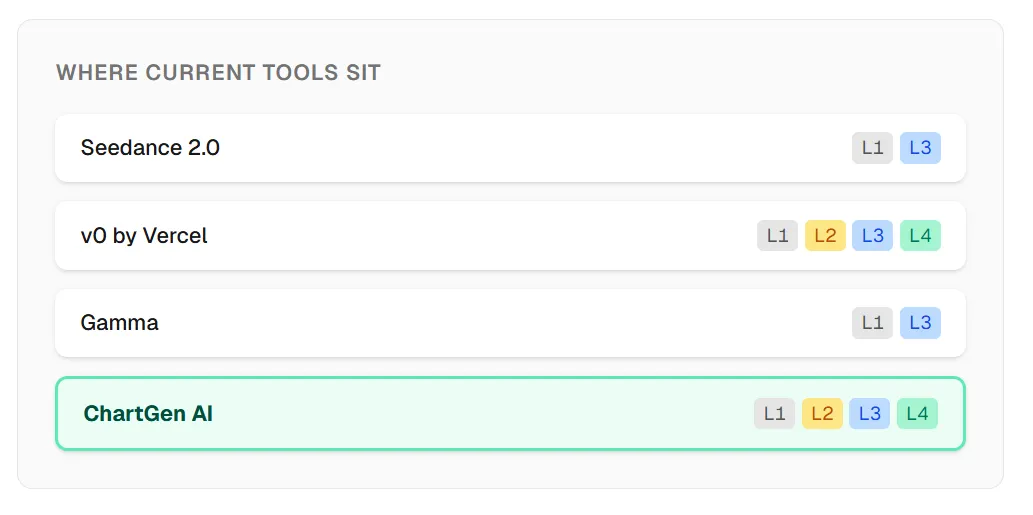

Um padrão de quatro camadas aparece em todas as categorias:

- Modelo fundacional

- Pipeline de domínio (planejamento, ferramentas, recuperação)

- Renderização visual

- Edição interativa

A camada 1 sozinha é um wrapper commodity. Camadas 1–2 são poderosas, mas muitas vezes invisíveis. Camadas 1–3 parecem um produto real. Camadas 1–4 permitem que os usuários gerem e iterem em um único ambiente — a forma durável.

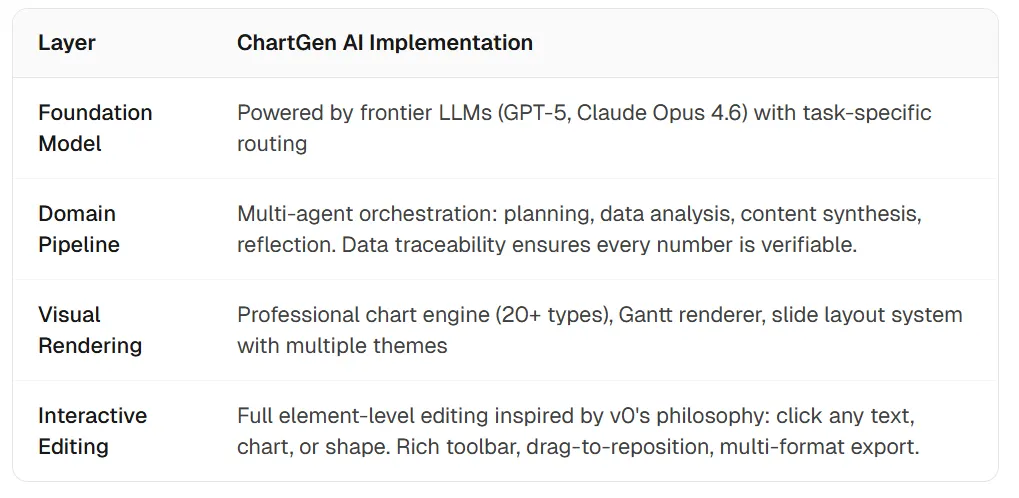

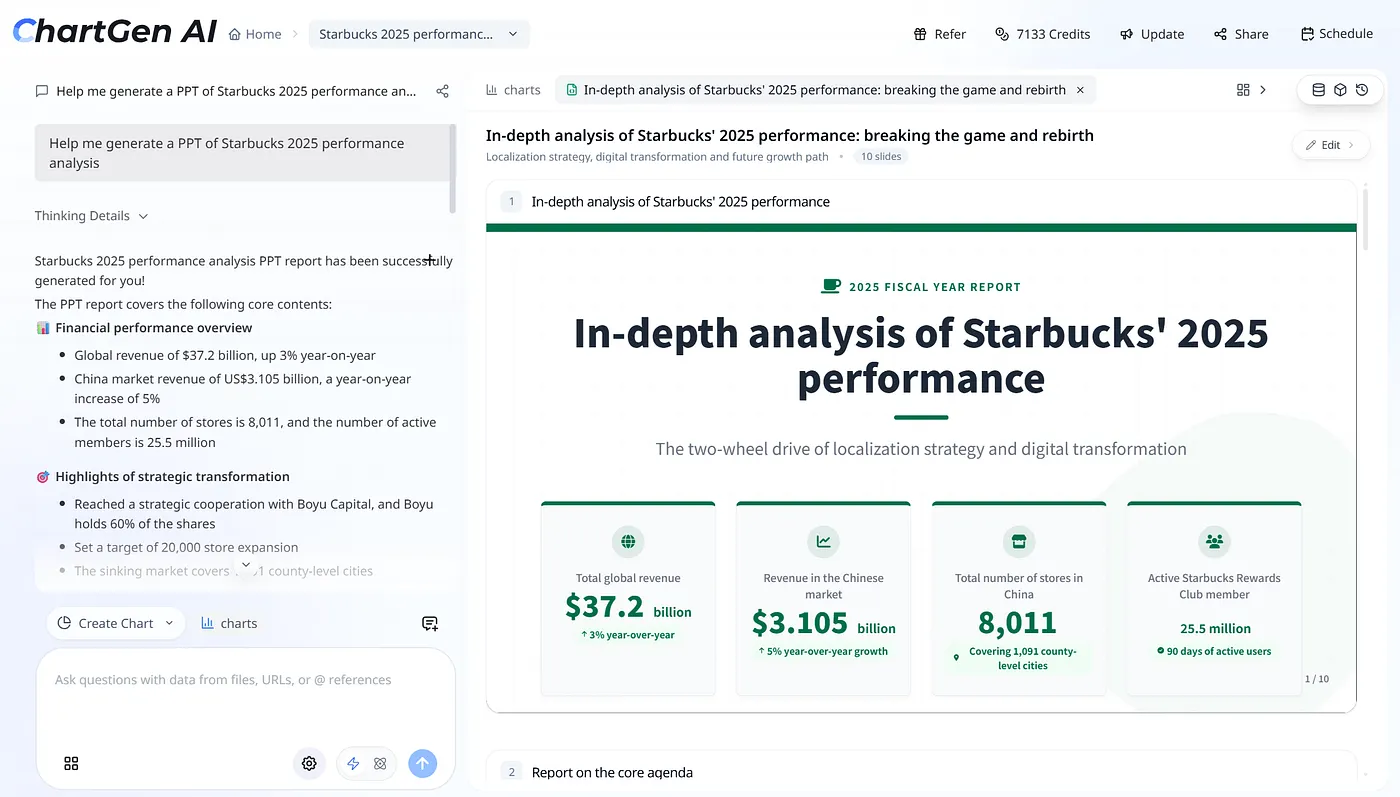

Estudo de Caso: Como o ChartGen AI Incorpora a Mudança para IA Visual

Não começamos o ChartGen AI para seguir uma tendência. Começamos com uma tese estreita: profissionais de dados não deveriam precisar ser designers para criar visuais atraentes. À medida que o produto cresceu, o padrão mais amplo se tornou óbvio — uma plataforma de IA para saída visual.

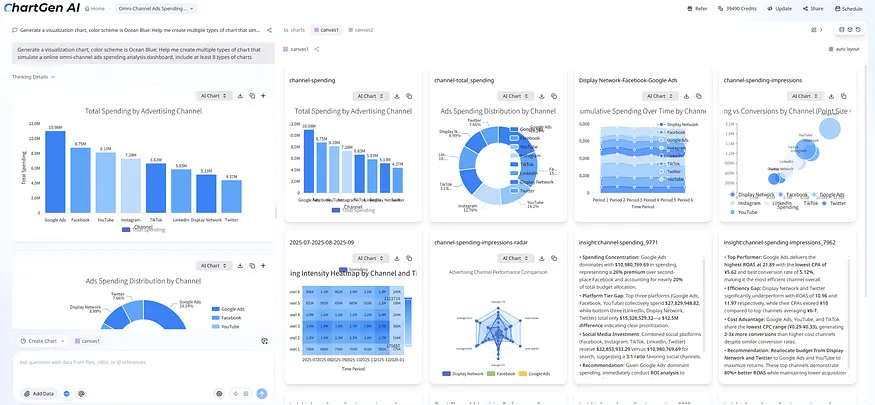

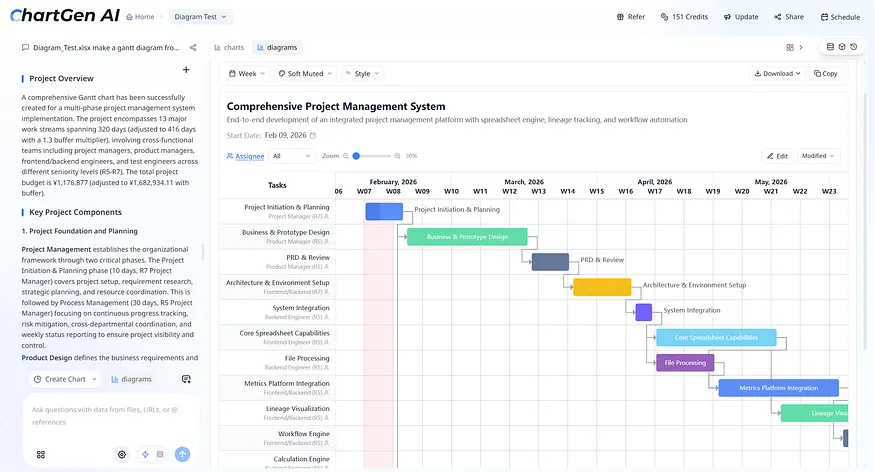

ChartGen AI se comporta como um agente “IA para UI”: linguagem natural mais dados de entrada; gráficos, painéis, visões Gantt e apresentações completas na saída. Cada passo produz algo que você pode ver, editar e compartilhar — não uma parede de texto.

Três Modos de Saída Visual

Modo 1 — Visualização de dados. Faça upload de dados, pergunte em linguagem simples, obtenha gráficos e painéis em uma tela infinita com rastreabilidade até as linhas de origem.

Modo 2 — Diagramas Gantt. Descreva um projeto ou faça upload de uma planilha; obtenha um Gantt interativo com dependências, responsáveis e progresso, com edições inline.

Modo 3 — Apresentações de IA. Um único prompt pode acionar um pipeline multiagente (planejar, pesquisar, analisar, projetar, refletir). Tabelas e gráficos permanecem vinculados aos dados de origem; a edição é no nível do elemento em um editor de deck dedicado.

Esta é a mudança para IA visual na prática: um agente que mostra seus dados — em artefatos que você pode confiar, refinar e apresentar.

O Que Vem a Seguir: Cinco Previsões para a Onda de IA Visual

- Vídeo e visualização de dados convergem — histórias de dados animadas, relatórios trimestrais em formato de vídeo, painéis que tocam como apresentações; a linha entre gráfico e movimento se desfaz.

- “IA para UI” se torna o fluxo de trabalho de desenvolvimento padrão — ferramentas como v0 entram no kit diário; contextos de milhões de tokens tornam a geração de UI para repositórios inteiros normal.

- Apresentações de IA consomem a maioria dos decks internos — artefatos de um único prompt para atualizações e revisões; o polimento humano se concentra nos momentos externos de maior risco.

- “Agente de IA visual” se torna uma categoria — ferramentas de análise, produto e marketing que por padrão entregam produtos visuais, não rolagem de texto.

- A competição de modelos se desloca para a qualidade visual — benchmarks para gráficos, slides, UI e vídeo importam tanto quanto os rankings de prosa.

A mudança de IA de texto para IA visual não é um incremento de funcionalidade. É uma mudança de plataforma — mais perto de CLI-para-GUI ou desktop-para-mobile do que de uma atualização de modelo. Os construtores que priorizam a saída visual moldam a próxima década.

Mostre, Não Conte

Seedance 2.0 não apenas descreve uma cena — ele a mostra, com áudio sincronizado.

Claude Opus 4.6 não só descreve uma UI — ele pode enviar interfaces prontas para produção rapidamente.

v0 não para no especificação — ele envia UI funcional a partir de um prompt.

ChartGen AI não para de descrever seus dados — ele os visualiza em gráficos, painéis e decks que você pode editar e defender.

O fio condutor para os produtos mais impactantes de 2026: menos parágrafos para ler, mais artefatos para experimentar.

Passamos 2023–2024 impressionados com o que a IA podia dizer. Em 2026, estamos impressionados com o que ela pode mostrar. O canal visual é mais amplo e mais rico do que o texto jamais foi — e as empresas que estão construindo para ele definirão o cenário futuro.

Referências

Ensaio fonte (figuras e layout original): medium.com — 2026: O Ano em que a IA Parou de Falar e Começou a Mostrar

- seedance.io — Página do produto Seedance 2.0

- wavespeed.ai — Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Anúncio do Claude Opus 4.6

- datastudios.org — Comparação GPT-5 vs Claude 4

- openreview.net — PDF sobre escalonamento de LLM (tarefas de conhecimento, retornos decrescentes)

- marketsandmarkets.com — Mercado de geradores de imagem e vídeo por IA

- htfmarketinsights.com — Relatório de mercado de geradores de apresentação por IA

- a16z.com — Construtores de apps web por IA / prompt-para-produto

- siliconrepublic.com — Seedance 2.0 e ações de tecnologia chinesas

- neurocanvas.net — Prévia de geração de imagem por IA em 2026

- lordofthewix.com — Progresso da imagem/vídeo por IA 2020–início de 2026