Модальность вывода меняется: от текста, который вы читаете, к визуальным образам, которые вы воспринимаете.

*Рисунки и макет соответствуют оригинальному эссе на Medium.*

Момент, когда я понял, что всё изменилось

Я наблюдал, как ИИ создал кинематографическое видео с синхронизированным диалогом. И тут до меня дошло: текстовый ИИ уже вчерашний день.

На этой неделе ByteDance выпустила Seedance 2.0: кинематографическое видео 1080p, нативно синхронизированный звук с многоязычной синхронизацией губ, многосюжетное повествование с согласованностью персонажей между сценами, до девяти изображений и трех видео и трех аудиофайлов одновременно, а также 15-секундные клипы, которые могут выглядеть как профессиональные.

На прошлой неделе Claude Opus 4.6 был запущен с контекстным окном в один миллион токенов и мощным агентным программированием. Не просто написание кода — создание готовых к продакшену интерфейсов из короткого промпта. GitHub Copilot быстро интегрировал его. Разработчики начали создавать полнофункциональные приложения за минуты.

Между тем, в чистых текстовых задачах GPT-5 против Claude 4 Sonnet могут казаться взаимозаменяемыми для многих пользователей.

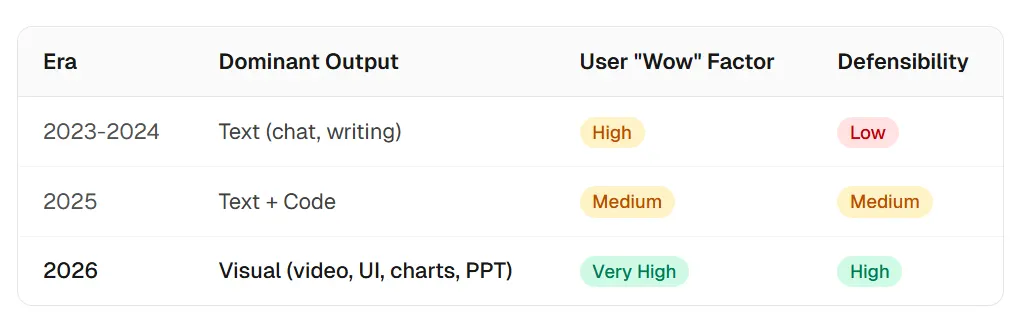

2026 год — это не год, когда ИИ стал немного лучше писать текст. Это год, когда ИИ стал значительно лучше показывать вам вещи: видео, интерфейсы, графики, дашборды, презентации. Модальность вывода переходит от текста к визуальным образам — и это меняет, какие продукты побеждают.

Плато текста: почему «лучший текст» больше не двигает иглу

GPT-5 против Claude 4: различия реальны. Разрыв в повседневном восприятии? Часто почти нулевой.

Передовые модели 2026 года объективно сильнее своих предшественников 2025 года. GPT-5 представил адаптивное рассуждение — переключение между быстрым и глубоким режимами. Claude Opus 4.6 поставил контекстное окно на 1M токенов и сильные результаты бенчмарков. Рассуждение, точность фактов и скорость — всё сдвинулось.

Но для текстового вывода разрыв в восприятии пользователями стремится к нулю.

DataStudios (2026) говорит прямо: оба мощные; философия различается, но различие результатов становится менее важным. Люди сообщают об «усталости от чат-ботов ИИ» — основные ассистенты могут звучать одинаково.

Исследования масштабирования LLM подтверждают потолок. PDF на OpenReview отмечает, что для задач, требующих знаний, больше вычислительного времени не улучшает точность надежно — и может увеличивать галлюцинации. Отдача от полировки текста снижается.

«Вау» переместилось. Мало кто ахает над отполированным письмом. 15-секундный кинематографический клип из промпта, продакшен-интерфейс за полминуты или десятислайдовая презентация данных из загрузки Excel всё ещё останавливают комнату.

Следующая волна выдающихся AI-компаний не будет определяться только тем, кто пишет лучшие абзацы. Их будут определять те, кто генерирует лучшие визуальные материалы.

Визуальный взрыв: четыре категории, переопределяющие вывод ИИ

Текст-в-видео. Текст-в-UI. Текст-в-график. Текст-в-презентацию. Слой опыта перестраивается.

Категория 1: Генерация видео с помощью ИИ

Seedance 2.0 — это не маленький шаг. Он переосмысливает категорию: 1080p, аудио, генерируемое параллельно с видео, многосюжетное повествование с согласованными персонажами, многоязычная синхронизация губ и множество мультимодальных входов — ближе к пайплайну, чем к игрушке. См. также это сравнение WaveSpeed.ai Seedance 2.0 с Kling 3.0, Sora 2 и Veo 3.1.

Поле переполнено: Sora 2 (физика, ~12 с), Veo 3.1 (кинематографичность, ~8 с), Kling 3.0 (сильна в Китае). Мультимодальная архитектура ввода Seedance 2.0 устанавливает новую планку. Отчет о реакции рынка: Silicon Republic о китайских технологических акциях.

Контекст размера рынка: MarketsandMarkets о генерации изображений и видео с помощью ИИ (прогноз до 2030 года, CAGR в районе высоких тридцатых).

Категория 2: Генерация UI с помощью ИИ

v0 от Vercel превращает язык в продакшен-класс React и Tailwind. Bolt, Lovable и Forge создают полнофункциональные приложения из промптов. a16z об эпохе «промпт-в-продукт» объясняет, почему цикл от идеи до запуска сократился.

Claude Opus 4.6 усиливает это: контекст в 1M токенов позволяет ассистенту удерживать всю кодовую базу, генерируя UI с архитектурным пониманием. Скорость разработки меняется, когда модель видит весь проект.

Категория 3: Визуализация данных с помощью ИИ

Традиционные BI-стеки требуют ручной настройки, языков запросов и навыков дизайна. Нативные средства визуализации с ИИ сжимают путь: загрузите данные, опишите представление, получите графики и дашборды быстро.

Ключевой дифференциатор — прослеживаемость. Текстовые галлюцинации легко скрыть; неправильный график очевиден. Это вынуждает повышать инженерную планку и создает естественный качественный ров. Скорость не главное — цифры должны быть правильными.

Категория 4: Генерация презентаций с помощью ИИ

Рынок AI-презентаций был примерно $1,5B в 2025, с прогнозом до ~$4,0B к 2033 году при ~14% CAGR. Gamma масштабировала пользователей быстро; Tome покинула категорию. Рынок делится между инструментами, ориентированными на скорость, и инструментами, ориентированными на глубину.

Передний край — мультиагентные пайплайны, которые исследуют, анализируют, проектируют и проверяют — а не один проход LLM, который украшает пункты. Презентации — универсальный бизнес-формат; сделать их нативными для ИИ — огромный прорыв.

Во всех четырех категориях вывод переходит от «текста, который вы читаете» к «визуальным образам, которые вы воспринимаете». Индустрия потратила 2023–2025 на оттачивание текстового канала. В 2026 году она строит визуальный канал — где часто находится защита.

Почему визуальный ИИ сложнее (и более защищен), чем текстовый ИИ

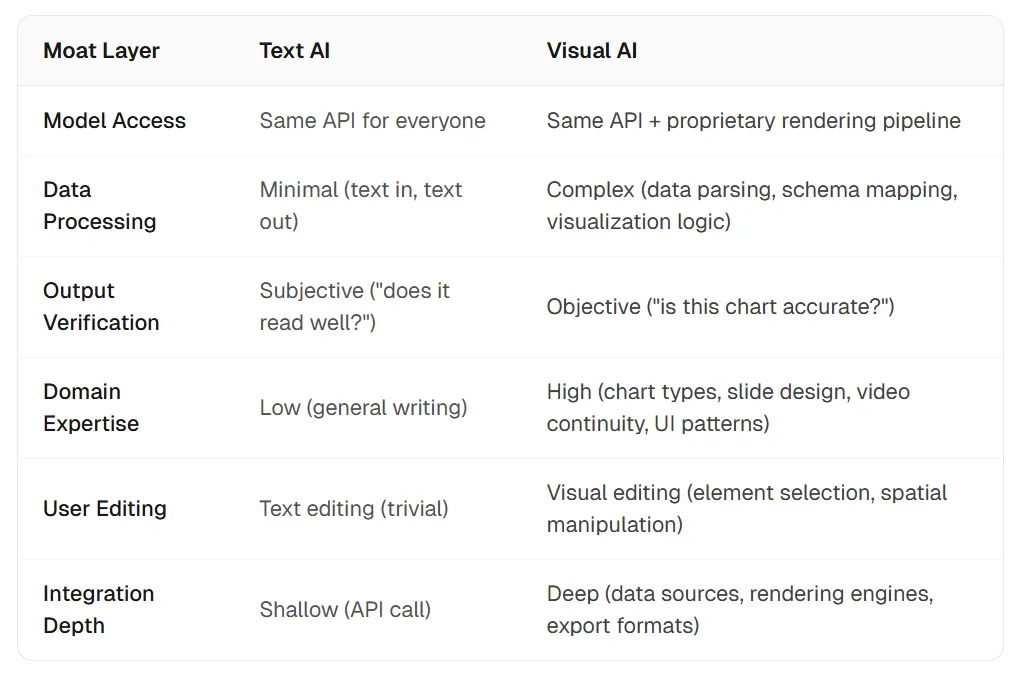

Любой может обернуть LLM. Немногие команды могут запустить реальный визуальный движок.

Текстовые продукты быстро стали товаром: вызовите GPT или Claude, отформатируйте строки, запустите. Тысячи ассистентов по письму слились. Тонкая защита — те же модели, те же API, похожее качество.

Визуальный ИИ сопротивляется такой схеме:

- Инфраструктура рендеринга — видеодекодеры, движки графиков, UI-системы, движки макетов слайдов.

- Знание предметной области — какой график подходит какой форме данных, как повествование течет по слайдам, как компоненты собираются.

- Многоэтапные пайплайны — планирование, извлечение, анализ, рендеринг и проверка; редко один вызов API.

К концу 2026 года самые ценные AI-стартапы склоняются к визуальному выводу. Эра API-оберток истончается; эра визуальных движков ускоряется.

Стек визуального ИИ: что формируется

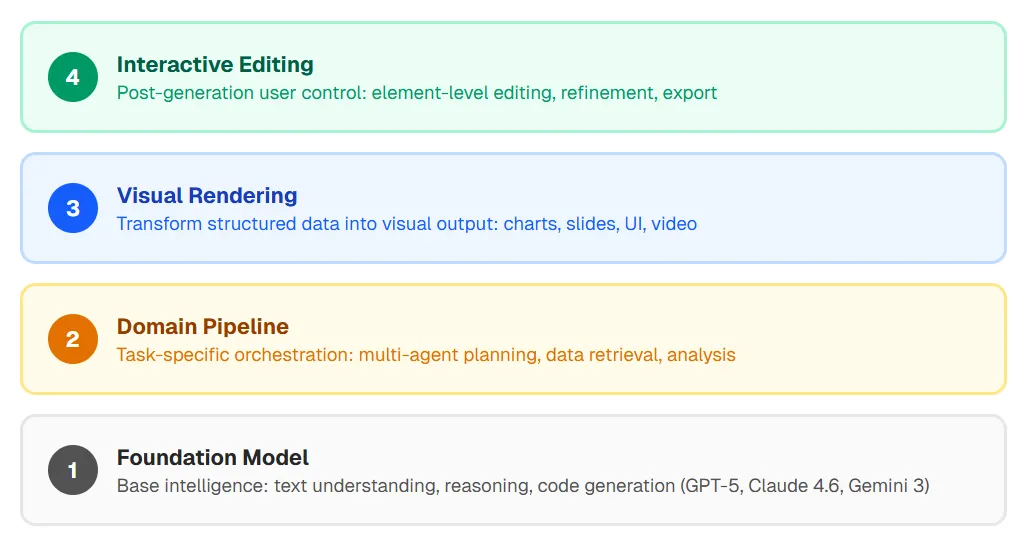

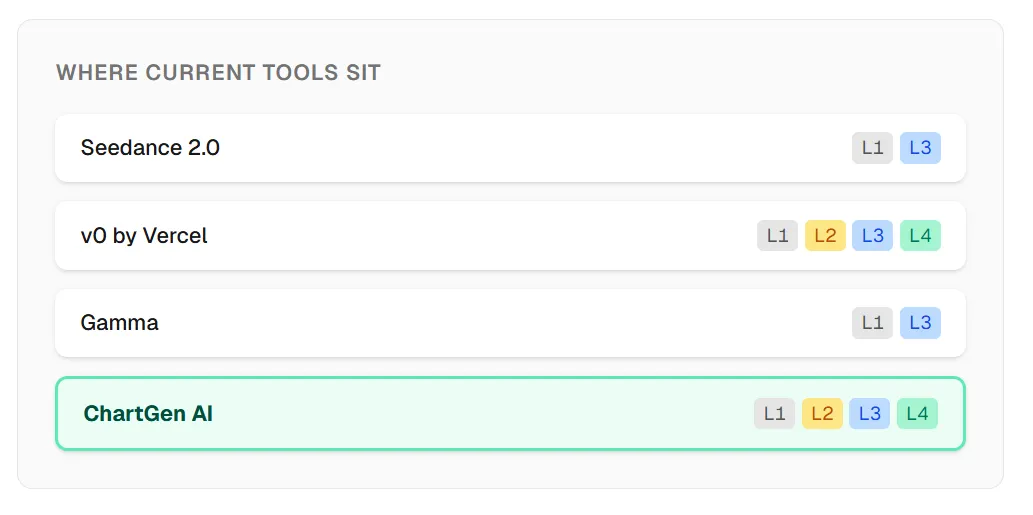

Четырехуровневая структура проявляется во всех категориях:

- Фундаментальная модель

- Предметный пайплайн (планирование, инструменты, извлечение)

- Визуальный рендеринг

- Интерактивное редактирование

Уровень 1 сам по себе — товарная обертка. Уровни 1–2 мощны, но часто невидимы. Уровни 1–3 ощущаются как настоящий продукт. Уровни 1–4 позволяют пользователям генерировать и итерировать в одной среде — устойчивая форма.

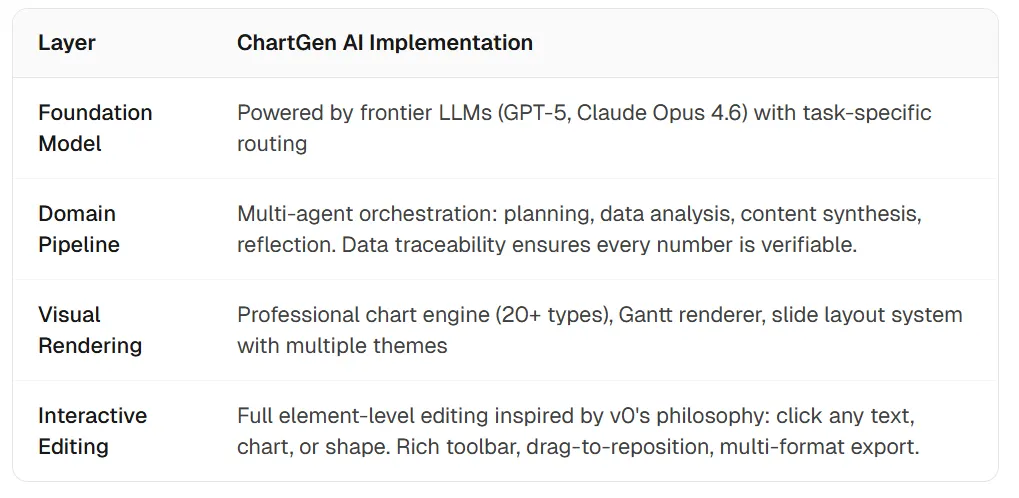

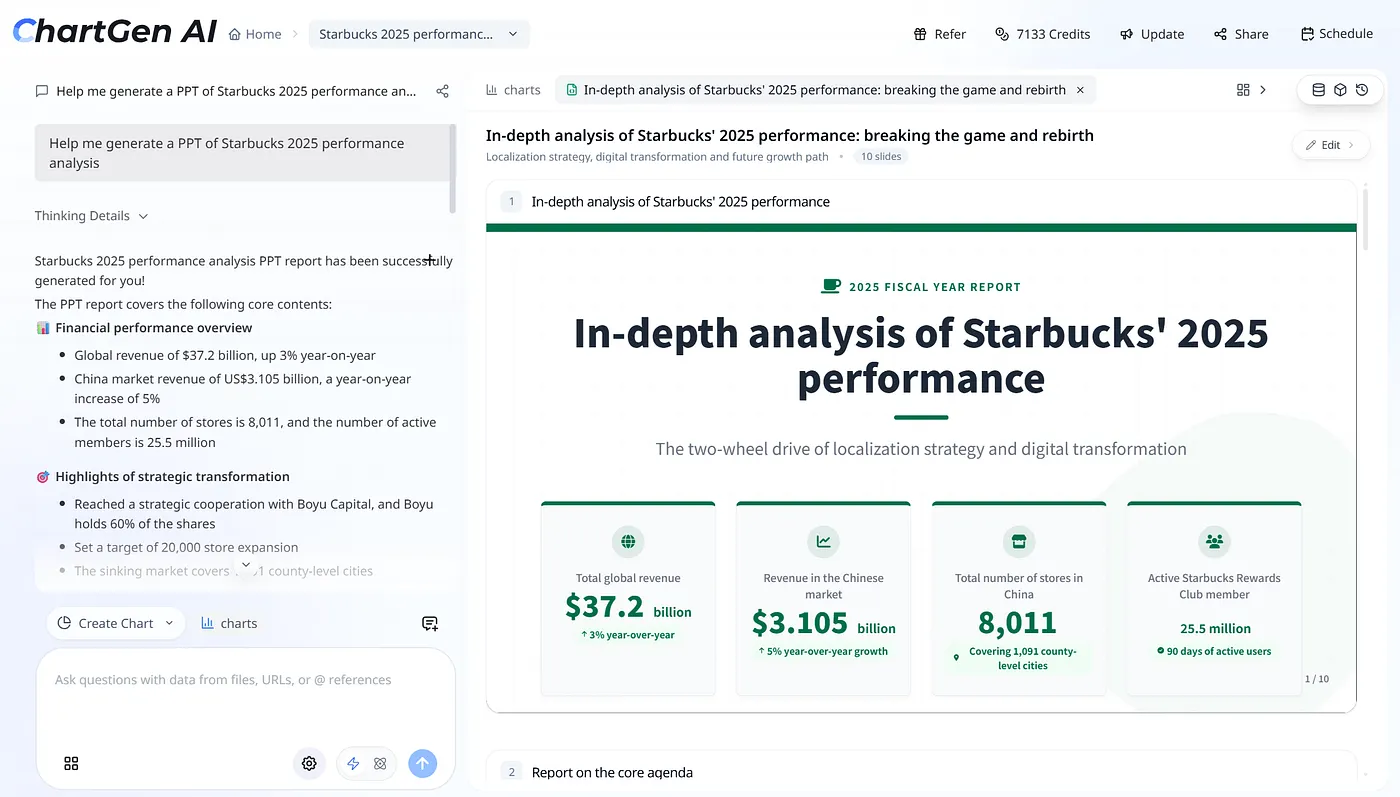

Пример: как ChartGen AI воплощает сдвиг к визуальному ИИ

Мы не начинали ChartGen AI в погоне за трендом. Мы начали с узкой гипотезы: специалисты по данным не должны быть дизайнерами, чтобы создавать убедительные визуальные материалы. По мере роста продукта стала очевидной более широкая картина — платформа AI-в-визуальный-вывод.

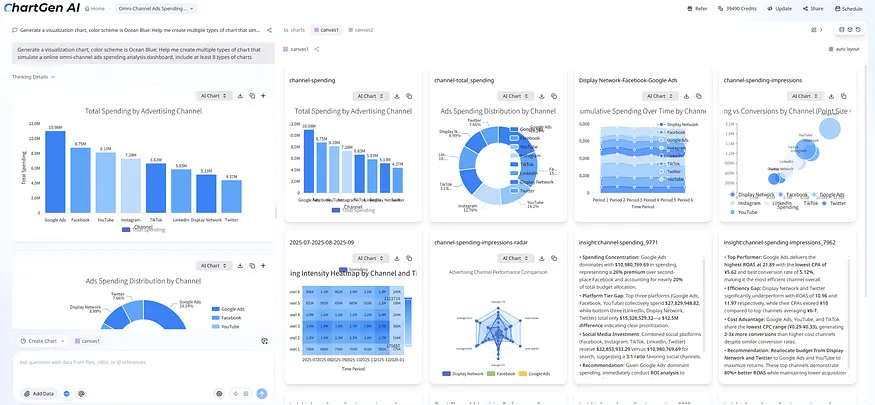

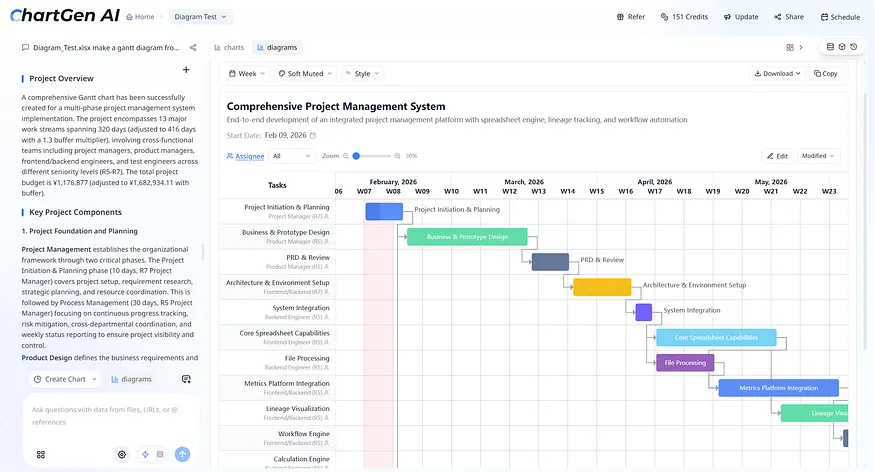

ChartGen AI ведет себя как агент «AI в UI»: естественный язык и данные на входе; графики, дашборды, диаграммы Ганта и полноценные презентации на выходе. Каждый шаг создает то, что можно видеть, редактировать и делиться — не стену текста.

Три режима визуального вывода

Режим 1 — Визуализация данных. Загрузите данные, спросите на простом языке, получите графики и дашборды на бесконечном холсте с возможностью отслеживания до исходных строк.

Режим 2 — Диаграммы Ганта. Опишите проект или загрузите таблицу; получите интерактивный Гант с зависимостями, ответственными и прогрессом, с возможностью редактирования на месте.

Режим 3 — AI-презентации. Один промпт может запустить мультиагентный пайплайн (планирование, исследование, анализ, дизайн, рефлексия). Таблицы и графики остаются привязанными к исходным данным; редактирование на уровне элементов в специальном редакторе презентаций.

Это и есть сдвиг к визуальному ИИ на практике: агент, который показывает ваши данные — в артефактах, которым можно доверять, которые можно дорабатывать и показывать.

Что дальше: пять прогнозов для волны визуального ИИ

- Видео и визуализация данных сходятся — анимированные истории данных, квартальные отчеты в формате видео, дашборды, которые играют как презентации; граница между графиком и движением размывается.

- «AI в UI» становится стандартным рабочим процессом разработки — инструменты класса v0 входят в повседневный набор; контексты в миллионы токенов делают генерацию UI для всего репозитория нормой.

- AI-презентации поглощают большинство внутренних слайдов — артефакты из одного промпта для обновлений и обзоров; человеческая полировка концентрируется на самых важных внешних моментах.

- «Визуальный AI-агент» становится категорией — инструменты для аналитиков, продуктов и маркетинга, которые по умолчанию создают визуальные результаты, а не прокрутку текста.

- Конкуренция моделей смещается к визуальному качеству — бенчмарки для графиков, слайдов, UI и видео становятся так же важны, как лидерборды прозы.

Переход от текстового ИИ к визуальному — это не улучшение функций. Это платформенный сдвиг — ближе к переходу от CLI к GUI или от рабочего стола к мобильным устройствам, чем к обновлению модели. Создатели, которые отдают приоритет визуальному выводу, формируют следующее десятилетие.

Показывай, а не рассказывай

Seedance 2.0 не просто описывает сцену — он показывает её, с синхронизированным звуком.

Claude Opus 4.6 не просто описывает UI — он может быстро выпустить готовый к продакшену интерфейс.

v0 не останавливается на спецификации — он выпускает рабочий UI из промпта.

ChartGen AI не останавливается на описании ваших данных — он визуализирует их в графиках, дашбордах и презентациях, которые можно редактировать и защищать.

Красная нить для самых impactful продуктов 2026 года: меньше абзацев для чтения, больше артефактов для восприятия.

Мы провели 2023–2024, удивляясь тому, что ИИ может сказать. В 2026 году мы удивляемся тому, что он может показать. Визуальный канал шире и богаче, чем текст когда-либо был — и компании, строящие для него, определят ландшафт впереди.

Ссылки

Исходное эссе (рисунки и оригинальный макет): medium.com — 2026: The Year AI Stopped Talking and Started Showing

- seedance.io — Страница продукта Seedance 2.0

- wavespeed.ai — Seedance 2.0 vs Kling 3.0, Sora 2, Veo 3.1

- anthropic.com — Анонс Claude Opus 4.6

- datastudios.org — Сравнение GPT-5 и Claude 4

- openreview.net — PDF о масштабировании LLM (задачи на знания, убывающая отдача)

- marketsandmarkets.com — Рынок генерации изображений и видео с помощью ИИ

- htfmarketinsights.com — Отчет о рынке генераторов AI-презентаций

- a16z.com — Сборщики веб-приложений на ИИ / от промпта к продукту

- siliconrepublic.com — Seedance 2.0 и китайские технологические акции

- neurocanvas.net — Предварительный просмотр генерации изображений с помощью ИИ 2026

- lordofthewix.com — Прогресс AI изображений/видео 2020–начало 2026